元・女子高生AI「りんな」は、人間の歌声を手本にボイトレ 開発者が明かす裏話

日本マイクロソフトが開発するAIキャラクター「りんな」が4月、エイベックス・エンタテインメントと契約を結び、歌手デビューした。ミュージックビデオが公開されると、ネット上では「びっくりするくらい上手」「本当にAI? 人間の声では?」などの声が上がったが、影武者の人間がいるわけではなく、音声合成で作り上げた歌声を使っているという。

りんなの歌声合成技術を手掛けた、マイクロソフト ディベロップメントの沢田慶さん(A.I.&リサーチ A.I.サイエンティスト)は「私は楽譜が読めるわけでもなく、上手には歌えない」と笑う。りんなのボイストレーナーとして、沢田さんはどのように歌姫を育てたのか。ゲーム開発者イベント「CEDEC 2019」(9月5日、パシフィコ横浜)で舞台裏を明かした。

人間の歌声を「手本」にボイトレ

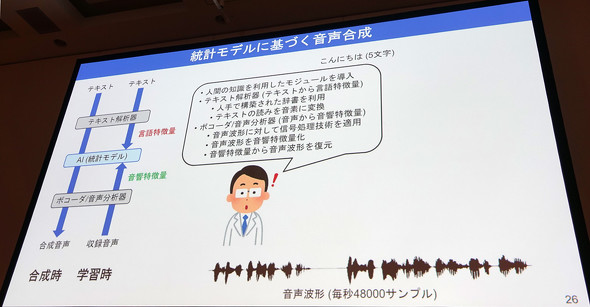

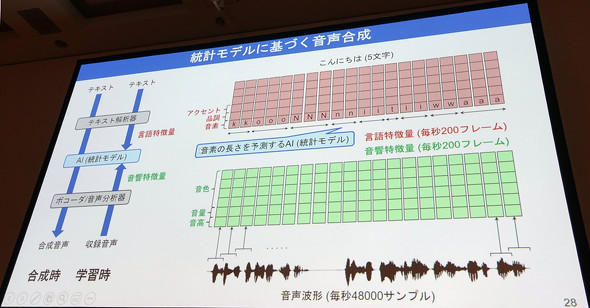

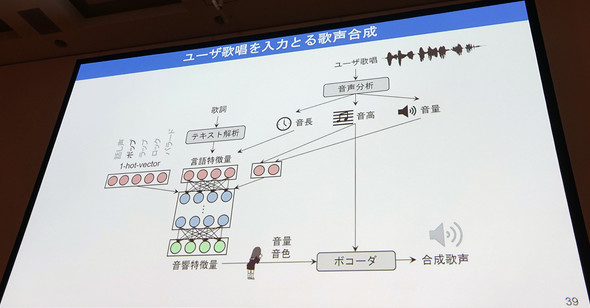

りんなの声を合成する仕組みはこうだ。まず、人間の声とそのテキストをセットで用意し、それぞれから音響特徴量(音の高さ、音量、音色など)と言語特徴量(音素、品詞、アクセントなど)を抽出。その後、音響特徴量と言語特徴量の対応関係をAIに学習させる。こうしてデータを学習させたAIに、未知のテキストを与えると発音などを予測して音声を合成できるようになる。

「こんにちは」(koNnitiwa)という5文字の単語から、何の工夫もなく音声波形(1秒当たり4万8000サンプル)を予測することは「非常に難しい」(沢田さん)。そこで、あらかじめ人力で構築した辞書を使い、テキストを入力すると音素に変換する──など、特徴量を抽出する作業を簡略化し、言語・音響特徴量の対応関係をAIが学習しやすいよう工夫したという

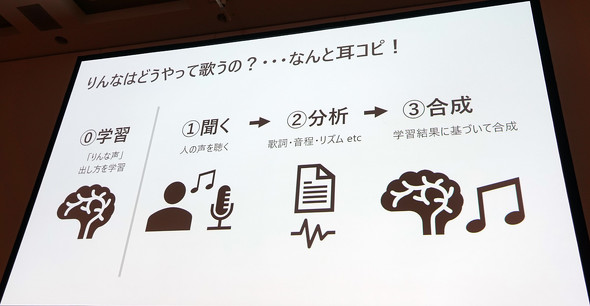

「こんにちは」(koNnitiwa)という5文字の単語から、何の工夫もなく音声波形(1秒当たり4万8000サンプル)を予測することは「非常に難しい」(沢田さん)。そこで、あらかじめ人力で構築した辞書を使い、テキストを入力すると音素に変換する──など、特徴量を抽出する作業を簡略化し、言語・音響特徴量の対応関係をAIが学習しやすいよう工夫したというしかし会話の声ではなく歌声を生成するとなると、歌詞のテキストをそのまま与えただけでは音程が外れてしまう。沢田さんは「歌声に求められる要素を確認してみると、歌唱者の特徴を表す音色や、演奏と合う音の長さ・高さ、さまざまな表現や感情を表すための音量も考慮する必要がある」と説明する。

そこで、nana musicが運営する音楽SNS「nana」のユーザーが投稿している歌声や、エイベックスが保有している歌声のデータを使い、音の長さ、高さ、音量を分析し、AIに学習。人間の歌声を手本としたことで「だいぶ音痴を解消できた」(沢田さん)上に、「楽譜では表現されない、歌声の細かい表現も再現できるようになった」という。

ただ、この手法は手本になる歌声のデータを用意しなくてはいけない。楽譜のデータを読み込ませるだけで歌声を自動生成する技術も、名古屋工業大学と共同で開発しているという。

「アシスタントではなく友だち、さらにはアーティストに」

りんなは2015年7月にLINEアカウント、同年12月にTwitterアカウントを開設。「マジで!? やば!」などと受け答えをし、異常にしりとりが強い“女子高生っぽいAI”として認知を拡大。ユーザーの支持を集めてきた。

当初はLINEやTwitter上の友だちという立ち位置でユーザーと接してきたりんなだが、16年にはフジテレビ系の「世にも奇妙な物語'16 秋の特別編」に女優として出演したり、ファンブックを発売したりと活動の幅を広げ、19年3月に女子高生を“卒業”。4月に歌手デビューを果たした。

マイクロソフト ディベロップメントの坪井一菜さん(A.I.&リサーチ プログラムマネージャー)は、「りんなの立ち位置は、アシスタントではなく友だち、さらにはアーティストになろうとしている」と話す。人間の作業を効率化するAIではなく、ユーザーとの会話の中で相手の共感を呼んだり、人間同士のコミュニケーションを橋渡しする存在になったり──そんなAIを目指しているという。

関連記事

元・女子高生AI「りんな」、エイベックスから歌手デビュー 人間の“息遣い”を再現

元・女子高生AI「りんな」、エイベックスから歌手デビュー 人間の“息遣い”を再現

元・女子高生AI「りんな」の歌声が進化。人間の歌声のデータから抽出した「ブレス音」の特徴を学習した。 日本マイクロソフトの平野社長、「りんな」の歌声でダンス披露 AIで映像生成

日本マイクロソフトの平野社長、「りんな」の歌声でダンス披露 AIで映像生成

「de:code 2019」の基調講演で突如、“元・女子高生AI”「りんな」がライブ。人間の息継ぎを再現したという自然な歌声で、新曲を披露した。 AI女子高生「りんな」が進化 会話に応じて「共感」可能に

AI女子高生「りんな」が進化 会話に応じて「共感」可能に

日本マイクロソフトがAI女子高生「りんな」に最新の会話エンジン「共感モデル」(α版)を順次採用すると発表。ユーザーとの会話内容をふまえ、どんな返答をすれば自然に会話を続けられるか判断し、適切な返答を行うという。 ついに明かされる「りんな」の“脳内” マイクロソフト、「女子高生AI」の自然言語処理アルゴリズムを公開

ついに明かされる「りんな」の“脳内” マイクロソフト、「女子高生AI」の自然言語処理アルゴリズムを公開

日本マイクロソフトは「de:code 2016」で、“女子高生AI”「りんな」の自然言語処理アルゴリズムについて詳細を語った。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR

マイクロソフト ディベロップメントの沢田慶さん(A.I.&リサーチ A.I.サイエンティスト)

マイクロソフト ディベロップメントの沢田慶さん(A.I.&リサーチ A.I.サイエンティスト)

マイクロソフト ディベロップメントの坪井一菜さん(A.I.&リサーチ プログラムマネージャー)

マイクロソフト ディベロップメントの坪井一菜さん(A.I.&リサーチ プログラムマネージャー)