車椅子がロボットと合体 遠隔操作でユーザーを助ける「SlideFusion」:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

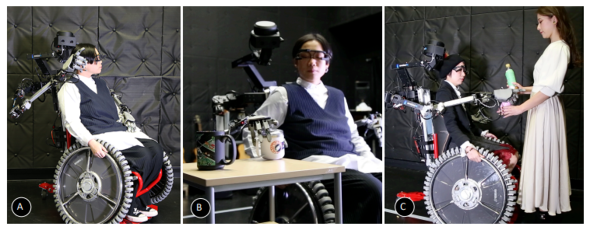

慶応義塾大学大学院の研究チームが開発した「SlideFusion」は、車椅子の背中に2本の腕を搭載したロボットを組み込み、それを別の操縦者のアバターとしてコントロールすることで、車椅子利用者の身体的・認知的負担を軽減する補助システムだ。VRによる遠隔操作でロボットの腕を操り、利用者を助ける。

SlideFusionは、全方位移動型の特注パワーアシスト車椅子と、車椅子に組み込まれたアバターロボット、そして車椅子利用者のための視線追跡モジュールを組み合わせたもの。

アバターロボットは2本の腕、立体視と両耳聴力を備えた顔部分、これらをつなぐ上半身で構成される。遠隔操作者は、VR HMD(ヘッドマウントディスプレイ)とデータグローブを用いてワイヤレス制御する。遅延は100ミリ秒以下に抑える。車椅子利用者の安全を確保するため、ロボットの腕は利用者の身体に届かないよう稼働域に制限をかけている。

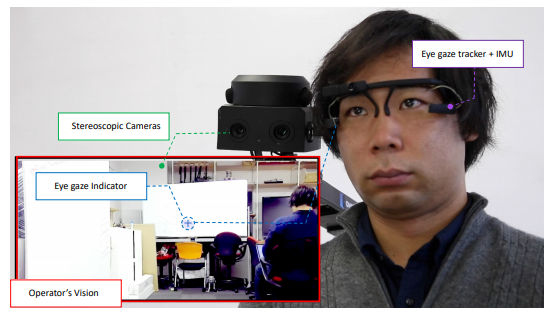

車椅子利用者は、頭部の方向を追跡するIMUセンサーが埋め込まれたアイトラッキングモジュールを眼鏡のように装着できる。視線データは、センサーで測定した頭部の向きと統合され、ロボットの視覚フィードバックとともに遠隔操作者に送られる。ロボットから見た映像に視線が重ね合わせられるので、遠隔操作者は車椅子利用者がものを見ている様子をリアルタイムで確認できる。

遠隔操作者は車椅子利用者の関心領域を瞬時に理解し、口頭でやりとりしなくても状況に応じた適切なサポートができる。デモ映像では、指さしでのナビゲート、机上のコップを取るなどの活用例を示している。

関連記事

傘を差して荷物も持てる2本分の腕──体に巻き付けるヘビ型ウェアラブルロボ「Orochi」

傘を差して荷物も持てる2本分の腕──体に巻き付けるヘビ型ウェアラブルロボ「Orochi」

人が触手を使えるなら、どんな活用ができるか。 口元に直接与えるVR新感覚 ヘッドセットに取り付けるロボットアーム

口元に直接与えるVR新感覚 ヘッドセットに取り付けるロボットアーム

食べ物まで与えてくれるロボットアームだ。 ロボットが患者の着替えを支援 ジョージア工科大やFacebookなどが開発

ロボットが患者の着替えを支援 ジョージア工科大やFacebookなどが開発

介護での着替えをロボットがアシストしてくれるように。 セリーナ対フェデラー? 夢のテニスマッチをビデオ合成できる新技術、スタンフォード大が開発

セリーナ対フェデラー? 夢のテニスマッチをビデオ合成できる新技術、スタンフォード大が開発

さらには自分自身と対戦。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR