1回のスキャンで顔の「シワから毛穴まで」再現 リアルな皮膚の動きも自動生成:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

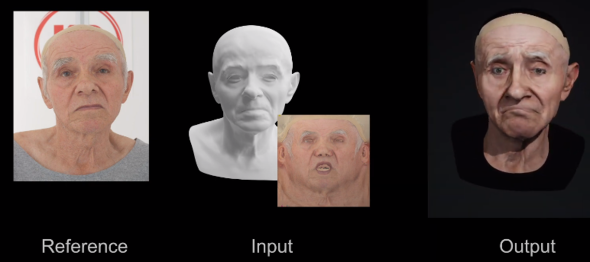

南カリフォルニア大学、USC Institute for Creative Technologies、Pinscreenによる米研究チームが開発した「Dynamic facial asset and rig generation from a single scan」は、1回スキャンしただけで、その人の高精細な顔と忠実度の高い動きを自動生成可能にする深層学習フレームワークだ。顔のアニメーションに合わせてリアルな皮膚の動きを再現する。

シワの動きまで忠実なリアルアバターを再現する場合、従来の手法では1人に対して複数回のスキャンを必要とし、手作業による面倒な後処理も必要だった。

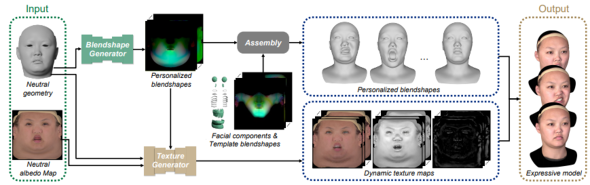

今回は自己教師あり学習フレームワークを使い、1回のスキャンからパーソナライズされたリアルな顔を生成し、動きに必要なスキンテクスチャを含むフェイスリグアセットを自動生成する。

1回のスキャンで取得した顔のジオメトリとアルベドマップから、まずブレンドシェイプジオメトリのセットを推定。次にアルベド、スペキュラー、ディスプレイスメントなどを含む一連の動的なテクスチャマップも推定する。最後に顔の構成要素(歯、歯茎、目、舌など)を組み合わせて、顔のモデルを完成させる。

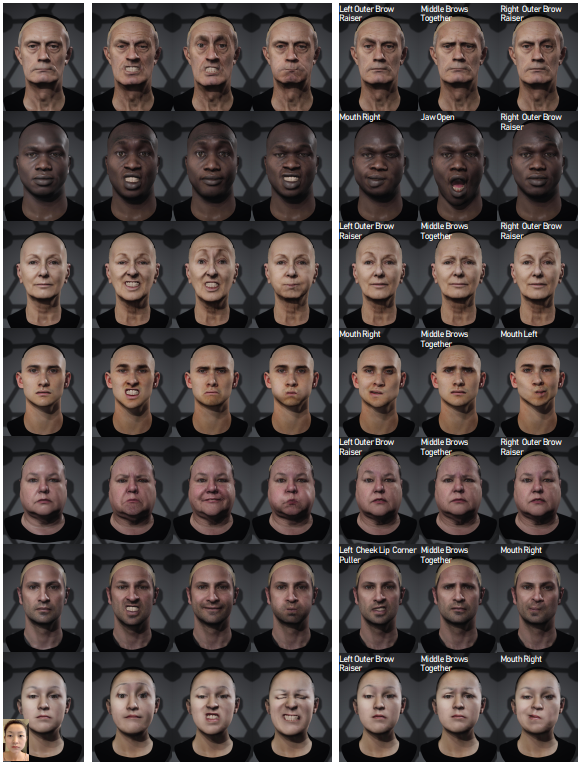

訓練では、19〜26種類の異なる表情を持つ178種類の顔からなるデータセットを活用し、アイデンティティーとパーソナライズされた表情の相関関係をモデル化する。

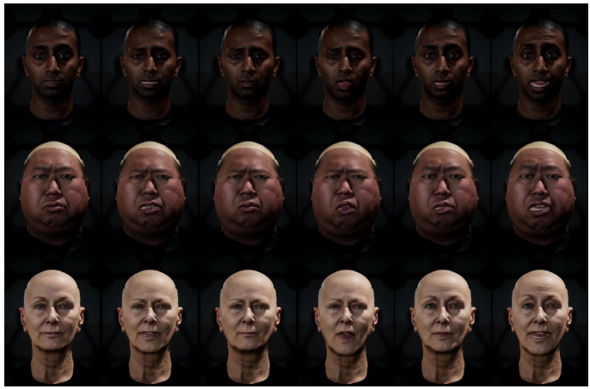

深層学習の訓練により、シワや毛穴まで詳細に表現された写実的な顔がアニメーションに合わせて適切に動き、皮膚の動きも忠実に反映される。

関連記事

表と裏を独立検知できる布地タッチセンサー Google、「ZebraSense」開発

表と裏を独立検知できる布地タッチセンサー Google、「ZebraSense」開発

表裏のセンサーを交互に組み込むことで、表からも裏からも操作可能。 協調して動く球体ロボット群「FreeBOT」 くっついたり離れたり、転がったり壁を登ったり

協調して動く球体ロボット群「FreeBOT」 くっついたり離れたり、転がったり壁を登ったり

自律システムの構築も目指す。 レトロゲーム機でレトロゲームを自作 Microsoftが「TileCode」開発

レトロゲーム機でレトロゲームを自作 Microsoftが「TileCode」開発

「ツクール」など同種のものはあるが、今回はMSが構築した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR