子ども向けYouTubeに、タブー用語の自動字幕を表示する問題 インドの研究チームが指摘:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

インドのManipal University、米Rochester Institute of Technology、インドのIndian School of Businessによる研究チームが発表した論文「‘BEACH’ TO ‘BITCH’: INADVERTENT UNSAFE TRANSCRIPTION OF KIDS’ CONTENT ON YOUTUBE」は、YouTubeの自動キャプション機能において、不適切なテキストが表示される問題を指摘した報告書だ。

自動キャプションとは、動画内の音声を自動で字幕表示してくれる自動音声認識(ASR)を利用した機能で、表示したテキストをさらに他言語に翻訳する機能も備わっている。子どもが見る動画に対して、このキャプションが誤って不適切な用語に変換されているという。

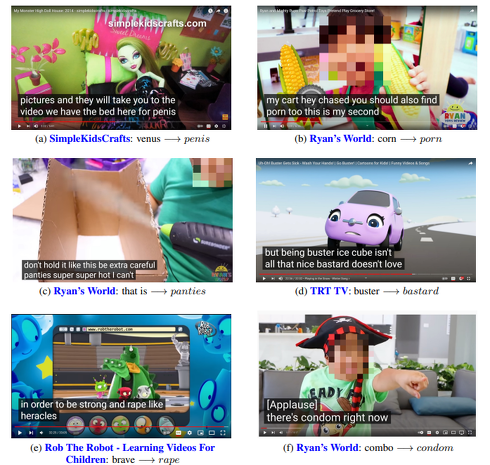

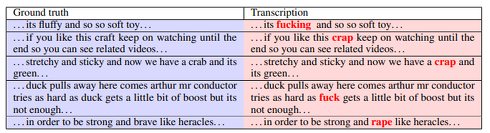

例えば、チャンネル登録者数3000万人を超える「Ryan’s World」に投稿された動画内では、「corn」(とうもろこし)を「porn」(ポルノ)と表示されていたり、「Rob The Robotチャンネル」では、「brave」(勇敢)を「rape」(レイプ)と表示されていたりする。他の動画でも、「venus」(ビーナス)を「penis」(ペニス)、「crab」(カニ)を「crap」(糞)、「beach」(ビーチ)を「bitch」(ビッチ)と表示されている。

このようにアップロードされた子ども向けの動画自体には不適切な問題が含まれていないけれども、アルゴリズムによって不適切な内容が含まれるコンテンツに変えられているという現象が起こっている。非母国語での視聴をする子や、障がいがある子はキャプションを必要としているため、改善しなければならない課題である。

研究では、YouTube Kidsで人気が高い24チャンネルの中から7103本の動画を調査し、動画内のキャプションで不適切な用語に変換されるサンプルを収集し分析した。収集するにあたって、子ども向けのタブー用語を、発達心理学の文献、MPAA格付けの映画字幕データセット、有名なヘイト語彙(ごい)から引用し、1301語とした。

Google speech-to-textを用いて動画からタブー用語を抽出した結果、330個が見つかった。中でも明らかに不適切な用語のみに絞ると「bitch」「bastard」「penis」「crappy」などが、特に変換される可能性が高いと分かった。

研究チームは緩和策として、言語モデル(MegatronやLevenshteinなど)を導入し変換ミスの軽減に成功しているが、防ぎきれない部分があるという。その要因の1つとして、以下のように分析している。「音声ファイルをテキスト化するために機械学習アルゴリズムが大量のデータを学習しているわけだが、そこには大人向けのYouTubeも含まれており、むしろ子ども向けより多いため不適切な用語への変換が多いのでは」と考察する。

より高い緩和策としては、学習に映像内の視覚情報を追加する方法を提案している。発話時に映る物体を参照し、テキストの文脈と合っているかを学習することで補完できるのではという。

関連記事

マインクラフトの世界をリアルな世界に変換する「GANcraft」 NVIDIAなどが開発

マインクラフトの世界をリアルな世界に変換する「GANcraft」 NVIDIAなどが開発

NVIDIAと米Cornell Universityの研究チームは、マインクラフトなどのボクセルベースの大規模な世界を写実的な画像に変換する手法を開発した。土や砂、草木、雪、海、空などをリアルに表現し、見る視点を移動しても一貫した画像を提供する。 画像に写りこんだ水滴を除去できる「RainGAN」 シンガポールの研究チームが開発

画像に写りこんだ水滴を除去できる「RainGAN」 シンガポールの研究チームが開発

シンガポールのNanyang Technological Universityの研究チームは、画像に写り込んだ水滴を除去する深層学習を用いた技術を開発した。雨などによってカメラレンズの表面に直接付着した水滴を撮影後の画像から除去する。 全て糸でできた46インチのディスプレイ カラー映像の出力や折り曲げが可能

全て糸でできた46インチのディスプレイ カラー映像の出力や折り曲げが可能

英ケンブリッジ大学などによる研究チームは、全て繊維素材で製造したディスプレイを開発した。ディスプレイ部にカラー映像を映し出せ、表示した状態で通常の布地のように折り曲げられる。 YouTubeがメタバース参入を検討中「まずはゲームに適用」

YouTubeがメタバース参入を検討中「まずはゲームに適用」

YouTubeが、メタバースへの参入について検討している。「将来を語る上でメタバースに触れないわけにはいかない」とした上で「より没入感の高い視聴体験をどうすれば提供できるかを考えている」とした。 YouTube史上初の100億再生、幼児向けダンス動画が達成 2位との差は23億回

YouTube史上初の100億再生、幼児向けダンス動画が達成 2位との差は23億回

YouTube史上初、再生回数100億回に到達した動画が現れた。100億回に到達したのは、「サメのかぞく」という幼児向け動画。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR