オートフォーカス付きARヘッドセット 視線に応じて焦点をリアルタイムに自動調整:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

オーストリアのグラーツ工科大学と米スタンフォード大学の研究チームが開発した「Video See-Through Mixed Reality with Focus Cue」は、広範囲に渡って着用者が見ているAR空間に焦点を合わせられる、可変焦点可能なビデオシースルー型HMD(ヘッドマウントディスプレイ)だ。

今回のアプローチは、着用者が見ている焦点以外の領域を映像的にぼかしているのではなく、眼球が実際に焦点を合わせた際にその領域以外が実世界と同じ具合で自然にぼけて知覚される。

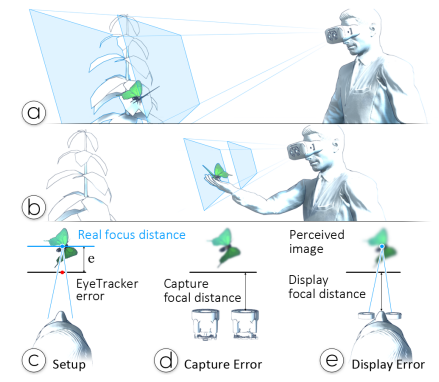

下の図のように、焦点を合わせられる3D映像(青白い長方形領域)を着用者の注視点位置に合わせて提示する。これらがリアルタイムに行われ、ユーザーのAR体験をより向上させる。

実世界に重ねるようにCGを配置できるAR技術のHMDには、大きく分けて光学式シースルー型HMDとビデオシースルー型HMDがある。前者は実世界にCGだけを表示する形式で、理想的だが視野が狭くオクルージョンも処理できず色やコントラストの再現性も低いなど多くの課題が残っている。

後者はHMD前の実世界をリアルタイムに撮影してその映像と一緒にCGを表示する形式で、ユーザーに届く光を完全に制御できるため、広視野を実現しVRへの移行も手軽に行え、キャプチャーした環境の共有もできる。

しかし、両者ともに輻輳(ふくそう)距離と調節距離の不整合問題を抱えている。この問題は、目の前のディスプレイを見ているのに実世界の奥行きある表現をしているため、目が対応できず眼精疲労を引き起こしたり不自然さを知覚したりする現象を示す。

具体的には、近くを見る時に寄り目になったり遠くを見る時に目が外側に開く人間が持つ輻輳機能と、ピントによって水晶体の厚みを変える調整機能の2つが実際には比例関係にならないといけないところを比例関係にならず不整合が起きている。調整はディスプレイに対して適応しているため固定されているが、輻輳は見る物によって寄ったり開いたりと角度を変えることが原因である。

ビデオシースルー型HMDは、測定された輻輳距離に応じて表示面を移動させられるが、これまで以上の正確なアイトラッキングを要求する。これに対し、2層ディスプレイは、アイトラッキングを必要とせず、複数の焦点距離で同時に焦点調整を提示できるが、効果の範囲が限られている。

そこで今回は、この両者の利点を組み合わせ、限られたアイトラッキングの精度と正確さで広いワークスペースに自然な焦点調整の提示を試みる。そのために、ユーザーの輻輳をリアルタイムに計測してカメラとディスプレイの焦点距離を同時に調整するビデオシースルー型HMDを提案する。

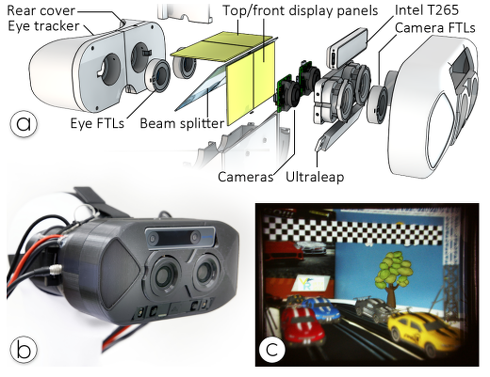

プロトタイプは、片目あたり2.9インチ液晶パネルで設計した2層ディスプレイ(解像度1440×1440、リフレッシュレート120Hz)、 ビームスプリッター 、焦点可変レンズ、アイトラッキングカメラなどで構成する。

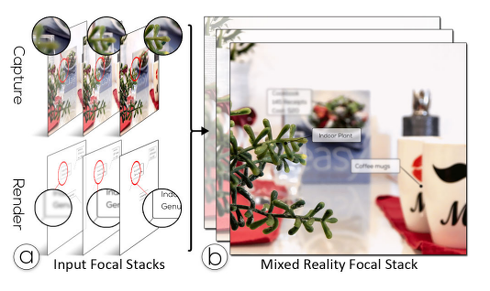

システムは、HMD前方のライブ映像のキャプチャーとフォーカルスタックのレンダリングで構成する。フォーカルスタックとは、焦点位置をずらしながら撮影した複数画像を合成し、まるで全ての面で焦点があったような画像を生成する手法である。

今回は7枚の画像のフォーカルスタックを用いて、2層の0.6Dボリュームを再構成する。この構成は片目あたり1つのGPUで1024×602ピクセルの処理解像度でリアルタイムに行え、約30msの応答速度を達成した。

今回の研究は、2022年3月に開催されたIEEE VR 2022にてBest Journal Paperを受賞した。

Source and Image Credits: C. Ebner et al., “Video See-Through Mixed Reality with Focus Cues,” in IEEE Transactions on Visualization and Computer Graphics, doi: 10.1109/TVCG.2022.3150504.

関連記事

「PS VR2」デザイン公開、丸みを帯びた形に 通風孔やレンズ間距離調整機能などの新機能も

「PS VR2」デザイン公開、丸みを帯びた形に 通風孔やレンズ間距離調整機能などの新機能も

「頭をなでる」「ビンタ」「ハグの拒否」などアバター同士の接触を滑らかにするVR技術、東工大が開発

「頭をなでる」「ビンタ」「ハグの拒否」などアバター同士の接触を滑らかにするVR技術、東工大が開発

東京工業大学長谷川研究室の研究チームは、バーチャル空間でアバター同士もしくは3Dオブジェクトとの接触の際に、両者が自然な動きで表現できる技術を開発した。頭をなでる、ハグするなどの動きを滑らかなリアクションで表現する。 VRヘッドセットのみで、全身3Dアバターの動きを生成 Microsoftが開発

VRヘッドセットのみで、全身3Dアバターの動きを生成 Microsoftが開発

MicrosoftのMixed Reality & AI Labの研究チームは、VR HMD(ヘッドマウントディスプレイ)から得られる頭部と手部のトラッキングデータから、着用者の全身の動きを3次元で表現する手法を開発した。 「バナナの皮ですべった」ができるローラースケート型VRデバイス さまざまな地面の触覚を再現

「バナナの皮ですべった」ができるローラースケート型VRデバイス さまざまな地面の触覚を再現

台湾大学と国立政治大学、米メリーランド大学による研究チームは、VRの臨場感を高めるために、足に多段階の不均一な摩擦フィードバックを与えるローラースケート型ウェアラブルデバイスを開発した。 VRキャラクターに耳を「フー」してもらえるヘッドフォン、東大が開発 風源なしで温冷風を再現

VRキャラクターに耳を「フー」してもらえるヘッドフォン、東大が開発 風源なしで温冷風を再現

東京大学 Human & Environment Informatics Labの研究チームは、物理的なファンによる風がないにもかかわらず、風の感覚を耳で得られるヘッドフォン型ウェアラブルデバイスを開発した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR