ITmedia NEWS >

セキュリティ >

ChatGPTの利用を社内で許可すべき? 懸念される情報漏えいリスクとは:事例で学ぶAIガバナンス(1/4 ページ)

» 2023年03月28日 12時00分 公開

[小林啓倫,ITmedia]

米OpenAIが発表した高性能対話AI「ChatGPT」。2022年末のリリース以来、関連記事をネット上で目にしない日はないと言っても過言ではないだろう。3月14日には、次世代大規模言語モデル「GPT-4」も登場。ChatGPTでも有料会員向けに提供を始め、さらなる盛り上がりを見せている。

一方で、ChatGPTの利用禁止に踏み切る企業も少なくない。例えば、米国の金融大手のJPモルガン・チェースは従業員のChatGPT利用を制限した。同じく米国のバンク・オブ・アメリカでも利用が禁止になったと報道があった。同社のブライアン・モイニハンCEOは、金融業界でこの種のテクノロジーを解禁するためには「いくつかすべきことがある(some work to do)」と発言したという。

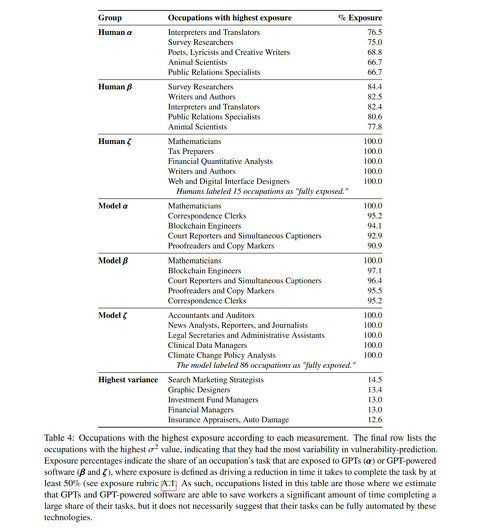

OpenAIと米ペンシルベニア大学の研究者らは17日、「GPTはGPT:LLMの労働市場への影響の可能性に関する初期の考察」と題したレポートを発表。その中で「米国の労働力の約80%が、GPTの導入によって少なくとも仕事の10%に影響を受ける可能性があり、約19%の労働者は仕事の50%に影響を受ける可能性があることが示された」としている。

これらの企業は業務に大きな影響を与えるChatGPTを、なぜ従業員に使わせようとしないのか。それはChatGPTに入力するプロンプト(ChatGPTに対する指示を表したテキスト)を通じた情報漏えいのリスクがあるためだ。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR