スマートスピーカーに生成AI、Amazonが先行 会話を記憶、ボディランゲージやアイコンタクトも理解(1/2 ページ)

米Amazonは9月21日(米国時間)、同社の音声アシスタント「Alexa」に生成AIを搭載すると発表した。これにより、継続した会話の他、会話の記憶や各家庭向けのパーソナライズも可能になるという。まずは米国のユーザー向けに今後数カ月以内に提供を始める。

従来のAlexaは会話内容を記憶せず、質問→応答の1往復しかできなかった他、応答パターンにも制限があった。生成AIの搭載により何往復も会話が可能になるだけでなく、ボディランゲージやアイコンタクトといった非言語的な合図も、Alexa搭載スマートスピーカー「Echo」のカメラや人感センサーなどから情報を得て理解するとしている。

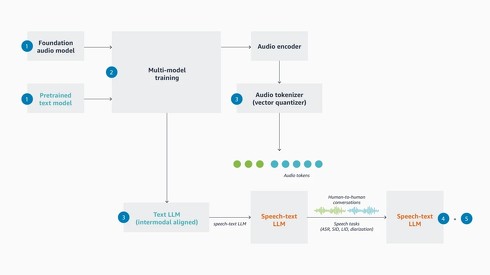

これらの機能は音声対話用にカスタマイズし最適化された新しい大規模言語モデル「Alexa LLM」に基づく。「人間が常に行うのと同じ方法で、会話全体を通じて関連する文脈を引き継ぐ」(同社)として、各家庭に合わせた独自の体験を提供する。AlexaのスマートホームAPIにも接続するため、曖昧な指示でも各スマートデバイスをプログラムできるという。

音声認識エンジンも刷新。人間が内容をまとめようとして話すのを一時的に止めたりしても、それを認識して流れるような会話が可能という。音声合成技術にはLLMアーキテクチャを採用することでより流暢に発音できるようになった。

プライバシーやセキュリティの懸念に対しては「コントロールと透明性を提供できる体験を設計する」とした。

スマートスピーカーへの生成AI搭載をめぐっては、米Googleも「Googleアシスタント」へ搭載する方針という報道がある他、米Appleの「Siri」も対応を進めているのではないかとする予測もあるが、Amazonが他社に先駆けた形になる。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR