ITmedia NEWS >

STUDIO >

Wikipedia、LLMによる記事生成を原則禁止に

» 2026年03月27日 14時14分 公開

[ITmedia]

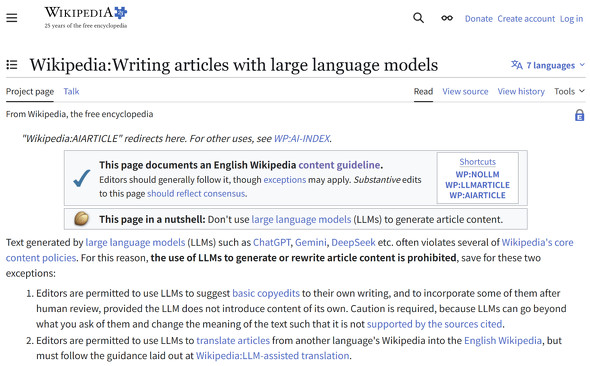

Wikipediaを運営する非営利団体Wikimedia Foundationは3月20日(UTC)にコンテンツガイドラインを更新し、記事コンテンツの生成または書き換えにLLMを使用することを禁止すると明記した。

「ChatGPT、Gemini、DeepSeekなどの大規模言語モデル(LLM)によって生成されたテキストは、Wikipediaのコアコンテンツポリシーのいくつかに違反することがよくあります。そのため、以下の2つの例外を除き、記事コンテンツの生成または書き換えにLLMを使用することは禁止されています。」とある。

2つの例外とは、編集者がLLMを使用して自身の文章に基本的な校正を提案し、人間のレビュー後にその一部を組み込むことと、LLMを使用して他言語版Wikipediaの記事を英語版に翻訳することだ。ただし、後者については、Wikipedia:LLM支援翻訳に記載されているガイドラインに従う必要がある。

記事がLLMで生成されたものかどうかの判断基準などは明示されていない。「編集者の中には、LLMと似たような文体を持つ人もいるかもしれません。制裁を正当化するには、文体や言語上の特徴だけでなく、より多くの証拠が必要であり、テキストがコアコンテンツポリシーに準拠しているか、また、当該編集者による最近の編集内容を考慮するのが最善です」となっている。

関連記事

Microsoft、AI時代のメディア信頼性レポート公開 多層的な「高信頼性認証」を提唱

Microsoft、AI時代のメディア信頼性レポート公開 多層的な「高信頼性認証」を提唱

Microsoftは、AI時代のメディア信頼性に関する調査レポートを発表した。単一の技術では偽造を防げないとし、出所情報(C2PA)と不可視透かしを強固にリンクさせる多層防御の「高信頼性の認証」を提唱。本物をフェイクと誤認させる新たな社会技術的攻撃への警告と共に、業界全体の設計図として活用を呼び掛けた。 AmazonやMetaなどAI企業5社がWikipediaの有償パートナーに

AmazonやMetaなどAI企業5社がWikipediaの有償パートナーに

Wikimedia Enterpriseは、Wikipedia誕生25周年に合わせ、AmazonやMicrosoft、Metaら5社を新たな有償パートナーとして発表した(Googleは2022年からパートナーになっている)。AIチャットボット等の基盤としてWikipediaのデータを利用するIT企業に対し、有償契約を通じた資金還元を求める動きだ。 Wikipedia運営元、AI企業にAPIを介したデータ使用料支払いを要求

Wikipedia運営元、AI企業にAPIを介したデータ使用料支払いを要求

Wikimedia Foundationは、AI企業にWikipediaデータの無断収集停止とAPI使用料の支払いを求めた。AIは人間による知識を必要とし、なければ「モデル崩壊」の恐れがあると主張。貢献の循環維持のためクレジット表示と、Wikimedia Enterpriseを通じた財政支援を要求している。 英語版Wikipedia、新規記事の5%がAI生成 米国の研究者らが調査 AIが生成した記事の特徴とは?

英語版Wikipedia、新規記事の5%がAI生成 米国の研究者らが調査 AIが生成した記事の特徴とは?

米プリンストン大学に所属する研究者らは、AIが生成した記事がWikipediaに含まれるかを調査した研究報告を発表した。研究チームは、2024年8月に新規作成された英語版Wikipediaの記事2909件を詳しく分析した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR