初音ミクとも簡単に対話できる「MMDAgent」、その詳細を聞いてきた

ニコニコ動画で初音ミクなどのMMD(MikuMikuDance)キャラクターと音声で対話できるシステム「MMDAgent」を発表した名古屋工業大学が、CEATEC会場でデモを行っている。開発を担当した名古屋工業大学国際音声技術研究所の徳田恵一教授、李晃伸准教授、大浦圭一郎特任助教に話を聞いた。

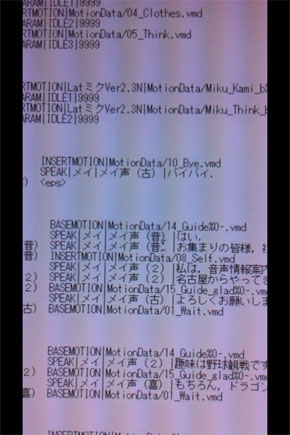

MMDAgentはこう記述する

ITmedia デモを見せてもらいましたが、最初の質問の回答が出る前に別の質問をしてもうまく対応できるんですね。

徳田教授 音声対話システムでは割り込みができず、命令が終わるまでじっと待っていなければならないものが多いのですが、MMDAgentは音声認識エンジンも自分たちで開発している(李准教授のJulius)ので、システム全体を密結合して割り込みをかけたりということも自在にできます。

ITmedia 対話のシステムはどのように構築するのですか。

李准教授 スクリプトに「1 101 RECOGNIZED|自己紹介」と記述されていれば、「自己紹介」という音声入力が含まれているとMMDAgentが認識したら、説明モーション「BASEMOTION|MotionData/14_Guide%0-.vmd」を動かし、「SPEAK|メイ|メイ声(普)|はい」という音声で応答するといった仕組みになります。

徳田教授 この場合、「メイ声(普)」というのは声質を示しています。

李准教授 音声認識と動作の対を書いていって、動作が終わったら、指定した番号のコマンドに移ります。発生していくいろいろなイベントと動作の対をたくさん作ることによって対話を実現しています。

ITmedia テキストエディタで書けちゃうわけですね。

李准教授 そうです。テキストファイルですから、書いてくわせれば動くのです。Text-to-Speachなので、しゃべる内容をテキストで書いておけばそのまましゃべってくれます。

徳田教授 いま、「アイティメディアの松尾さん、ようこそいらっしゃいました」と言わせることも簡単にできますよ。

ITmedia おおー。どういう言葉に対応するというのもできるわけですか?

李准教授 単語の追加とかもできます。

ITmedia スクリプトを見ると、「好きな男の子のタイプは?」とかありますね

徳田教授 このデモでお客さんに聞かれそうなことは入れてあります。「彼氏いるの?」とか「何歳?」とか。

ITmedia モーションの拡張子が.vmdになっていますが。

李准教授 MikuMikuDanceの.vmdファイルがそのまま使えます。

ITmedia これは表情モーションですね。ここで踊ったりはねたりすることも……。

李准教授 できます。デモではダンス用のモーションを貸していただいて、ここでそのまま再生させました。

ITmedia もっと複雑なこともできるわけですね。

李准教授 もう1つ、このシステム独自の特徴として、モーションの複数重ねあわせ再生ができます。歩きながらあいさつをするといったようなことができるんです。

たとえば音声を受けて「こんにちは」とあいさつをするときに、音声を認識し始めたときに眉を上げるモーションをするんですが、それとあいさつをするモーションが重ね合わせて一連の動きが作られます。音声が入り始めた瞬間に顔を動かすモーションファイルを重ねあわせ再生することで実現しているんで、本体はどんな姿勢でも動きます。

首から上が表情モーション、その下がボーンのモーションといったふうに。立っていたり、歩いていたりしていても、音声が入れれば眉を動かす。おもしろいモーションはちゃんと作り込みつつ、リアルタイムのイベントにもちゃんと反応を返してくれる。そうしたことが音声対話しているときの「話している」という感覚につながるのではと思って作っています。

ITmedia 周囲の騒音とか音量とかには反応しますか?

李准教授 今はありませんが、音声認識エンジンに検出・識別する機能を追加することは技術的に可能です。現在は、音声入力の開始と終了。そして認識の結果です。

ITmedia メイちゃんの声はどのように収集したんですか?

大浦助教 声優さんなどと契約しているスタジオに「このような文章をしゃべってもらえますか」とお願いして録音してもらったものを使いました。このキャラにどのような声が合っているのかというオーディションもして、20人くらいの候補の中から3人くらいまで絞って録音してもらいました。アニメっぽくなく、リアルすぎもしない、中間っぽい声で設計したのがこの声です。

録音したデータをHTS(隠れマルコフモデルによる音声合成システム)という音響モデルにかけて、Open JTalkという、漢字やかながまじった文章から日本語の音声を合成するシステムを通して発音しています。

ITmedia 初音ミクの声に関しては話者適応を使っているんですよね。

大浦助教 そうですね。VOCALOIDでは波形が出せますが、「VOCALOIDにしゃべらせてみた」といった、トークロイド系のVSQファイルを30個ほど収集し、それらから作った合成音声波形をモデル学習用のデータとして用いました。全体を通した長さは数分くらいです。これにHTSの話者適応の手法を使って元の話者の声質を真似ると、デモしたような、初音ミクっぽい声質の音響モデルができます。

心は作らない

ITmedia これをゲームに使うことは想定されていますか?

徳田教授 そういうものを開発していただいてもいっこうにかまわないです。これはあくまでツールキットで、コンテンツはユーザーの方々に作っていただくのが大事なコンセプトで、ゲームでもテーマパークでの案内でもいいですし。そういう面白いコンテンツを自由に作っていただくためのフレームワークなんです。

MikuMikuDanceみたいなものが公開されて、面白いモデルや動画がどんどん作られているわけですから、そういったCGM的な感じで音声対話のためのコンテンツが作られるようになったらいいなあ、というのがこのプロジェクトの基本コンセプトです。

ITmedia スクリプトの共有などを名古屋工業大学で行うことは考えていますか?

徳田教授 ユーザーの方々が「こういうの作ったよ」とか部品としてどんどん公開していただくことを期待しています。自分のところでホスティングするというのではなく、いまはニコニコ動画を中心としたコミュニティーがうまく形成されているのでわれわれが特にやる必要はないと思います。

李准教授 モーションファイルをどんどん作って公開してほしいです。

徳田教授 そして動画として投稿してほしいですね。

ITmedia これを完全に自律したシステムとして提供することは考えていますか?

徳田教授 われわれは心は作らない。羊か狼かはわからないけれど、外側の皮を作る。心を入れるのはユーザーのみなさんですよ。これで人工知能を作るといったことを、われわれはやろうとしていません。それをユーザーの方に簡単やっていただけるフレームワークを提供したいのです。

ITmedia そのために、感情で変わる声というのも。

徳田教授 そういったものを提供していきたいと考えています。逆にユーザーの方も、もっとこんなしゃべり方をする声のモデルを作った、公開しました、ということが進んでいけばいいかな、と。

次のSinsyは英語、中国語も歌う

ITmedia MusicXMLを記述するだけでリアルな歌声を生成するSinsyについてですが、今後の予定はどのようになっていますか?

徳田教授 いまは日本語、中国語、英語の3カ国語を歌える人に歌声を収録してもらっています。CEATECが一段落したらできるだけ早く、3カ国語で歌える歌声モデルを紹介したいと思います。

ITmedia 男声版はどうですか?

徳田教授 研究室の中に男声モデルが1つあるんですが、データが古くてサンプリング周波数が低かったので、まだ迷っている感じですね。むしろ、MusicXMLと歌声のWAVファイルがあれば、自動的に学習できるので、そういったデータを提供してくださる方がこれからどんどん現れたらいいな、と考えています。Twitterで#sinsyハッシュタグでつぶやいていただくと、希望者にコンタクトさせていただいています。いくつか進めているものもあります。そういった方々の音声モデルがSinsyのページに掲載されれば、さらに自分の歌声を使いたいという人が増えてくるのではと思っています。

名古屋工業大学のCEATECブースは、すべてMMDAgentの開発チームがロゴからなにから自作した、外注を一切使わない手作り感あふれるものだ。そこでMikuMikuDanceなどのCGMコミュニティーと密接に連携する3Dの音声対話システムが作られ、オープンソースのフレームワークとして公開されようとしている。ユーザーが次々に「心を入れていく」日が来るのが待ち遠しい。

関連記事

初音ミク、エージェントになる?――名工大「MMDAgent」がもたらす未来

初音ミク、エージェントになる?――名工大「MMDAgent」がもたらす未来

画面に話しかけると3Dの初音ミクがエージェントとなって答えたり踊ったりする――そんな技術が話題を呼んでいる。 「神ツール」――初音ミク踊らせるソフト「MikuMikuDance」大人気

「神ツール」――初音ミク踊らせるソフト「MikuMikuDance」大人気

「初音ミク」の3Dアニメを作成できる無料ソフト「MikuMikuDance」が人気だ。その質の高さに「お金を払いたい」というユーザーも続出したが、開発者は「お金ではなく、すばらしい動画を作って見せてほしい」と話す。- 謎の歌声合成技術「Sinsy」の情報を集めてみた

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR