GoogleはAIカメラに「心に残る瞬間」を教え込めたのか:Googleさん

Googleが昨年10月のハードウェアイベント「Made by Google」で披露した、AI搭載の小型ハンズフリーカメラ「Google Clips」が1月26日(現地時間)、米国のGoogle Storeにようやく登場しました(購入ボタンはありますが、出荷は早くても2月下旬です)。

「そんなもの発表されたっけ」という人(それは私)が多いと思うのでおさらいすると、Clipsは、カメラ自身がいいなと思うシーンを“モーションフォト”(音のない短い動画)として勝手に撮影して内蔵の16GBストレージにどんどん保存していく49×49×20ミリ、42.2グラムの小型カメラ。お値段249ドル(約2万7000円)とお高いのは、AI搭載だからなんでしょう。下はClipsで撮影したモーションフォトの例です。

発表されたとき、一連のGoogleのオリジナル製品とはなんだか違うニオイだし、なんでいまごろライフログカメラなの? と思ったものですが、プロジェクトの中の人でインタラクションデザイナーのジョシュ・ラブジョイさんのブログを読むと、どうやら人工知能の研究のために作ったようです。3年がかりで。

長い長いブログのサブタイトルは「Google Clipsを使って、人間中心の設計プロセスがAIをどのように向上させるかを理解する」。Clipsの設計思想は「人間中心」なのでした。

研究者というのは、うっかりすると研究自体が目的になりがちですが、GoogleのAI研究チームは常に「どんなに強力なシステムを構築しても、それが人間が必要とするものでなければ何の役にも立たない」ということを肝に銘じているそうで、じゃあAIを使ってできる人が必要とするものはなんだろう、と考えた結論の1つがこの、誰でも簡単に、生活の大事な瞬間をクリアに残せるカメラなのだそうです。

研究者も人の親。ラブジョイさんも2人のかわいい息子の写真をスマホで日々撮り続けていたので、こういう発想になったのでしょう。

スマホだと自分が子どもと遊んでいるところは撮れませんが、例えば起動したClipsの前で子どもと一緒に遊んでいれば、“いいシーン”を撮影してくれます。Clipsは誰がおなじみの顔かを覚えているので、ユーザーが一番大切にしている人(例えば子ども)がちゃんとフレームに収まって“いいお顔”になっている瞬間を判断して撮影します。Googleが「Moment IQ」と名付けたご自慢の機械学習アルゴリズムです。

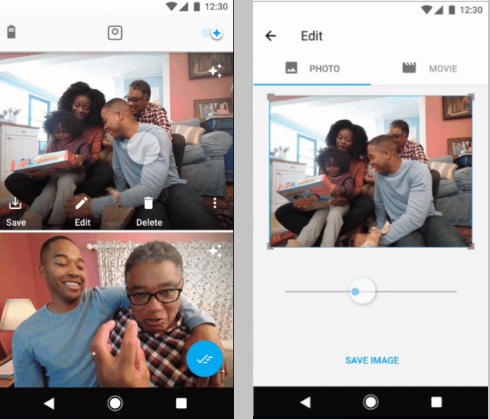

そうやって撮影したモーションフォトはWi-Fiで接続したAndroid端末でチェックでき、ずっと残したいものがあればGoogleフォトなどに転送できます。

ClipsのAIは、Googleフォトと同じようにいいと思うモーションフォトをお勧めもします。でも、最終的に何を選ぶかは人間です。撮影するのがスチル写真じゃなくてモーションフォトなのも、そこからベストショットをユーザーが選べるからです。

ブログによると、最初は人間にとっての“いいシーン”をAIに教えるために、プロの写真家(ドキュメンタリー映画のカメラマン、報道写真家、アート写真専門のカメラマンなど)に協力を仰ぎ、人間にとっての「忘れられない瞬間」の要素は何かを定義していこうとしたそうです。下のGIF画像は、ラブジョイさんにとっての「忘れられない瞬間」の例です。

でも、人間にとっては理解できるドラマチックな照明や三分割法などをAIに理解させるのは「2才児に英語を教えるのに『それいけ、わんちゃん!』ではなくシェークスピアを読み聞かせるようなもの」だったと悟って、地道な学習方法に切り替えました。

つまり、“悪いシーン”のサンプル(ポケットの中で撮影しちゃっていたり、レンズに指がかかっていたりする動が)を教えたり、顔認識で親しい人ほどフレームの中心になるよう訓練するなどです。

最終的に出来上がった製品としてのClipsは、でも、完全自動カメラではなく、ユーザーが自分で撮影するシャッターボタンもつきました。たぶん、例えばラブジョイさんの息子が初めて補助輪なしで自転車に乗れた瞬間(上の右端の動画)など、人間にとって忘れがたい記念すべき瞬間でも、Clipsは「ブレブレだし顔写ってないじゃん」と思って“いいシーン”だと判断できないからでしょう。

ラブジョイさんは「主観とパーソナライゼーションについては、完璧にするのは不可能だし、それを目指すべきではない」と言います。3年間のプロジェクトで学んだことです。「AIは、自動化することにではなく(人間の可能性を)拡張することに使うべき」とも書いています。

AI研究で先端にいるGoogleのチームがAIによる完全自動化を目指さないことにしたのであれば、なんだかほっとします。ラブジョイさんは不可能だと言うけれど、今後もしかしたらプロカメラマンと同じように美を理解できるAIが作れるかもしれません。それでもAIを人間のサポートと位置づけ、最終判断は人間ができるようにしていられれば、「ターミネーター」の世界は来ないでしょう。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR