あの日見た花の名前をGoogle Lensはもう知ってる:Googleさん

Googleさんが2月に、AI(人工知能)採用の画像検索技術「Google Lens」をiOS版「Googleフォト」(ただし英語のみ)でもうすぐ使えるようにするよ、と発表してから、ずっとiPhone(記事を書くための確認用)を英語設定にして待っていました。

Google Lensはかつての「Google Goggles」のような、画像を解析してそれが何かを説明してくれるAI機能です。これまでは日本では売らない「Pixel 2」シリーズでしか使えませんでした。

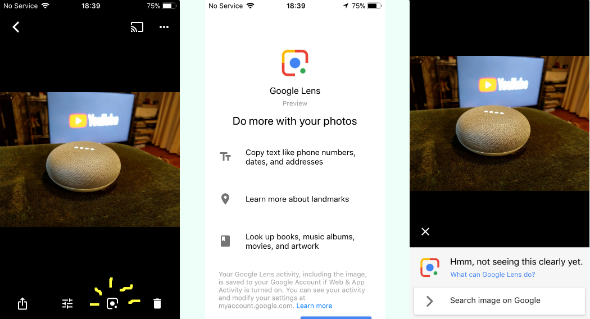

さきほど(3月22日の夕方)、ついに私のiPhoneのGoogleフォトアプリでもGoogle Lensのアイコン(下図左の画面下の方にあるやつ)が表示されるようになりました。

たまたま表示していたGoogle Home Miniの写真は「んーと、これはまだはっきりわかんないや」と言われちゃいました。いろいろやってみたところ、得意不得意があるようです。

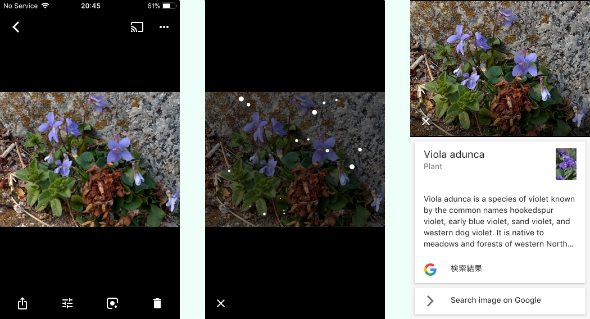

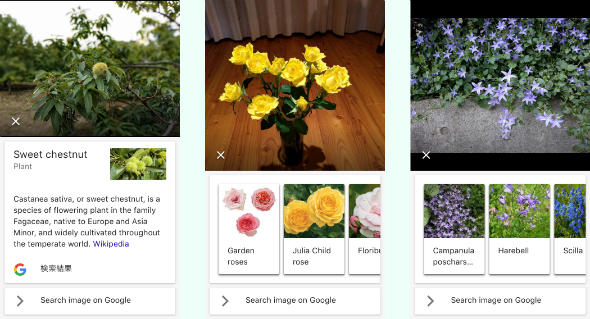

特に感心したのは花の名前を当てられること。Google Gogglesにはできなかったことです。

確信がある場合は1つだけ、自信がないときは複数の候補をカルーセル状に表示します。

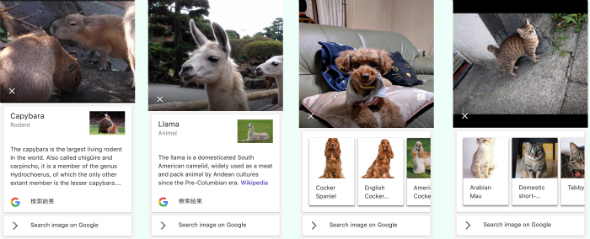

動物も分かりやすい写真であればけっこう当たりました。トイプードルと近所のにゃんこははずれ(猫は雑種だと思う)。

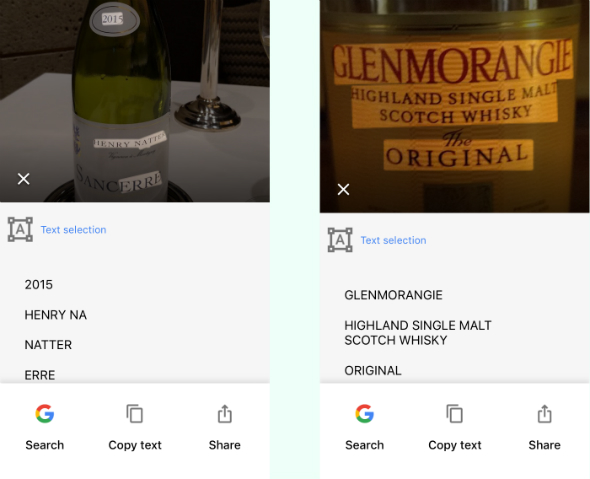

テキストの読み取りはGoogle Gogglesの方が得意だった印象です。Gogglesではレストランでワインのボトルの撮影をしては検索していました。Google Lensは一部しか読み取れず、なかなか正解になりません。本のカバーも2、3冊やってみましたが、どこを読み取ったらいいか迷っている感じで、タイトルを抜き出せませんでした。

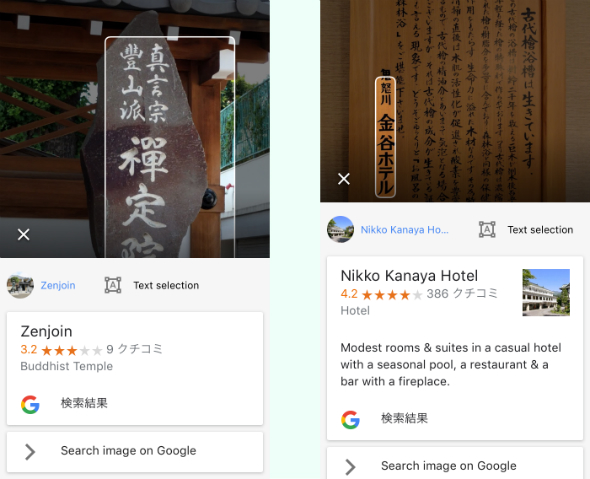

英語版ですが、Google Lensは翻訳もできるので、日本語を読み取って英語で説明します。お寺の名前とかよく分かったなと関心しましたが、写真の位置情報タグも参考にしていそうです。

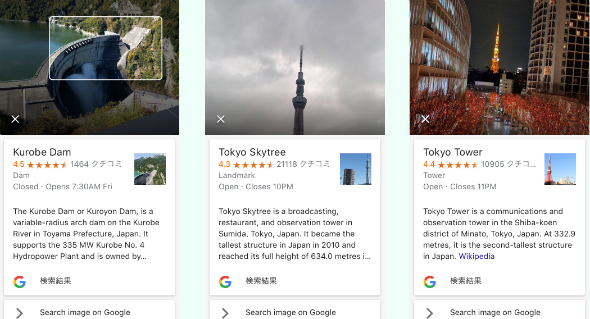

名所も結構当たりました。

まだ実用的と言うにはあと少しな感じですが、いろいろ遊んでいたらもっと写真を撮りたくなりました。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR