音声合成は「落語」で人を笑わせられるのか?

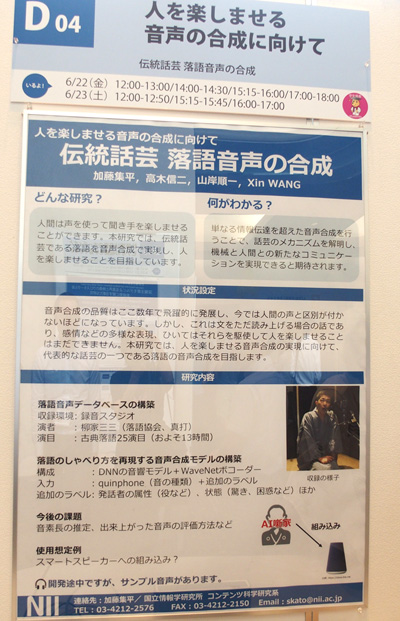

人間の声を人工的に作る「音声合成」で、日本の伝統話芸「落語」を再現できるのか――国立情報学研究所(NII)が主催する、研究発表・公開イベント「国立情報学研究所オープンハウス2018」(6月22〜23日、学術総合センター)で、こんな研究成果が展示された。

ディープラーニング技術の活用で、ここ数年で音声合成の品質は飛躍的に向上した。人間の肉声と区別がつかないような音声合成も現れている。

しかし、AI(人工知能)アナウンサーのような情報伝達の役割を重視する音声合成が実用化される一方で、小説の読み上げなど感情表現が必要になってくるものはまだ発展の余地が大きい。

特に落語は、しゃべり方、間の取り方などが独特で音声合成では再現しにくい領域だ。なぜ加藤さんは研究対象に落語を選んだのか。研究内容の詳細や課題、研究を通して見えてくるものは何なのかを聞いた。

なぜ「落語」なのか

総合研究大学院大学博士課程の加藤集平さん(山岸順一准教授の研究室に所属)は、「落語の目的はお客さんを笑わせること。落語を研究することで、まだ解明されていない音声の役割を明らかにしたい」と話す。

「人を楽しませる音声合成」の可能性を探る上で、漫才、漫談、舞台なども研究候補として挙がったという。漫才や漫談ほどアドリブがなく、落語家が1人で話す伝統話芸の落語が適切と判断した。

落語のしゃべり方を再現する音声合成モデルは、ディープニューラルネットワーク(DNN)の音響モデルと、人工ニューラルネットワークによる音声合成アルゴリズムの1つである「WaveNet」のボコーダーで構成。学習データとして、落語家の柳家三三さん(落語協会、真打)が話した古典落語25演目(約13時間)をスタジオで録音した。

「落語の勉強をするため、落語教室に通い始めました」と加藤さんは笑う。音声合成で再現するには、まず落語について理解することが重要という。

音声合成はテキストを基に読み上げをするが、落語の噺には決まった原稿がない。音声合成が読み上げるためのテキストデータは、録音データを基にいちから書き起こしているという。

話し言葉自体、文法が崩れているためテキスト解析が難しい上、落語のしゃべり方は特に独特だ。(1)本来ならノイズとして取り除く言いよどみも再現しないといけない、(2)極端に長い文や短い文があり、発音推定の質が落ちる、など悩みの種は多い。

特に音素長(音の長さ)の推定は、自然な話し方に聞こえるかどうかに関わる重要な要素という。今の音声合成は淡々とした声だが、音素長推定がうまくいくと緩急のついた話し方が可能になるとしている。

「音声合成で豊かな表現をするのは難しいですが、学習データから似たような表現(驚き、悲しみなど)を見つけて抽出する手法はあります。ただ、単純に行うと文脈などを無視してしまうので課題はありますが」(加藤さん)

音声はまだ解明されていないことが多い

落語の話芸メカニズムを解明することで何が見えてくるのか。加藤さんは「音声についてまだ解明されてないことは多い」とし、「一般的に音声は情報伝達の手段であるとされているが、それだけでは落語や漫才でお客さんが笑う理由を説明できないと思う」と続ける。

研究を通して話芸のメカニズムを解明し、単なる情報伝達手段ではない音声合成を生み出すことで、機械と人間の新たなコミュニケーションを実現したい考えだ。

利用想定として、スマートスピーカーへの組み込みなどをイメージしているという。「ただ、それだけでは本物の落語を聞きに行った方がいいですよね」と続ける加藤さんが落語研究の先に見据えるのは、アシスタントやエージェントだけではない音声合成との付き合い方。

「実は、SiriやGoogle Homeとケンカしたいと思っていて。でも淡々と返答するSiriとケンカする人なんて今はいないですよね。そんな人間と対等な関係になれる音声合成を実現したい」と展望を語った。

関連記事

自然な音声作る「WaveNet」の衝撃 なぜ機械は人と話せるようになったのか

自然な音声作る「WaveNet」の衝撃 なぜ機械は人と話せるようになったのか

流ちょうな日本語を発声するスマートスピーカー。「こんな音声合成ができるにはあと10年かかると思っていた」と研究者は衝撃を受けている。これを実現したWaveNetとは何か。スマートスピーカーを作る技術がどんなものかを研究者に聞く。 「あなたに似た声」、なんのために?

「あなたに似た声」、なんのために?

あなたは自分の声のコピーを持ってますか? わたしは2つ持ってます。 「ねえグーグル、アレクサって知ってる?」 2歳児、「Google Home」「Amazon Echo」と仲良しになる

「ねえグーグル、アレクサって知ってる?」 2歳児、「Google Home」「Amazon Echo」と仲良しになる

2歳の息子は、Google HomeとAmazon Echoとのおしゃべりが大好きだ。「ねえグーグル、アレクサって知ってる?」。Google Homeに対して、こんなぶしつけな質問も。スマートスピーカーは、スマートスピーカーは、育児にも便利なツールだ。 なぜ人気? ポケモンとスマスピで話すだけ 「ピカチュウトーク」が見つけた市場の“隙間”

なぜ人気? ポケモンとスマスピで話すだけ 「ピカチュウトーク」が見つけた市場の“隙間”

スマートスピーカーで使える、ピカチュウとおしゃべりできる機能「ピカチュウトーク」が老若男女に人気だ。どのような背景で生まれたのか、ポケモン社に聞いた。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR