ITmedia NEWS >

STUDIO >

Google、AIチップ「TPU」はGPUより30倍速い

» 2017年04月06日 09時30分 公開

[佐藤由紀子,ITmedia]

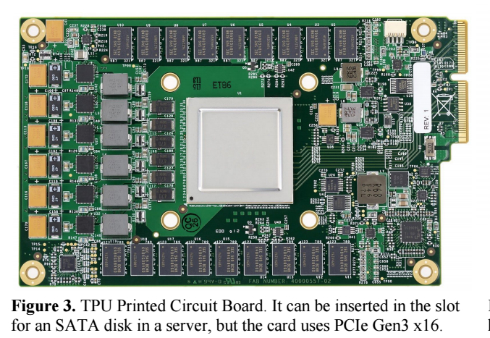

米Googleは4月5日(現地時間)、AlphaGoや様々なサービスで利用しているオリジナルプロセッサ「TPU(Tensor Processing Unit)」についての論文(リンク先はPDF)を発表し、その性能について説明した。

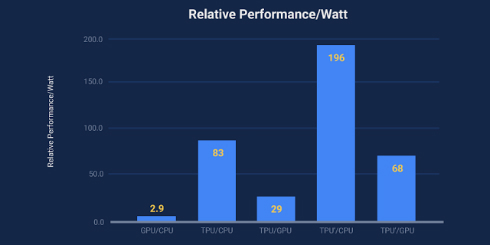

Googleは現在はTPUを、主に人工知能の推論(学習済みモデルを使う)フェーズで使っているという。そのAIワークロードでは、TPUはGPUやCPUよりも15〜30倍高速で、30〜80倍エネルギー効率が高いとしている。

なお、ここで比較しているCPUは米IntelのHaswell世代の「Xeon E5-2699 v3」、GPUは米NVIDIAの「Tesla K80」で、いずれも実際にGoogleのデータセンターで稼働しているものだ。

Googleは約15年前から各種サービスで機械学習を採用している。6年前にはディープラーニングの採用を開始し、その処理には膨大なコンピューティングパワーが必要になることを予測してTPUの開発に着手したという。例えばユーザーが1日当たりGoogleで音声検索を3分使うだけで、2倍のデータセンターが必要になる計算だった。

TPUは現在、Google画像検索、Googleフォト、Google翻訳、Google Cloud Vision APIなどで使われている。

GoogleはTPUの商用化はしないとしているが、今後もTPUの関連情報を公開してくという。

関連記事

Google翻訳が進化 日本語にもニューラルネット適用、自然な訳に APIも公開

Google翻訳が進化 日本語にもニューラルネット適用、自然な訳に APIも公開

米Googleは、ニューラルネットを活用した新しい機械翻訳システムを、日本語など8言語に適用した。翻訳の「飛躍的な前進」としている。 Intel、機械学習最適化チップを手掛けるディープラーニングのNervanaを買収

Intel、機械学習最適化チップを手掛けるディープラーニングのNervanaを買収

Intelが、ディープラーニングに最適化したASICやソフトウェアを手掛ける新興企業Nervanaを買収した。同社の技術でIntel XeonおよびIntel Xeon Phiプロセッサのディープラーニング性能を強化する。 Google I/O 2016の基調講演まとめ AI中心、VRの取り組みも

Google I/O 2016の基調講演まとめ AI中心、VRの取り組みも

Google I/O 2016の基調講演ではAIアシスタントの「Google Assistant」やVRプラットフォーム「Daydream」などの他、Android Nの進捗などが発表された。主な項目をまとめてみた。 Facebook、ディープラーニング向けハードウェア設計をオープンソース化

Facebook、ディープラーニング向けハードウェア設計をオープンソース化

人工知能研究ラボを持つFacebookが、自社開発したディープラーニング向けハードウェア「Big Sur」の設計をデータセンター技術のオープンソース化プロジェクト「Open Compute Project(OCP)」でオープンソースで公開する。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR

プロ棋士・李世ドル九段と対戦したAlphaGoのラック

プロ棋士・李世ドル九段と対戦したAlphaGoのラック