「OK Google」「Hey Siri」の微妙な“言い方”を区別し、音声アシスタントの誤認識を軽減 東大などが開発:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

東京大学大学院情報学環の暦本研究室とソニーコンピュータサイエンス研究所(CSL)の研究チームが開発した「Aware: Intuitive Device Activation Using Prosody for Natural Voice Interactions」は、「OK Google」や「Hey Siri」のような音声アシスタントを起動させる音声コマンドの誤認識を軽減する学習ベースの分類モデルだ。

会話のニュアンスを読み取り、その言葉が音声アシスタントを起動させたいのか、それとも起動させたいわけではなく会話の中でただ言っているだけなのかを区別する。

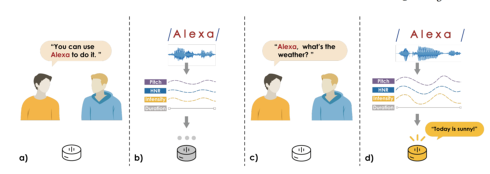

(a)ある人がスマートスピーカー「Alexa」を別の人に紹介している、(b)韻律パターンから、デバイスはその人が自分を呼んでいないと判断し、何も応答しない、(c)ある人がAlexaを呼び、天気を聞いている、(d)デバイスは自分を呼んでいると判断し、音声応答している

(a)ある人がスマートスピーカー「Alexa」を別の人に紹介している、(b)韻律パターンから、デバイスはその人が自分を呼んでいないと判断し、何も応答しない、(c)ある人がAlexaを呼び、天気を聞いている、(d)デバイスは自分を呼んでいると判断し、音声応答しているApple SiriやGoogle Assistant、Amazon Echoなどの音声アシスタントは、「Hey Siri」や「OK Google」「Alexa」などと発話し起動させる。それがユーザーにとって音声アシスタントと対話したい時なら問題ないが、会話の途中に使っているだけで、呼びたくないのに反応してしまった場合は問題がある。

また全く異なる単語を聞き間違えて反応するケースも多い。例えば、Amazon Echoは「unacceptable」や「election」という単語を「Alexa」と勘違いし反応する場合がある。

このような誤認識があると、デバイスが予期せぬ行動をとってしまいユーザーにとって損失になる可能性がある。スマートスピーカーを誤って作動させてしまう用語が1000以上あると報告している研究や、Amazon Echoユーザーが発する音声コマンド上位3つが「Alexa stop!」「Alexa」「Stop」だと報告している研究があることからも分かるように、音声アシスタントの誤認識は大きな課題といえる。

一方で、人間は一般的に相手が話す内容だけでなく、話し方からも相手の意図を読み取ることができる。例えば、同じ文章でも言い方が速いと怒っているという感情を察知する。同様に、聞こえてくる会話に自分の名前が入っていた場合、その話し方から自分を呼んでいるのか、それとも単に自分のことを指しているのかを区別できる。直感的にその会話のニュアンスを読み取れるわけだ。

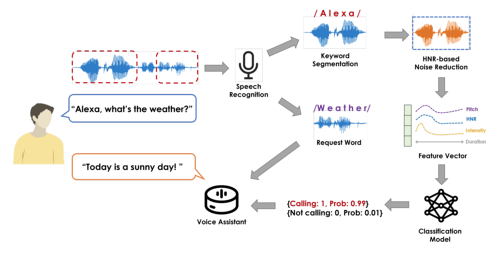

研究チームはこの会話のニュアンスに着目し、同じ言葉でも韻律パターン(ピッチ、声質、強度、持続時間など)の変化から、音声アシスタントを起動したい音声なのか、そうでないのかを区別するのに使えるのではないかと考えた。

研究では、まずデバイスを呼び出す声/呼び出さない声を収集し、この2種類の声の違いを探った。また、人はさまざまな距離や方向からデバイスを呼び出せるため、これらの環境要因が拾った特徴量にどのような影響を与えるかを調査した。

具体的には、マイクアレイを使用し、多方向・多距離から発話されたデバイスの呼び出し/非呼び出しのキーワードと文章を含む音声データセット(9万サンプル以上)を集めた。このデータセットから、ピッチ、声質、強度、持続時間などの変化を分析する。

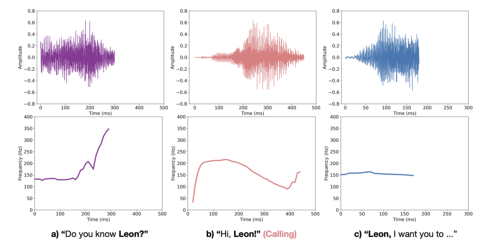

これらの分析結果から次のようなことが分かった。例えば、デバイスを呼び出す声は、最初にピッチが少し上昇しその後低下するが、ただの会話では平たんなピッチを保つ。デバイスを呼び出す声は、呼び出さない声よりも長くなる傾向がある。声質は、デバイスを呼び出す方がより明瞭で音量が大きいなど。呼び出す声の方向や距離が違ってもロバストであることも分かった。

これらの分析結果をもとに、韻律パターンでデバイスを呼び出すかどうかを区別するためのCNN(Convolutional Neural Network)による分類モデルを開発した。この分類モデルを用いて音声アシスタントの起動を制御するスマートスピーカーのプロトタイプ「Aware」を試作した。

評価実験では、AwareとAmazon echoを比較したユーザー調査を行った。その結果、AwareはAmazon echoと比較してより正確にデバイスを起動できると分かった。また、Awareは学習しやすく使いやすいと評価され、日常生活でも使ってみたいという声が得られた。

良好な結果が得られたため、未知の単語を適切な韻律で発話させた場合のモデルの性能についての検証も行った。その結果、モデルはほとんどの非呼び出し音声に対して反応せず良好な精度を示した。これらの結果から、韻律が特定の単語の発音に依存せず、話者の意思を部分的に特徴付ける可能性があることを示唆した。

Source and Image Credits: Xinlei Zhang, Zixiong Su, and Jun Rekimoto. 2022. Aware: Intuitive Device Activation Using Prosody for Natural Voice Interactions. In CHI Conference on Human Factors in Computing Systems (CHI ’22). Association for Computing Machinery, New York, NY, USA, Article 432, 1-16. https://doi.org/10.1145/3491102.3517687

関連記事

15インチの壁掛けスマートディスプレイ、Amazonが発売 2万9980円

15インチの壁掛けスマートディスプレイ、Amazonが発売 2万9980円

アマゾンジャパンは23日、スマートディスプレイ「Echo Show 15」の予約受付をAmazon.co.jpで始めた。価格は2万9980円(税込)。 「Alexa、○○をプリントして」 声で印刷できる機能リリース

「Alexa、○○をプリントして」 声で印刷できる機能リリース

「Alexa、○○をプリントして」と話しかけるだけで、買い物リストや数独パズル、迷路などのコンテンツを、Alexa対応プリンタで印刷できる新機能。 喋る「ハローキティロボット」誕生 受付や接客での活用見込む サンリオとNTT東が共同開発

喋る「ハローキティロボット」誕生 受付や接客での活用見込む サンリオとNTT東が共同開発

サンリオが、「ハローキティ」型のコミュニケーションロボットを8月に発売する。開発に当たってはNTT東と協力。価格は5年間のリース契約の場合で月額7万5900円。接客や受付業務での活用を見込む。 「何かに集中していて、聞き取れなかった音声」を後から再生できるイヤフォン 京セラが開発

「何かに集中していて、聞き取れなかった音声」を後から再生できるイヤフォン 京セラが開発

京セラ研究開発本部フューチャーデザインラボの研究チームが人間拡張研究の一環として、何かに集中していて聞き逃した音声を後から教えてくれるヒアラブルデバイスを開発した。 「ポーズ」と「合言葉」がなければ開かない自動ドア、文教大が開発

「ポーズ」と「合言葉」がなければ開かない自動ドア、文教大が開発

文教大学川合研究室の研究チームは、音声と姿勢で認証する自動ドアの開閉システムを開発。自動ドアに設置したカメラで姿勢推定と音声認識を行い、あらかじめ決めておいたポーズと言葉が合致すれば開く。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR