Google、文章から動画を生成するAI「Imagen Video」を紹介 Metaに続き

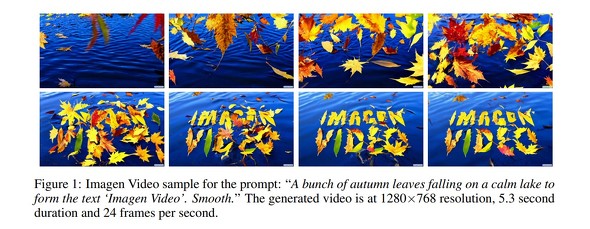

米Googleの研究部門Google Researchは10月5日(現地時間)、短い文章から動画を生成するAIシステム「Imagen Video」をサンプルを添えて発表した。「車を運転するパンダ」「静かな湖面に落ちた紅葉がImagen Videoの形に浮かぶ」など、文章から生成した多数の動画を披露した。

Imagen Videoは、同社が5月に発表した文章から画像を生成する「Imagen」に基づいている。Imagenは「拡散モデル」で、多数の既存のデータサンプルを使って“破壊”と“回復”の方法を学習することで、新たなデータを生成する。

Imagen Videoの動画生成の流れは大まかには、文章を受け取ったAIが24×48ピクセルで16フレーム、毎秒3フレームの動画を生成し、この動画から追加のフレームをアップスケールして予測して最終的には128フレーム、毎秒24フレームの720pの動画にする。

Google Researchは、Imagen Videoを1400万件の動画とテキストのペア、6000万件の画像とテキストのペア、公開されているLAION-400Mの画像とテキストのデータセットでトレーニングした。LAION-400MはStable Diffusionのトレーニングでも使われている。

Imagen Videoの特徴の1つは、紅葉で「Imagen Video」と表示するように、テキストを読めるレベルの文字にレンダリングできる点だ。Stable DeffusionやDall・E 2では今のところそれが難しい。また、アーティストのタッチを取り入れたり、3Dにしたりすることもできる。

とはいえ、Googleが披露したサンプルは米Metaが披露した「Make-A-Video」のサンプルと同様に、まだ不鮮明で不自然なところがあるものが多い。

Google Researchは同日、より長い文章で2分以上のストーリー性のある動画を生成できるもう1つのAIシステム「Phenaki」も発表した。Imagen Videoチームのジョナサン・ホー氏は「PhenakiとImagen Videoの強みを組み合わせるのが楽しみ!」とツイートした。

なお、Imagenと同様に、露骨で暴力的なコンテンツが生成される懸念が軽減されるまでは、Imagen Videoのモデルおよびソースコードは公開しない。

関連記事

文章から“3Dモデル”をAIが生成 米Googleなどが「DreamFusion」を開発

文章から“3Dモデル”をAIが生成 米Googleなどが「DreamFusion」を開発

米Google Researchと米UC Berkeleyの研究チームは、テキストから3Dオブジェクトを生成するシステムを提案した研究報告を発表した。「DreamFusion」と呼ぶこの手法は、テキストから2D画像を生成する拡散モデルを用いて、テキストから3次元への合成を実行する。 Meta、動画生成AI「Make-A-Video」を発表 「肖像画を描くテディベア」などの作品公開

Meta、動画生成AI「Make-A-Video」を発表 「肖像画を描くテディベア」などの作品公開

Metaが動画生成AI「Make-A-Video」を発表した。「Stable Diffusion」や「Midjourney」、「DALL・E 2」などの画像生成AIの動画版。「浜辺を走るユニコーン」などの生成作品を公開した。 文章から“動画”を自動作成するAI、中国の研究チームが開発

文章から“動画”を自動作成するAI、中国の研究チームが開発

中国の清華大学の研究チームは、簡単なテキストを入力に、その文章を基にした簡単な動画を自動作成する機械学習モデルを開発した。 Google、文章から画像を生成するAI「Imagen」 「DALL-E 2より好まれる」

Google、文章から画像を生成するAI「Imagen」 「DALL-E 2より好まれる」

Google Researchは、文章から画像を生成する拡散モデル「Imagen」を発表した。独自ベンチマークではOpneAIの「DALL-E 2」よりも人間に好まれる結果が出たとしている。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR