Google DeepMind、ロボットの行動を改善する新VLAモデル「RT-2」発表

米Google傘下のGoogle DeepMindは7月28日(現地時間)、視覚と言語を行動に翻訳する新しいVLA(Vision-Language-Action)モデル「RT-2」を発表した。

RT-2 は、Web上のテキストと画像でトレーニングされたTransformerベースのモデルで、ロボットのアクションを直接出力できる。LLM(大規模言語モデル)をWeb上のテキストデータでトレーニングするのと同様に、RT-2はWeb上のデータから知識を転送してロボットの動作に情報を与える。

これにより、従来は例えば「コーラの空き缶をゴミ箱に捨てて」という命令を実行するためには、コーラの缶とはなにか、それが空になっていることはどうやって判断するか、物体を掴むにはどうすればいいのか、ゴミ箱とはなにか、ゴミ箱に捨てるというアクションはどういうものか、など、膨大な定義をロボットに教える必要があったところ、初めてコーラの空き缶を見ても、それがコーラの空き缶だと認識でき、「捨てる」というアクションの意味も理解するようになる。

Google DeepMindのロボティクス責任者、ヴィンセント・ヴァンホーク博士は「RT-2はWebデータの大規模なコーパスから知識を転送できるため、ゴミが何であるかを理解しており、明示的なトレーニングなしで識別できる」と説明する。「ポテトチップスの袋やバナナは、食べた後にゴミになる。RT-2は視覚言語トレーニングデータからそれを理解できる」。

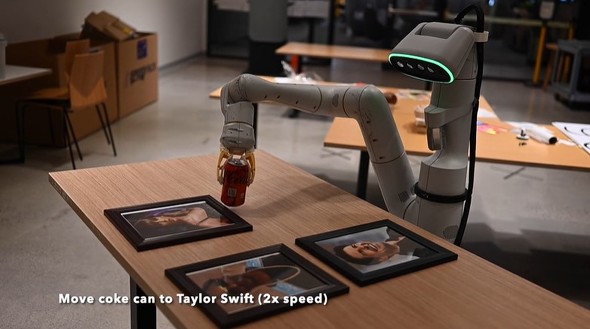

デモでは、「バナナをドイツの国旗の上に置いて」「コーラの缶をテイラー・スウィフトの肖像の近くに移動して」「イチゴをイチゴが入っているボールに入れて」などの命令を実行させている。国旗やテイラー・スウィフトについてはWeb上の画像から学習したのだろう。

モデル名から分かるように、RT-2には先代にあたるRT-1があった。2022年12月に発表したRT-1は、ロボットが自分の経験から学習し、それを他のロボットと共有できるようにする相互に学習できるようにするロボティクストランスフォーマー(RT)モデルだった。

RT-2モデルをテストした結果、新しいタスクの実行効率はRT-1は32%だったところ、RT-2は62%に向上したという。「RT-2を使えば、ロボットは人間と同じようにさらに学習することができ、学習した概念を新しい状況で使うことができる」とヴァンホーク氏は語った。

関連記事

Google、マルチモーダルVML「PaLM-E」搭載ロボットのデモを公開

Google、マルチモーダルVML「PaLM-E」搭載ロボットのデモを公開

Googleとベルリン工科大学の研究者がロボット制御用VLM「PaLM-E」の論文を発表した。PaLM-E搭載のロボットは人間の音声による命令をPaLM-Eとカメラに映る映像から解釈し、自律的にタスクを実行する。 Google、「モラベックのパラドックス」打破目指すロボットプロジェクト

Google、「モラベックのパラドックス」打破目指すロボットプロジェクト

Alphabet傘下のGoogleとEveryday Robotsは、ヘルパーロボットに(ロボットにとって)難しい命令を実行させるための共同研究「PaLM-CanSay」を発表した。「飲み物をこぼした。助けてくれる?」と言うとスポンジを持ってくるなど、高い確率で適切な対応ができるとしている。 タチコマのように並列化し進化する、 Google親会社の日常家事ロボット

タチコマのように並列化し進化する、 Google親会社の日常家事ロボット

多くの企業が「メタバース」を喧伝する中、Googleの親会社はロボット事業をXから独立させました。AIを駆使し、タチコマのように並列化することで、汎用ロボット開発の可能性が開けたそうです。 Google、ネット上の公開情報をAIのトレーニングに利用しているとプライバシーポリシーに明記

Google、ネット上の公開情報をAIのトレーニングに利用しているとプライバシーポリシーに明記

Googleは7月1日付でプライバシーポリシーを更新し、BardなどのAIのトレーニングにネットで一般公開されている情報を使っていると明記した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR