Google、生成AI「Gemini」を広告の安全性でも活用 金融詐欺広告などを迅速に検出

米Googleは3月27日(現地時間)、2023年の広告安全性レポート(リンク先はPDF)を発表した。

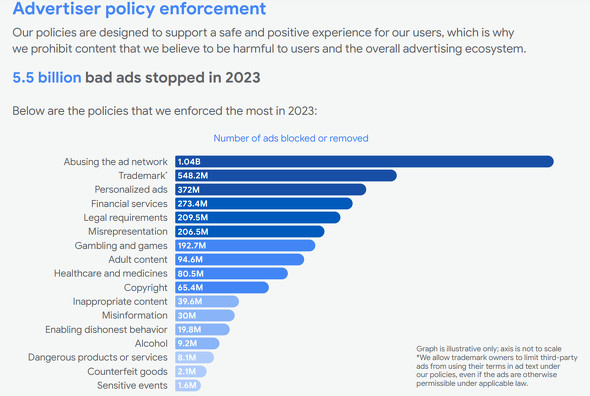

2023年1年間で、ポリシーに違反した55億件以上の広告と、1270万以上の広告アカウントをブロックまたは削除した。対処した広告数もアカウント数も昨年より増加している。アカウントはほぼ倍増だ。

2023年から2024年にかけて、著名人の画像を悪用したディープフェイク広告が検出されるようになったため、こうした広告を検出するための自動適用モデルをトレーニングして大規模な広告削除を開始した。また、こうしたディープフェイク広告を含むMisrepresentation(日本では「不実表示」)に関するポリシーを追加した。

Googleは広告ポリシーを施行するために長年にわたってML(機械学習)システムを使ってきたが、MLに比べてLLM(大規模言語モデル)は「大量のコンテンツを迅速にレビューして解釈でき、コンテンツ内の重要なニュアンスも捉えることができる」ため、新たな不正の傾向が発生するとすぐに認識できるという。

例えば、信頼性の低い金融広告は年々巧妙になってきており、投資アドバイスやデジタル通貨などの新しい金融サービスに合わせて広告を調整し、ユーザーをだまそうとするが、LLMはこうした傾向をすぐに認識し、合法的なビジネスと詐欺を区別できるとしている。

Googleは「広告の安全性のためにLLMの力を活用し始めたばかりだ。昨年一般公開されたGeminiは、Googleの最も有能なAIモードだ。われわれは、その高度な推論機能を広告の安全性と法執行の取り組みに導入し始めたことに興奮している」としている。

関連記事

Google、AI採用のサイバー防御イニシアチブ発表 「Magika」オープンソース化も

Google、AI採用のサイバー防御イニシアチブ発表 「Magika」オープンソース化も

Googleは、「防衛者のジレンマ」に対処するための新イニシアチブ「AI Cyber Defense Initiative」の立ち上げを発表した。また、Gmailなどで活用しているAI採用マルウェア検出ツール「Magika」をオープンソース化した。 Google、広告サービス「P-MAX」に生成AI採用の新機能 テキストと画像の生成・カスタマイズなどが可能に

Google、広告サービス「P-MAX」に生成AI採用の新機能 テキストと画像の生成・カスタマイズなどが可能に

Googleの広告部門は、生成AI採用の広告サービス「P-MAX」に数クリックで最適化されたアセットを生成する機能と、プロンプトで画像の背景を変えられる機能を発表した。まずは米国で提供開始する。 Google、AIで生成した政治広告に明確な開示を義務付け 11月にポリシー更新

Google、AIで生成した政治広告に明確な開示を義務付け 11月にポリシー更新

Googleは11月中旬に政治に関するコンテンツポリシーを更新し、選挙広告に合成コンテンツを含む場合、明確に開示する義務を追加する。 Google、生成AI採用の広告クリエイティブツール「Product Studio」

Google、生成AI採用の広告クリエイティブツール「Product Studio」

Googleは、マーケティング関連イベントで生成AI関連の新サービスを多数発表した。オンラインショップや広告向けの素材をAIで生成する「Product Studio」もその1つ。商品画像の背景をAIで生成したり解像度を上げたりできる。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR