OpenAI、個人情報保護モデル「Privacy Filter」を公開 商用利用可能な軽量設計

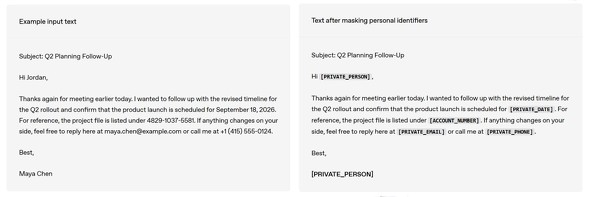

米OpenAIは4月22日(現地時間)、テキスト内の個人識別情報を自動検知し、マスキングするオープンウエイトモデル「Privacy Filter」をリリースしたと発表した。データをAIチャットボットなどに読み込ませる前に、個人情報を削除するツールだ。Hugging FaceとGitHubで、商用利用やカスタマイズが可能なApache 2.0ライセンスで開発者向けに公開した。

15億パラメータという小規模なモデルなのでローカル環境のWebブラウザやノートPC上でも直接動作し、マスキング処理のためにデータがデバイスの外部へ送信されるリスクを減らせるとしている。

開発者がAIをより安全に構築するための実用的なインフラを提供し、ソフトウェアエコシステム全体を支援することを目的として公開したという。OpenAIは、プライバシー保護インフラは誰もが簡単に検査、実行、適応、改善できるべきであるという考えの下、AIが個人ではなく世界を学習できる環境を整えるためにリリースしたと説明している。従来のルールベースの検知ツールが文脈の理解に苦労していたのに対し、Privacy Filterは前後の文脈を考慮した個人情報の検出を高いスループットで行えるとしている。

このフィルタが検知するのは以下の8つの情報カテゴリだ。

- private_person:特定の個人を識別する名前、ユーザー名、ハンドルネームなど

- account_number:クレジットカード番号、銀行口座番号、その他のアカウント識別子

- private_url:プライベートな共有を意図したWeb URLやIPアドレス、特定の個人を識別するもの

- private_email:個人的なやり取りに使用される、または特定の個人を識別するメールアドレス

- private_phone:特定の個人に関連付けられた電話番号

- private_address:特定の個人に関連付けられた特定の場所や住所

- secret:APIキー、パスワード、その他の認証情報

- private_date:生年月日や誕生年など、特定の個人を識別する日時

公開されたモデルカード(システムカード)では、幾つかの問題点や限界も指摘されている。Privacy Filterは完全な匿名化や安全性を保証するものではなく、過信することはプライバシー保護の目的を損なう恐れがある。また、あらかじめ学習されたラベル分類に依存しているため、組織独自のポリシーに合わせるにはモデルのファインチューニングが必要になる場合がある。

さらに、英語以外の言語や非ラテン文字、学習データ内で過小評価されている地域の命名規則に対しては、パフォーマンスが低下する可能性も明記されている。珍しい名前の検出漏れや、逆に公開情報などを過剰にマスキングしてしまうエラーも発生し得るため、医療や法務、金融などの機密性の高い分野では、引き続き人間の目によるレビュープロセスを維持することが推奨されている。

関連記事

Google検索「AIモード」に個人情報を入力しないで――立教大など、学内に注意喚起

Google検索「AIモード」に個人情報を入力しないで――立教大など、学内に注意喚起

AIモードに入力した情報はGoogleのデータベースに蓄積され、AI学習に利用されるため、入力自体が情報漏えいになるとし、注意を呼び掛けている。 Anthropic、本人確認機能を導入 悪用防止とコンプライアンス強化で

Anthropic、本人確認機能を導入 悪用防止とコンプライアンス強化で

Anthropicは、悪用防止や法的義務の順守を目的に、一部のユースケースで本人確認機能を導入した。外部パートナーのPersona Identitiesを通じて政府発行の身分証と自撮り写真による照合を行う。収集データは本人確認のみに使用され、AIモデルの学習には利用されないとしている。 生成AI利用者、過半数が利用規約を確認せず リスク意識は高いが「認識と行動にギャップ」 LINEヤフー調査

生成AI利用者、過半数が利用規約を確認せず リスク意識は高いが「認識と行動にギャップ」 LINEヤフー調査

生成AI利用者の過半数が利用規約を確認していない──LINEヤフーは、生成AIサービスの利用者に対する意識調査の結果を公開した。 Apple、プライバシーを保護しつつAI開発にユーザーデータを利用する方法を発表

Apple、プライバシーを保護しつつAI開発にユーザーデータを利用する方法を発表

Appleは、ユーザーのプライバシーを保護しながら「Apple Intelligence」の機能を向上させるための自社技術を紹介した。「合成データ生成」は、トレンドを理解するための新手法だ。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR