AIは人の怒りを鎮めることができるか――信頼できる「対話エージェント」の作り方:サイバーエージェント「AI Lab」に聞く(後編)(1/3 ページ)

「人が信頼したくなる、思わず信頼してしまう対話エージェント」を生み出したい……そんなビジョンを掲げ、AIの研究を進める「AI Lab」。企業とさまざまな実証実験を進めているが、その実現にはいろいろな課題もあるという。

「人が信頼したくなる、思わず信頼してしまう対話エージェント」を生み出したい――。そんなビジョンを持ち、サイバーエージェント「AI Lab」と大阪大学の石黒研究室がタッグを組んで生まれた共同研究講座。企業との実験を通じ、エージェントやロボットとの対話が生み出す可能性を追究している。

AI Labで、対話エージェントを研究している馬場惇さんによれば、最近では、人間の感情にアプローチする研究として、カスタマーサポートにおけるクレーム対応にエージェント(対話AI)を使う実験を行ったという。

- インタビュー前編はこちら→人が“生命”を感じ、信頼できる対話AI 実現のヒントは掃除ロボット「ルンバ」にある

AIは人の怒りを鎮めることができるのか?

当時、AI Messengerというチャットbotサービスを開発していた彼らは、「チャットbotという対話エージェントならではの接客はないか」と議論する中で、クレーム対応における感情制御の研究を始めた。何か一つ工夫を入れるだけでも、うまくクレームを処理できるのではないかと考えたという。

「クレームを制御するという方針の下、吉川雄一郎先生がやっていた『複数人対話』を使い、心理的に均衡な状態を作ったり、バラしたりして、相手の心理をコントロールできないかと考えました」(馬場さん)

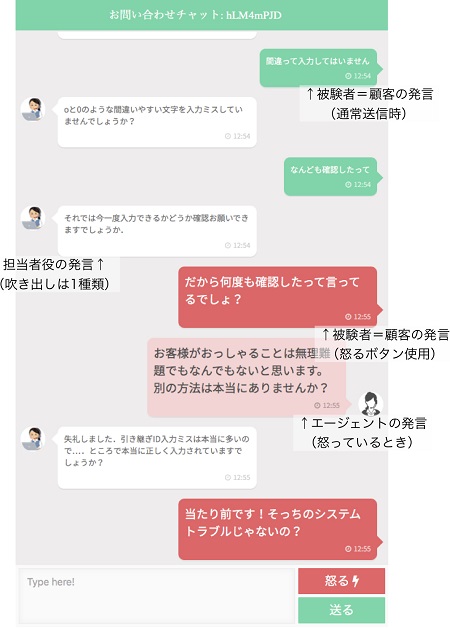

この仕掛けで使われるのが「バランス理論」だ。対人関係における心理状態を説明する理論で、三者以上の存在があるときに、彼らの間でバランスを保とうとする人間の心理状態を表す。そのために、ユーザーとオペレーターの会話に、エージェントという第三者を放り込むのだ。

一般的に、クレームが起きているときは、ユーザーは「〇〇してください」、オペレーターは「できません」というように会話は平行線をたどる。なかなか互いが歩み寄れないため、ユーザーが持つマイナスの感情は変化しない。

しかし、そこにエージェントを登場させ、ユーザーと共にオペレーターに詰め寄ると2対1の構図になる(バランス理論においては、この状態は均衡と定義される)。そこからエージェントが徐々に態度を軟化させていくと、三者の関係は崩れる。その崩れた関係を修復するかのように、ユーザーも態度を軟化させざるを得なくなる仕組みだ。ただ、怒りの制御方法においては諸説あり、AI Labの中でも議論が分かれているという。

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- 初期侵入口は“またVPN” 日本医大武蔵小杉病院にランサムウェア攻撃

- 「2027年1月12日」は運命の日? サポート切れOSを使い続ける会社の末路

- 富士通、ソブリンAIサーバを国内製造開始 自社開発プロセッサー搭載版も

- Googleが「AI Threat Tracker」レポートを公開 Geminiを標的にした攻撃を確認

- ホワイトハッカーが明かす「ランサムウェア対策が破られる理由」と本当に効く防御

- シャドーAIエージェントを検出 Oktaが新機能「Agent Discovery」を発表

- SOMPOグループCEOをAIで再現 本人とのガチンコ対談で見えた「人間の役割」

- AIエージェント普及はリスクの転換点 OpenClawを例に防御ポイントを解説

- 「AI前提」の国家戦略と「思考停止」の現場 大半の企業で“何も起きない”未来を予見

- NTTデータ、仮想化基盤「Prossione Virtualization 2.0」発表 日立との協業の狙いは