米Google、オープンな視覚言語モデル「PaliGemma」公開 「Gemma 2」の登場も予告:Google I/O 2024

» 2024年05月15日 05時08分 公開

[松浦立樹,ITmedia]

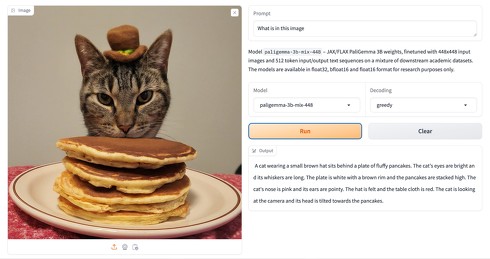

米Googleは5月14日、視覚言語モデル(VLM)「PaliGemma」を公開した。VLMとは視覚的な入力に言語を対応させる言語モデルのことで、画像や動画を入力すると自然言語を出力できる。同社はこれを「オープンなVLM」と位置付けており、Hugging FaceやGitHubなど複数のプラットフォームで公開している。

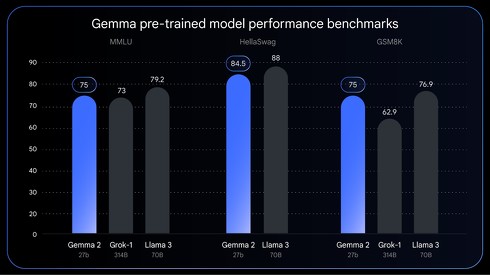

また、同社が現在公開している大規模言語モデル(LLM)「Gemma」の次世代モデルに当たる「Gemma 2」も近々公開する予定であると発表。現在事前学習を進めている段階だが「Gemma 2の270億パラメータの性能は、米MetaのLLM『Llama 3』の700億パラメータに匹敵する」としている。

Gemma 2の公開時期については「今後数週間以内」と説明している。

関連記事

AIチャット「Gemini Advanced」に「Gemini 1.5 Pro」実装 日本語にも対応開始&スプレッドシードの分析なども可能に

AIチャット「Gemini Advanced」に「Gemini 1.5 Pro」実装 日本語にも対応開始&スプレッドシードの分析なども可能に

米Googleは、大規模言語モデル「Gemini 1.5 Pro」をAIチャット「Gemini Advanced」に導入すると発表した。 米Google、大規模言語モデル「Gemini 1.5 Flash」発表 1.5 Proの軽量版 きょうから利用可能

米Google、大規模言語モデル「Gemini 1.5 Flash」発表 1.5 Proの軽量版 きょうから利用可能

米Googleは、大規模言語モデル(LLM)「Gemini 1.5 Flash」を発表した。 米Google、動画生成AI「Veo」発表 テキストから60秒超え動画を作成 サンプルも多数公開

米Google、動画生成AI「Veo」発表 テキストから60秒超え動画を作成 サンプルも多数公開

米Googleは、動画生成AI「Veo」を発表した。 Google、オープンな生成AIモデル「Gemma」公開 商用利用OK、Geminiと同じ技術の軽量LLM

Google、オープンな生成AIモデル「Gemma」公開 商用利用OK、Geminiと同じ技術の軽量LLM

米Googleは、大規模言語モデル(LLM)「Gemma」を公開した。同社が開発するLLM「Gemini」に使ったのと同じ技術を活用して開発した軽量版LLMで、同社は「オープンなAIモデル」として位置付けている。商用利用も可能としている。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

SpecialPR

SpecialPR

アイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR