LLMが別のLLMを何度も改善 より良い回答を出す最適化手法をAIが発見する技術 Sakana AIなどが開発:Innovative Tech(AI+)

Innovative Tech(AI+):

このコーナーでは、2014年から先端テクノロジーの研究を論文単位で記事にしているWebメディア「Seamless」(シームレス)を主宰する山下裕毅氏が執筆。新規性の高いAI分野の科学論文を山下氏がピックアップし、解説する。

X: @shiropen2

AIベンチャーのSakana AI(東京都港区)やFLAIR、英ケンブリッジ大学、オックスフォード大学に所属する研究者らが発表した論文「Discovering Preference Optimization Algorithms with and for Large Language Models」は、人間の介入を最小限に抑えて新しい最適化アルゴリズムをAIによって発見する手法を提案した研究報告である。

この手法では大規模言語モデル(LLM)がLLMを利用して自己改善し進化していくことを提案しており、研究者らは「LLM^2」(「LLMの2乗」)と表現している。

LLMには、生成するテキストに偏見や差別的表現、有害な内容が含まれることがあり、出力の品質や安全性の面で課題がある。これを解決するために、人間の選好に基づいてLLMの出力を最適化する「選好最適化」(Preference optimization)という手法が注目されている。

選好最適化の一般的なアプローチは、人間が手動で設計した損失関数を用いて、LLMをファインチューニングすることである。損失関数は、モデルの出力と理想的な出力との乖離(かいり)を数値化したもので、これを最小化するようにモデルのパラメータを更新する。しかし、最適な損失関数の設計は容易ではない。なぜなら、考えられる損失関数の組み合わせは膨大で、人間の創造性では限界があるからである。

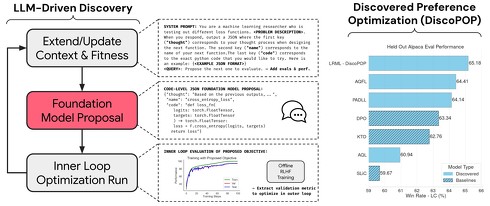

この研究では、この問題に対処するために、LLMを活用して自動的に高性能な損失関数を発見する方法を提案した。提案手法では、LLM(ここではGPT-4を使用)に対して反復的にプロンプトを与え、新しい損失関数を生成させる。

プロンプトには、これまでに評価された損失関数の情報やその性能指標が含まれる。生成した損失関数は、実際にLLMの学習に適用され、その性能を評価。この評価結果がフィードバックとしてLLMに与えられ、LLMは徐々により良い損失関数を生成するようになる。このプロセスにより、これまで未知であったが高性能な選好最適化アルゴリズムを発見できる。

この自動発見プロセスを約100回試したところ、研究では「DiscoPOP」と名付けられた新しい選好最適化アルゴリズムを発見した。DiscoPOPの特徴は、ロジスティック損失と指数損失という2つの損失関数を適応的に組み合わせているところだ。

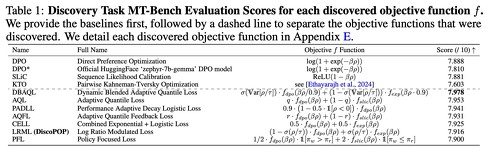

DiscoPOPは、MT-Benchと呼ばれる多様な対話タスクからなるベンチマークにおいて、既存の手法を上回る性能を示した。さらに、要約や感情制御など、未知のタスクに対しても優れた性能を発揮した。

研究チームは、DiscoPOPなどをオープンソース化(GitHubリポジトリ)している。

Source and Image Credits: Chris Lu, Samuel Holt, Claudio Fanconi, Alex J. Chan, Jakob Foerster, Mihaela van der Schaar, Robert Tjarko Lange. Discovering Preference Optimization Algorithms with and for Large Language Models

関連記事

話題のAIベンチャー「Sakana AI」が画像生成AIを公開 “自律進化”技術で、推論速度が約10倍高速に

話題のAIベンチャー「Sakana AI」が画像生成AIを公開 “自律進化”技術で、推論速度が約10倍高速に

AIベンチャーのSakana AIは、画像生成AI「EvoSDXL-JP」を公開した。同社が提案する生成AIの開発手法「進化的モデルマージ」によって構築したAIモデルで、従来の日本語AIモデルと比べて10倍速く画像を生成できるという。 生成AI開発に革新か “自律進化”で目的のAIを自動生成 超低コスト&短期間で高性能モデルも開発済 トップ研究者集団「Sakana AI」

生成AI開発に革新か “自律進化”で目的のAIを自動生成 超低コスト&短期間で高性能モデルも開発済 トップ研究者集団「Sakana AI」

生成AIのトップ研究者らが東京で創業したAIベンチャーが、生成AI開発の新たな手法を開発した。同社の手法では設計を機械が自動で行い、“ほぼ無視できるレベル”の計算資源で開発が可能になるという。 生成AIでGPUがいらなくなる? 業界を揺るがす「1ビットLLM」とは何か、識者に聞いた

生成AIでGPUがいらなくなる? 業界を揺るがす「1ビットLLM」とは何か、識者に聞いた

米Microsoftの研究チームが発表した「BitNet」、通称「1bit LLM」と呼ばれる論文が波紋を呼んでいる。これまで必須だと思われていたGPUが不要で、CPUでもLLMが動作することを示唆している。そもそも“1bit”とは何が1bitなのか、どうして1bitになるとGPUが不要になるのか、AIソリューションの開発・提供を行うLaboro.AIの椎橋徹夫CEOに聞いた。 PKSHA製基盤モデルの特徴とは? 「Transformer」ではなく「RetNet」だから実現できた“3つの強み”

PKSHA製基盤モデルの特徴とは? 「Transformer」ではなく「RetNet」だから実現できた“3つの強み”

生成AIブームの今、注目のキーワードが「基盤モデル」だ。各AIベンダーたちの間で基盤モデルの開発競争が激化する中、それぞれの開発状況や強みを探っていく。今回は、AIベンチャー・PKSHA Technology(東京都文京区)に話を聞いた。 “大は小を兼ねない”生成AI 注目集める「小規模言語モデル」(SLM) そのメリットとは?

“大は小を兼ねない”生成AI 注目集める「小規模言語モデル」(SLM) そのメリットとは?

先日行われた、米Microsoftの開発者向けイベント「Microsoft Build 2024」の目玉の一つだった「SLM」(Small Language Model)。そもそもSLMとは何か? 何が期待されているのか? SLMの基本を整理する。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.