写真1枚で専門家レベルの分析 土砂災害の原因やリスク判別するマルチモーダルAIシステム、理研など開発

防災コンサルティング事業などを手掛ける国際航業と理化学研究所、東京大学、筑波大学らの共同研究グループは6月17日、ドローンなどで撮影した土砂災害の画像1枚から、専門家レベルの分析を行えるというマルチモーダルAIシステムを開発したと発表した。

大規模言語モデル(LLM)を活用し、災害の種類、原因、将来リスクを解析するモデル。衛星から収集した大量の画像を自動処理して高リスクの地すべりを特定したり、消防士や警察などに分析を提供する、といった使い方を想定する。

「土砂災害の種類、原因、観察事項、将来リスクを説明してください」という固定の指示プロンプトと災害画像を与えると、土砂災害現場の分析結果を生成するAI。

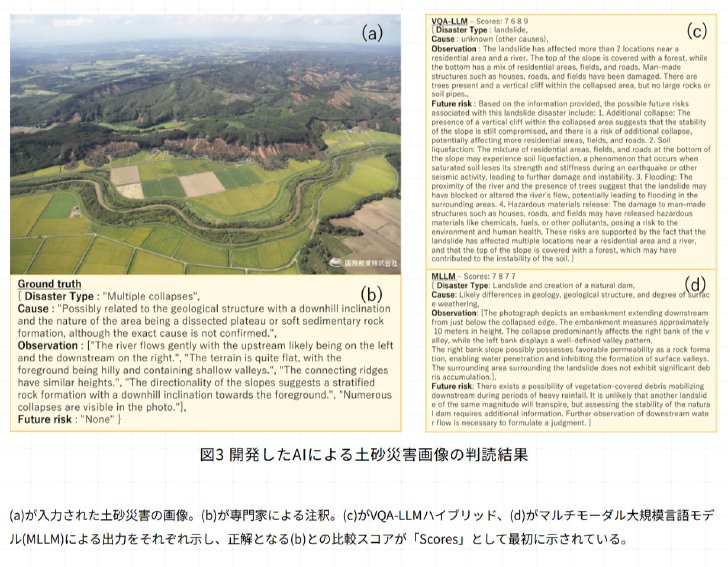

地滑りの画像を与えて検証したケースでは、災害タイプを正しく「Landslide」(地滑り)と識別し、原因を「人為的活動と自然侵食」と推測。さらに、「細長い山岳地域内の急斜面」「露出した岩石」などの特徴を正確にとらえ、「さらなる斜面崩壊と侵食の可能性」がある、と妥当な予測が行えたという。

システムの開発にあたり研究チームは、過去の土砂災害現場の画像見た専門家の観察や分析音声をテキストに変換し、「災害タイプ」「原因」「観察事項」「将来リスク」という構造化データとして整理した。

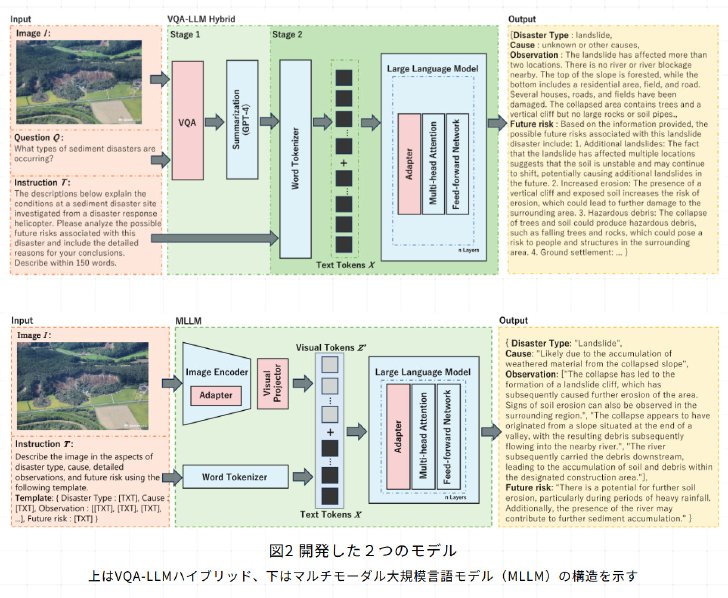

さらに、2つの異なるアプローチを行った。一つめは、画像から情報を抽出する視覚的質問応答(VQA)モデルと、その結果をもとに分析を行う大規模言語モデル(LLM)を組み合わせたもの。2つめは、画像と指示テキストを同時に処理するエンドツーエンドのアプローチだ。

これらのモデルを、日本各地の土砂災害現場の画像68枚(データ拡張により136サンプル)を用いて訓練したという。

評価では、従来のテキスト類似性指標に加え、LLMを用いた意味的評価と、専門家による評価も実施した。

このAIにより、航空写真や衛星から収集した大量の画像を自動処理して高リスクの地すべりを特定したり、消防士、警察、自治体職員など、地すべりの専門知識を持たない初動対応者に専門家レベルの分析を提供したり、専門家が多数の現場を評価する際の補助ツールとして活用する――といったことが可能になるとみている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

こんなメディアも見られています

ITmedia AI+に関連する情報をお探しであれば、こちらのメディアもお役に立てるかもしれません。

SpecialPR

よく見られているカテゴリー

アクセスランキング

-

1

東大松尾研が「LLM講座 基礎編」の講義資料を無料公開 期間限定で

-

2

AIコスト高騰で中国DeepSeekへの“乗り換え”続出か 米国決済サービスの支出調査で明らかに

-

3

2年間で「1万時間」削減 「1円の誤りも許されない」ソニー経理が“まず試してみる”DX集団に化けたワケ

-

4

Google Chromeの新機能「Skills」 AIプロンプトの“毎回手打ち”を不要に

-

5

人型ロボブームを“先駆者ホンダ”はどう見る? 「悔しさもあるが……」 次の一手を聞いた

-

6

「自作のAI学習・改変を防ぐための契約は?」 日本漫画家協会が回答

-

7

「家庭教師のトライ」が学力診断にAI活用 20問解くだけで弱点を推定 生徒と講師の負担減らす

-

8

英ケンブリッジ大学、AIが設計したワクチンの臨床試験に成功 未知の変異株にも備える“万能型”

-

9

検図から積算まで支援する図面解析AI、工数を最大60%削減

-

10

Claude Opus 4.8は忖度(そんたく)しません “正直すぎる”のも善しあし?

SpecialPR

ITmedia AI+ SNS

インフォメーション

注目情報をチェック

ITmedia AI+をフォロー

あなたにおすすめの記事PR

@itm_aiplusをフォロー

@itm_aiplusをフォロー