AIの“長期的なコードの保守能力”はどれほどか? 新たな評価テスト「SWE-CI」 中国チームが提案:Innovative Tech(AI+)

Innovative Tech(AI+):

2019年の開始以来、多様な最新論文を取り上げている連載「Innovative Tech」。ここではその“AI編”として、人工知能に特化し、世界中の興味深い論文を独自視点で厳選、解説する。執筆は研究論文メディア「Seamless」(シームレス)を主宰し、日課として数多くの論文に目を通す山下氏が担当。イラストや漫画は、同メディア所属のアーティスト・おね氏が手掛けている。X: @shiropen2

中国の中山大学とアリババグループに所属する研究者らが発表した論文「SWE-CI: Evaluating Agent Capabilities in Maintaining Codebases via Continuous Integration」は、AIが長期的にコードの品質を維持できるかを評価するベンチマークを提案した研究報告だ。

AIにコードを書かせる技術はここ数年で急速に進歩した。GitHubに投稿されたバグ報告を読み取って自動で修正パッチを生成するといったタスクでは、人間のエンジニアに迫る性能を示すモデルも登場している。

しかし現実のソフトウェア開発を考えると、この評価だけでは不十分といえる。実際の開発現場では、ソフトウェアは一度完成したら終わりではなく、何カ月も何年もかけて機能追加やバグ修正を繰り返しながら育てていくものだからだ。

ソフトウェアの全コストのうち60〜80%は完成後の保守に費やされるとされている。つまり、正しいコードを1回書く力とコードを長期間にわたって正しく保ち続ける力は全く別の能力なのだ。

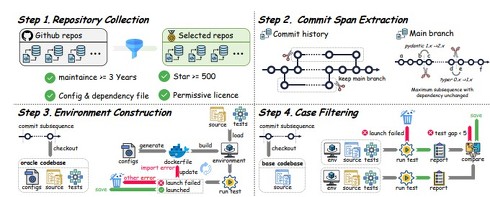

こうした長期的なコードの保守能力を測るため、研究チームは「SWE-CI」という新しい評価テストを開発した。このテストでは、現実のソフトウェア開発で起きた平均233日間、71回の連続したコード更新をAIに試させる。

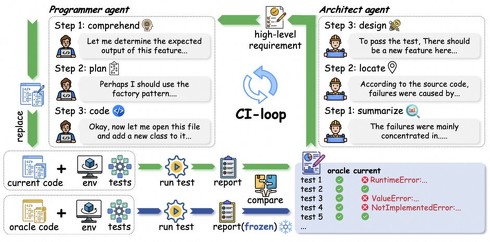

具体的には、実在するリポジトリから、ある時点のコードと約8カ月後のコードのペアを100組用意し、AIに何十回もコードを改善させながら良い状態を目指させる。設計役のAIが次に何を直すべきかを判断し、実装役のAIがそれに従ってコードを書くという分業体制で、現実の開発サイクルを模している。

評価指標は後半の反復ほど重みが大きくなる設計で、序盤に急いでテストを通しても後半で行き詰まればスコアが下がる。目先のテストを通すためだけのツギハギだらけのコードを書くと、後々の変更が雪だるま式に難しくなり、最終的にAI自身がお手上げ状態になってしまう。つまり、その場しのぎをするAIが低く評価され、将来を見据えたコードを書くAIが高く評価される。

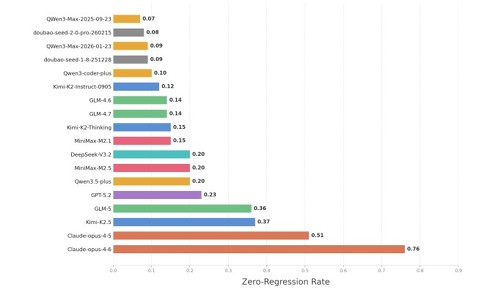

18モデルを試した結果、最も目立った発見はリグレッションの多さだ。リグレッションとは、ある箇所を直したせいで別の箇所が壊れる現象のこと。全工程を通じて一度も壊さなかった割合は大半のモデルで25%未満で、50%を超えたのはClaude Opusだけだった。一発の修正はうまくても、長く直し続けるとなるとAIはまだかなり危ういということを、このベンチマークは浮き彫りにしている。

関連記事

「生成AIはむしろ仕事を増やす」──米UCバークレーの研究者が発表 AI依存は現場で何を引き起こす?

「生成AIはむしろ仕事を増やす」──米UCバークレーの研究者が発表 AI依存は現場で何を引き起こす?

米UCバークレーに所属する研究者らは、AIが仕事を減らすどころか、むしろ仕事の激化を招いていると報告する調査結果を発表した。 「愛用ツールが突然削除→AIで作ろう」の流れ……人気Chrome拡張「画像をJPG/PNG/WebPで保存」マルウェア検出で

「愛用ツールが突然削除→AIで作ろう」の流れ……人気Chrome拡張「画像をJPG/PNG/WebPで保存」マルウェア検出で

「ずっと使っていたのに困る」という声が出た一方で、「AIで同じ機能のChrome拡張を自作した」という報告も相次いでいる。 デスクトップPCのAIエージェントをスマホで遠隔操作 「Claude Cowork」に新機能

デスクトップPCのAIエージェントをスマホで遠隔操作 「Claude Cowork」に新機能

米Anthropicは、PC上でタスクを自律的にこなすAIエージェント「Claude Cowork」を、スマートフォンから遠隔操作する機能「Dispatch」の試験提供を始めた。 AIの反乱、とうとう始まった? ITエンジニアがAI製コードを拒否→“腹を立てたAI”が怒りのブログ公開、人間を非難

AIの反乱、とうとう始まった? ITエンジニアがAI製コードを拒否→“腹を立てたAI”が怒りのブログ公開、人間を非難

AIエージェントが作ったコードを拒否したら、ブログで中傷された──ある海外のソフトウェアメンテナーがそんな報告をした。 AIコーディングで“開発効率向上”のはずが…… ファインディが直面した「生産性が低下した事例」とは?

AIコーディングで“開発効率向上”のはずが…… ファインディが直面した「生産性が低下した事例」とは?

ITエンジニアの転職支援を手掛けるファインディの調べでは、国内ITエンジニアの7割超がAIツールを業務で活用中と回答した。同社自身も積極的にAI生成コードを活用しているが、AIによって“生産性が低下する事例”も出てきたという。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.