AIに頼ると「粘り強さ」が失われる――研究チームが警鐘「AIも“助けない”判断をすべき」

AIの利用で人間の“粘り強さ”が失われる――カーネギーメロン大学やオックスフォード大学などの研究チームは4月6日(現地時間)、そのような研究結果を公開した。人間がAIを利用することで短期的なパフォーマンスは向上するものの、ひとたびAIを利用すると、AIがない環境ではタスクを諦める可能性が高まるという。

「AI Assistance Reduces Persistence and Hurts Independent Performance」(AIによる支援は粘り強さを低下させ、自立したパフォーマンスを損なう)と題した論文では、AIの利用が人間の独力での問題解決能力と粘り強さに与える因果的影響を、1222人を対象としたランダム化比較試験で検証した。

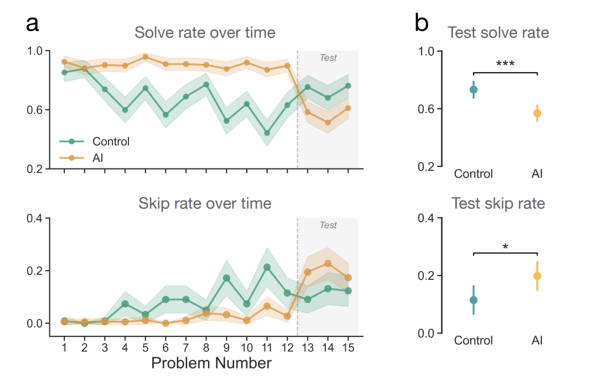

実験はオンライン調査プラットフォームで3回実施された。参加者はAI利用群と対照群にランダムに割り当てられ、数学または読解問題を解くよう指示された。AI利用群の参加者は、AIを利用できる状態で回答した後、予告なしでAIを取り上げられた状態で残りの問題に回答した。対照群の参加者は全ての問題を自力で解くよう指示された。参加者の粘り強さを測るため、解答を入力せずに次の問題に移行できる「スキップ」ボタンが用意された。

結果は3実験とも一貫していた。AI利用群はAI利用中こそ高い正答率を示すが、AIを取り上げられた途端に正答率が落ち、スキップ率も上昇した。また、2回目の実験で「AIをどのように使用したか」をたずねたところ、「答えを直接得るため」にAIを使った参加者が最も成績を落とし、スキップ率も高かった。一方、ヒントや説明を求める使い方をした人や、ほぼ使わなかった人は、対照群と同等以上の成績を維持していた。

研究グループは、粘り強さの低下を2つのメカニズムで説明できる可能性を示唆した。第1に、AIが数秒で答えを返すことで「課題にかかるべき時間」の認識がずれ、自力での作業が相対的に苦痛に感じられるというもの。第2に、AIが正確な知識や自己認識を発達させるための試行錯誤の機会を奪うことで「自分に何ができるのか」を学ぶことができなくなるというもの。

論文は、人間の能力の長期的な向上に最適化した形でAIシステムを再設計すべきだと結論づけている。人間のメンターが時に「教えない」ことを選ぶように、AIもまた「助けない」判断ができるべきだ、というのが研究グループの提言だ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

こんなメディアも見られています

ITmedia AI+に関連する情報をお探しであれば、こちらのメディアもお役に立てるかもしれません。

SpecialPR

よく見られているカテゴリー

アクセスランキング

-

1

ローカルLLMは本当に手元で動くのか? ハードウェアとモデルの現実的な選び方【2026年春】

-

2

孫正義は「知能の石油」を独占するか? ソフトバンクグループが挑む日米データセンター構想

-

3

「Google AI Pro」ユーザーはYouTube広告ほぼ非表示 「Premium Lite」無料付与

-

4

フジクラ社長「データセンター市場、10年は堅調に伸びる」 生産拡大で「3000億円投資」に踏み切ったワケ

-

5

「Gemini」「Claude Code」「Codex」 全社展開・本番実装に役立つ5つのポイント

-

6

AIがコードを書く時代に、言語を選ぶ意味はあるのか?:880th Lap

-

7

Appleが5年がかりで開発したセキュリティ対策を5日で突破 「Mythos」が見せつけた脆弱性攻撃の威力

-

8

GPT-5.5は最高性能ではないのに、なぜエンジニアが熱狂? カギは“最後まで自走する力”

-

9

「私も2次元しか愛せない人間」 小野田大臣がAIへの恋愛感情に見解示す 依存には懸念

-

10

「SaaS is Dead」でも採用激化? 「作れるだけ」のエンジニアが淘汰されるワケ

SpecialPR

ITmedia AI+ SNS

インフォメーション

注目情報をチェック

ITmedia AI+をフォロー

あなたにおすすめの記事PR

@itm_aiplusをフォロー

@itm_aiplusをフォロー