なぜ、人間と人工知能の対話は“破綻”してしまうのか:【総力特集】人とAIの共存で進化する「おもてなし」(1/3 ページ)

雑談対話に特化したシステムやアルゴリズム、超指向性マイクなど、最先端の技術を使っても、人間と人工知能が雑談を続けるというのは難しい。インタビューの最終回では、なぜ対話が破綻するのか、そして、それを解決するための研究の最先端に迫る。

ドラえもんや鉄腕アトムのような、人間と自然に会話ができる人工知能は本当に生まれるのか――。NTTで人工知能による雑談対話を研究している東中竜一郎さんに聞く本インタビュー。本記事(後編)では、対話研究の最先端、そして対話システムや人工知能のこれからについてお話を伺っていく。

- 前編はこちら→人工知能と人が、本当の意味で“話せる”ようになる日

- 中編はこちら→なぜ“マツコロイド”と“マツコ”の雑談は失敗したのか?

人間と人工知能の対話が“破綻”する4つのパターン

雑談対話に特化したシステムやアルゴリズム、超指向性マイクなど、最先端の技術を使っても、人間と人工知能が雑談を続けるのは難しい。

対話というのは繊細なもので、不自然な間が空いてしまったり、返答に脈絡がないと感じたりしてしまえば、人は会話を続けるモチベーションが削がれてしまう。対話が“破綻”してしまうのだ。NTTで人工知能による雑談対話を研究している東中竜一郎さんは現在、この対話破綻を少なくする方法について、研究を重ねているという。

「システム側が発した言葉の意味が分かりにくかったり、ユーザーの質問を無視したりすると、ユーザーは対話をする気がなくなってしまう。こういう状態を“対話破綻”と呼んでいて、それをなくすための努力をしています」(東中さん)

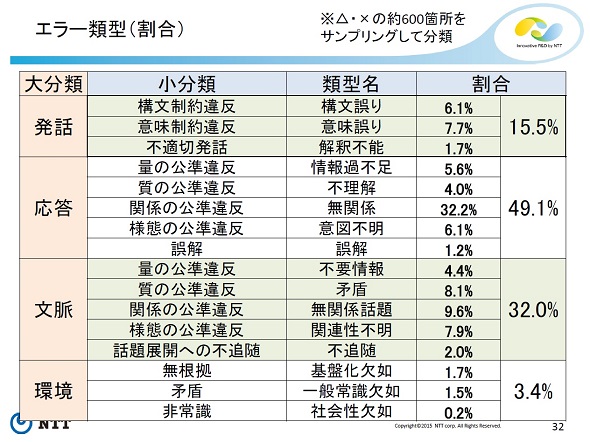

東中さんによると、人工知能との対話の破綻には大きく4つの種類があるという。まずは「発話」そのものが破綻しているパターン。構文などが崩れていて、そもそも日本語として成立していないケースを指す。

2つ目は日本語としては正しいが、相手の発言に対する「応答」が破綻しているパターンだ。例えば人間側が「それでは、趣味はなんですか?」と話しかけたときに「最後に旅行されたのはいつですか?」と返してしまうと、やりとりとして成立しなくなってしまう。

3つ目のパターンは、1回のやりとりとしては成立しているものの、既に話した内容とかみ合わない「文脈」の破綻だ。10秒前には「お菓子が好き」と言っていたのに、すぐに「お菓子が嫌い」と言ってしまうと、話者は混乱してしまう。

最後は「環境」の破綻で、社会的(常識的)におかしい発言をしてしまうことだ。米Microsoftが公開した人工知能botの「Tay」のように、急に人種差別的な発言をしてしまうようなケースがこれにあたる(関連記事)。

「それぞれの破綻がどれくらい起きているかを調べてみると、応答の破綻が約5割、文脈の破綻が約3割くらいでした。発言そのものが破綻しているパターンが1割強で、一般常識が欠如しているようなケースはあまりありませんでした。現状では、特に応答、文脈で破綻しないようにしないといけないと考えています」(東中さん)

この結果を基に、クラスタリングなどの細かい分析を行い、どのミスが特に破綻につながりやすいかを検討したところ、「人工知能が発した言葉そのものが解釈できない」「ユーザーの質問を無視して他の話をしてしまう」「人工知能の発した言葉の意図が分かりづらい」といったことが挙がったそうだ。

関連記事

- ITmedia 総力特集:人とAIの共存で進化する「おもてなし」

なぜ“マツコロイド”と“マツコ”の雑談は失敗したのか?

なぜ“マツコロイド”と“マツコ”の雑談は失敗したのか?

ドラえもんや鉄腕アトムのような、人間と自然に会話ができる人工知能は本当に生まれるのか――。人間らしい自然なコミュニケーションを実現するために必要な“要件”はいろいろとあるが、人工知能にそれを適用するには、さまざまな壁があるのだという。 人工知能と人が、本当の意味で“話せる”ようになる日

人工知能と人が、本当の意味で“話せる”ようになる日

昨今「Watson」や「りんな」など、人間と会話ができる人工知能が注目を集めている。しかし、これらは人間の心を理解してコミュニケーションを取っているかというと、そうではない。いつか本当に人工知能と人が心を通わせるような時代は来るのか。人間と雑談できる対話システムを開発し続ける第一人者に話を聞いた。 「自然言語処理」のプロに聞く:世界の言語をつなぎ、国を越えて仲良く話せる人を増やしたい――金山博さん

「自然言語処理」のプロに聞く:世界の言語をつなぎ、国を越えて仲良く話せる人を増やしたい――金山博さん

人間の話し言葉を分析する「自然言語処理」が注目を集めている。耳慣れない言葉かもしれないが、Siriやしゃべってコンシェルなど、私たちは知らず知らずのうちにその恩恵を受けているのだ。そこで「Watson」のシステムを支える研究員に、自然言語処理の面白さと未来について聞いてみた。 ロボット5台が大喜利に挑戦、人工知能の“ボケ”で笑いはとれるか?

ロボット5台が大喜利に挑戦、人工知能の“ボケ”で笑いはとれるか?

ニコニコ超会議のNTTブースで、コミュニケーションロボットの「Sota」が大喜利に挑戦するという展示がある。5台あるうちの1台はNTTドコモの人工知能が搭載されており、リアルタイムで“ボケ”を生成する。人工知能のボケで会場の笑いは取れるのだろうか。

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- 「AIを使えば全員同じになる」 羽生善治九段が語るAI時代の差別化と意思決定

- やはりClaude Codeの品質は下がっていた Anthropicが調査し特定した3つの要因

- 「日本のDXは期待外れ」が64% 世界平均を大きく上回るとGartnerが警告

- Anthropicの新指標 AIの影響を受けにくい「3割の人々」の共通点は?

- NECが人材育成サービスを刷新 「今後必要とされる人材像」を再定義した背景

- 「Windows+R」は絶対に押さないで! 新入社員に贈るセキュリティの新常識5選

- AI活用で足らないのは「ビジョン」や「熱量」じゃない 経営層と現場で拡大する“ズレの正体”

- Windowsのリモートデスクトップ接続が刷新 情報の自動共有は「原則禁止」に

- NTTデータが「商品企画AI」を発表 社内データを基に150秒でコンセプト生成

- メインフレーム「IBM Z」は51%増、全事業セグメントが増収 IBMが2026年Q1決算を発表

筆者も取材でロボットと雑談をした経験があるが、うまくいくときも会話が続かないときもあった(出典:ヴイストン)

筆者も取材でロボットと雑談をした経験があるが、うまくいくときも会話が続かないときもあった(出典:ヴイストン)