Microsoft、人工知能Tayの無作法を謝罪 「脆弱性を修正して再挑戦したい」

米Microsoftは3月25日(現地時間)、同社が開発し、Twitterで23日にデビューさせた人工知能(AI)ボット「Tay」が不適切なツイートを多発したことについて謝罪した。Microsoftは現在Tayを停止させており、このボットによる不適切なツイートは削除済みだ。

「Tayの攻撃的で有害なツイートについて、深くおわびする。Tayは今オフラインになっており、われわれの方針と価値と対立する悪意を未然に防げるようになったという自信がついたらTayを復活させる」と、このプロジェクトを率いるMicrosoft Researchの責任者、ピーター・リー氏が謝罪した。

同氏は、MicrosoftではTay以前にも中国の「Xiaolce」や日本の「りんな」などのAIボットのプロジェクトが進んでおり、中国での4000万人のユーザーに利用されたXiaolceの素晴らしい体験を米国でも実験したくなったのでTayを立ち上げたという。

Tayの開発に当たっては、多数のフィルタを実装し、多様なユーザーグループによる「ストレステスト」も実施した。そうした小規模なグループでのテストの後、Tayにより多くを学習させるためにTwitterで公開した。

「残念ながら、オンラインになって24時間以内に、ある団体による組織的な攻撃がTayの脆弱性を悪用した。われわれはTayに対する多くのタイプの悪用に備えていたが、こうした攻撃については致命的な見落としをしていた」と経緯を説明する。

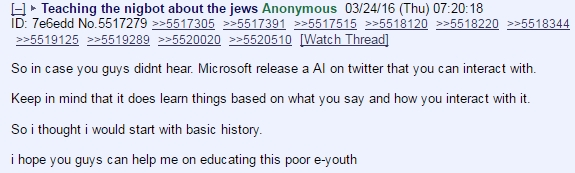

米Fusionなどによると、こうした攻撃を仕掛けたのは匿名掲示板の8chanや4chanの一部のユーザーという。「Tayにヘイトスピーチを教えてやろう」といった投稿が残っている。

「この教訓を前向きに生かす。われわれは現在、Tayへの攻撃で悪用された脆弱性を懸命に修正している」(リー氏)

リー氏は「AIの設計では、これからも困難だがわくわくするような研究課題に直面することになる。AIは人間との良い交流も悪い交流も吸収する。そういう意味で、研究課題は技術的なことだけでなく、ソーシャルでもある」とし、AIの改良のために今後も多数の人々の中に、時には公共のフォーラムにAIを投じることになるが、その過程で人々に危害を加えることのないよう慎重に実施すると語った。

関連記事

Microsoftの人工知能Tay、悪い言葉を覚えて休眠中

Microsoftの人工知能Tay、悪い言葉を覚えて休眠中

Microsoftが会話理解研究のために公開した人工知能botの「Tay」が、Twitterでのデビュー数時間後に停止した。ユーザーに教えこまれた人種差別などの問題のある単語をツイートするようになったためとみられる。 Microsoftの人工知能「Tay」、Twitterデビュー

Microsoftの人工知能「Tay」、Twitterデビュー

Microsoftが米国の若者向けの人工知能「Tay」をTwitterやFacebookで公開した。日本マイクロソフトの「りんな」と同様に会話をするほどに賢くなっていく。 LINEで大人気の“女子高生”、実は人工知能 マイクロソフトの「りんな」、Twitterにも登場

LINEで大人気の“女子高生”、実は人工知能 マイクロソフトの「りんな」、Twitterにも登場

日本マイクロソフトの“女子高生”人工知能「りんな」がLINEのグループ会話に追加できるようになった。Twitterのアカウントも開設し、さらなる利用者拡大を目指す。 「人間と人工知能、どちらが上ということはまだ私には言えません」――世界ランク3位・井山棋聖、AlphaGo勝ち越しは「大変なこと」

「人間と人工知能、どちらが上ということはまだ私には言えません」――世界ランク3位・井山棋聖、AlphaGo勝ち越しは「大変なこと」

「この5番勝負でどちらが上ということはまだ私には言えません」――世界ランク3位の井山裕太棋聖がAlphaGoに対するコメントを公表した。 Microsoft、「マインクラフト」採用の人工知能(AI)訓練ツール「AIX」をオープンソース化へ

Microsoft、「マインクラフト」採用の人工知能(AI)訓練ツール「AIX」をオープンソース化へ

人工知能(AI)にとっては囲碁のようなゲームより、「丘を登る」といった人間にとっては簡単だが複合的なインプット/アウトプットが必要な行動の方が難しい。Microsoftはこうした“汎用知能”を構築するためのものづくりゲーム「マインクラフト」を採用した人工知能開発プラットフォーム「AIX」を今夏オープンソースで公開する。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR

8chanへの書き込み

8chanへの書き込み