人工知能で「ヒット曲」難しい理由 ”良い音楽”は科学できるのか:これからのAIの話をしよう(音楽編)(1/5 ページ)

10月9日に、芸能人が“一流の音”を見極めるバラエティー番組「芸能人格付けチェック ミュージック 秋の3時間スペシャル」(テレビ朝日系)が放送されました。

目隠しをした状態で、バイオリンや声楽、和太鼓といった音色を2パターン聴き、どちらがアマチュアの演奏で、どちらがプロの演奏かを聴き分けるというものです。アーティストを含め、一流と呼ばれる芸能人の方々が自信満々のドヤ顔でプロとアマチュアの音を聴き間違えている姿を見ると、「芸能人だって人間だもの」と安心できました。

芸能人でも、アマチュアとプロの演奏の違いを聴き分けられないことが分かりました。それでは、これが人工知能が作った音楽と、人間が作った音楽の違いだった場合、私たちはこれを聴き分けられるのでしょうか。

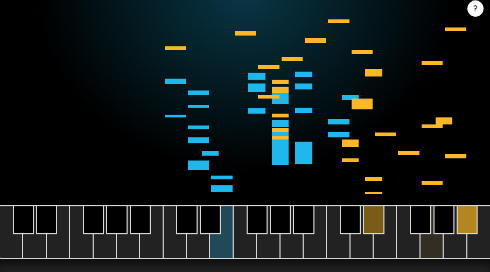

2018年現在、さまざまな人工知能による自動作曲サービスが登場しています。例えば、Googleのオープンソースライブラリ「Tensorflow」を使った、機械学習による音楽や美術作品の生成を目指すプロジェクト「Magenta」や、"一生一緒にいてくれや"のフレーズでおなじみのアーティスト 三木道三さん(現DOZAN11さん)が開発に参加された、写真から音楽を自動作成するソフト「PhotoMusic 2.0」、楽曲のスタイルや雰囲気などを選ぶだけで自動作曲できる「Amper Music」や「Jukedeck」などがあります。

Googleが「Magenta」プロジェクトで公開した、AIとピアノでセッションできる「A.I. Duet」のデモ動画。人間が鍵盤で入力したメロディーにAIが反応し、それと掛け合いになるようなメロディーを返してくる(青が入力した音、オレンジがそれに反応した出力)

Googleが「Magenta」プロジェクトで公開した、AIとピアノでセッションできる「A.I. Duet」のデモ動画。人間が鍵盤で入力したメロディーにAIが反応し、それと掛け合いになるようなメロディーを返してくる(青が入力した音、オレンジがそれに反応した出力)自動作曲されたこれらの曲を聴くと、「人工知能が作った」と言われなければそうと気付かないほど自然なメロディーになっていることが分かります。10月25日には、人工知能が描いた絵画が、米ニューヨークの著名オークション「クリスティーズ」で43万2500ドル(約4900万円)という高値で落札されたという報道もありました。

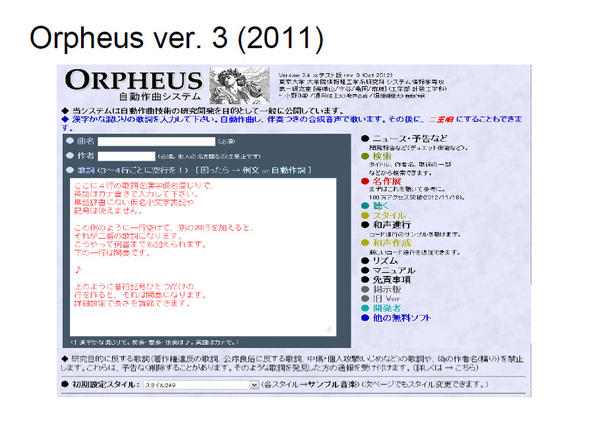

音楽の領域では、人工知能がヒット曲を生み出す作曲家になる日は来るのでしょうか。入力された歌詞のイントネーションを解析して曲を自動生成するシステム「Orpheus」(オルフェウス)の開発に2008〜13年までの大学院在籍時に携わっていた産業技術総合研究所 主任研究員の深山覚さんに聞きました。

「人工知能が作曲する」とは、具体的に何を指すのか。今の自動作曲システムの実力や、作曲家にとってどれほどの脅威になり得るのか、人工知能にヒット曲は生み出せるのかなど、さまざまな疑問をぶつけてみました。

(編集ITmedia村上)

編集部注:「Orpheus」は現明治大学の嵯峨山茂樹教授のアイデアから生まれ、東京大学らの研究チームで研究・開発されたもの。深山さんは、2008年〜13年までの東京大学大学院在籍時に開発に携わっていた。

連載:これからのAIの話をしよう

いま話題のAI(人工知能)には何ができて、私たちの生活に一体どのような影響をもたらすのか。AI研究からビジネス活用まで、さまざまな分野の専門家たちにAIを取り巻く現状を聞いていく。

目次

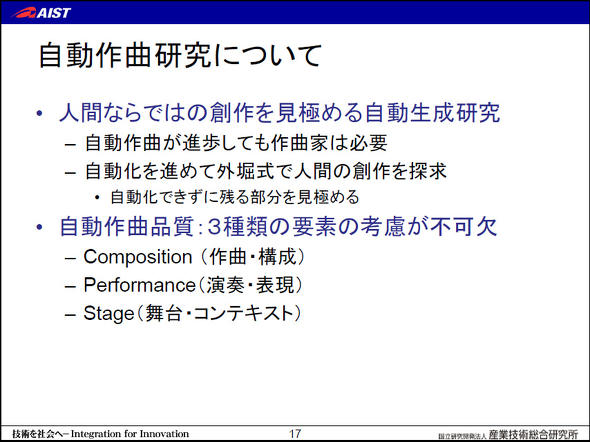

自動作曲で重要な“3つの要素“とは?

Orpheusは、ユーザーが入力した日本語の歌詞に合わせて歌を自動で作曲するシステムです。歌詞のイントネーションを解析し、曲調やコード進行を決めると、その歌詞に合ったメロディーを生成してくれます。

深山さんは、自動作曲の品質を考える上で欠かせない“3要素“として「Composition(作曲・構成)、Performance(演奏・表現)、Stage(舞台・コンテキスト)の3つの観点を同時に考える必要がある」と指摘します。

「譜面自体が良いと、もちろん良い曲だと受容されるでしょう。しかし、その曲がどう演奏されるかでも聴き手の受け止め方は変わります。例えばランダムに作られた音でも、プロの演奏家が表情豊かにその曲を演奏したら、“それっぽく“聞こえます。有名な作曲家が作った、有名なピアニストが弾いた、有名なコンサート会場で演奏した、といったコンテクスト(文脈や背景)でも感じ方は変わります。ですからComposition、Performance、Stageの3要素を考えるのは欠かせません」(深山さん)

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR