「ディープラーニングは最小二乗法」で物議 東大・松尾豊氏「深い関数の方が重要」

「ディープラーニングは、原理的には単純な最小二乗法にすぎない」――2月18日付けで日本経済新聞電子版が公開した記事について、Twitterでは「ディープラーニング=最小二乗法」という解釈は異なるのではという指摘が相次いだ。19日には「ディープラーニング」「最小二乗法」といったワードがTwitterでトレンド入りし、波紋が広がっていた。

日経の記事では、慶應義塾大学経済学部の小林慶一郎教授がAI技術について解説。「近年、驚異的な発展を見せているAIのディープラーニング(深層学習)は、原理的には単純な最小二乗法(誤差を最小にする近似計算の一手法)にすぎない」と言及し、「ディープラーニングは『最小二乗法』」と題する図版が掲載された。

最小二乗法は、測定で得られたデータの組を、1次関数など特定の関数を用いて近似するときに、想定する関数が測定値に対してよい近似となるように、モデル関数の値と測定値の差の2乗和を最小とするような係数を決定する方法。ディープラーニングに詳しい東京大学の松尾豊特任准教授は、2018年8月に登壇したイベントで、「ディープラーニングは最小二乗法のお化けのようなもの」「従来のマシンラーニングは(階層的に)『浅い』関数を使っていたが、ディープラーニングは『深い』関数を使っている」と説明していた。

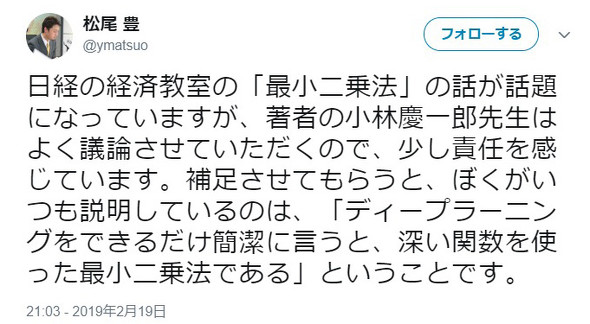

松尾氏は2月20日、Twitterの公式アカウントで「小林慶一郎先生はよく議論させていただくので、少し責任を感じています」とツイート。ディープラーニングを簡潔に解説するため「深い関数を使った最小二乗法」という言葉を使ってきたが、「深い関数を使った」という説明がいつも抜け落ちてしまうと嘆く。

続けて、「深い関数により表現力が革命的に上がり、アルゴリズム的な挙動も含め表現できるのは驚くべきこと」「『最小二乗法』は、損失関数を最小化することで、モデルのパラメータをデータから推定すること(略)深いことに比べるとそれほど重要ではありません」と投稿。経営者や政治家など、AIに詳しくない非エンジニアに正しく理解してもらうための解説は「大変難しい」と痛感しているようだ。Twitterでも同様に、AI技術について上司や同僚にどう解説すればいいかを嘆くエンジニアの声も見られた。

松尾氏は「深い関数」の意味やそれがもたらす可能性について、今後も研究や啓もう活動を続けていくと発信した。

関連記事

なぜ日本は人工知能研究で世界に勝てないか 東大・松尾豊さんが語る“根本的な原因”

なぜ日本は人工知能研究で世界に勝てないか 東大・松尾豊さんが語る“根本的な原因”

なぜ日本はAI(人工知能)の研究開発で米国や中国に勝てないのか。ディープラーニング研究の第一人者、東京大学の松尾豊特任准教授が日本の問題点を解説する。 人工知能開発は「儲けないと意味がない」 東大・松尾豊さんが見た“絶望と希望”

人工知能開発は「儲けないと意味がない」 東大・松尾豊さんが見た“絶望と希望”

日本が人工知能開発で世界と戦う上で可能性のある分野や領域は。日本国内におけるディープラーニング研究の第一人者である東京大学の松尾豊特任准教授に聞く。 「開発の丸投げやめて」 疲弊するAIベンダーの静かな怒りと、依頼主に“最低限”望むこと

「開発の丸投げやめて」 疲弊するAIベンダーの静かな怒りと、依頼主に“最低限”望むこと

AI(人工知能)開発を丸投げするクライアントの「いきなり!AI」に苦悩するAIベンダー。データサイエンティストのマスクド・アナライズさんに、AI開発現場の実態と、依頼主に最低限望むことを聞いた。 「世の中が変わることが面白い」 84歳の田原総一朗氏がAIに興味を持つ理由

「世の中が変わることが面白い」 84歳の田原総一朗氏がAIに興味を持つ理由

ジャーナリストの田原総一朗さんは、なぜ人工知能の取材を熱心に続けているのか。AIに関心を持ったきっかけや、取材を通して感じたAIへの思いを聞いた。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR