ITmedia NEWS >

STUDIO >

OpenAI、まことしやかなフェイクニュースも簡単生成の言語モデル「GPT-2」の完全版を公開

» 2019年11月08日 10時47分 公開

[ITmedia]

イーロン・マスク氏が共同会長を務める非営利の米AI(人工知能)研究企業OpenAIは11月5日(現地時間)、自然言語の文章を生成する言語モデル「GPT-2」を公開したと発表した。

同社は2月、GPT-2を発表したが、その段階では悪意あるアプリに流用される懸念から、オープンソース化はせず、縮小版モデルと論文のみ公開した。

GPT-2は、ネット上のテキストの次の単語を予測するためだけに訓練されたTransformerベースの言語モデル。800万のWebページのデータセットで訓練し、15億のパラメータを持つ。

同社は段階的にパラメータの少ないモデルを公開してきたが、これまで広範な悪用はされていないため、完全版の公開に踏み切った。完全版を公開することにより、外部の研究者らが、より高性能な合成テキスト検出モデルを開発することを期待するとしている。

機械学習エンジニアのアダム・キング氏が公開しているGPT-2の公開版のテストができるWebサイト「Talk to Transformer」も15億パラメータ版に更新されており、誰でも試すことができる。

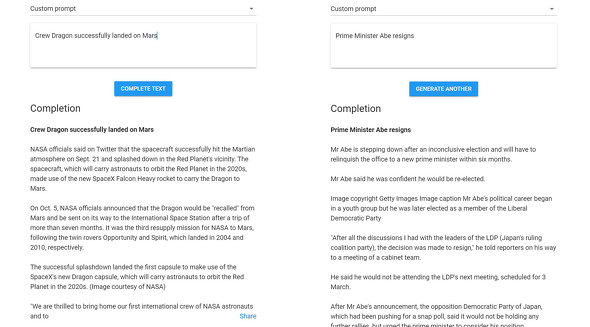

以下は、「(SpaceXの)Crew Dragonが火星着陸に成功」と「安倍首相が辞任」というテキストを入力した結果だ。日付(自民党の「次の会議」が3月3日となっている)などでフェイクだと分かりそうだが、かなりそれらしい内容になっている。

OpenAIは、「過去9カ月のGPT-2開発の経験により、AIに関する公開標準作成のための課題についての貴重な洞察を得ることができた。この問題に関する取り組みを継続していく」としている。

関連記事

OpenAI、まことしやかなフェイクニュースも簡単生成の言語モデル「GPT-2」の限定版をオープンソース化

OpenAI、まことしやかなフェイクニュースも簡単生成の言語モデル「GPT-2」の限定版をオープンソース化

非営利の米AI研究企業OpenAIが、人間が冒頭テキストを与えるとコンテキストを判断して首尾一貫した続きの文章を生成する言語モデル「GPT-2」を発表。フェイクニュース生成などの悪用を懸念し、オープンソース化はしない。 Microsoft、OpenAIに10億ドル出資し、汎用AI開発に取り組む

Microsoft、OpenAIに10億ドル出資し、汎用AI開発に取り組む

Microsoftとイーロン・マスク氏らが立ち上げたAI企業OpenAIがAGI(汎用AI)開発で提携する。MicrosoftがOpenAIに10億ドル出資し、OpenAIの独占的クラウドプロバイダーになる。 人工知能の悪用を防ぐために OpenAIの論文が示すリスクとは?

人工知能の悪用を防ぐために OpenAIの論文が示すリスクとは?

シンギュラリティによってAIが人類を支配する世界がやって来るかどうかはさておき、現時点では人間がAIを悪用するリスクの方が怖そうです。 イーロン・マスク氏のOpenAI、人工知能学習プラットフォーム「Universe」をオープンソース化

イーロン・マスク氏のOpenAI、人工知能学習プラットフォーム「Universe」をオープンソース化

非営利の米AI(人工知能)研究企業OpenAIが、ゲームなどの環境内でAIエージェントを訓練できるAI学習プラットフォーム「Universe」をGitHubで公開した。 イーロン・マスク氏ら、人類に益する人工知能を目指す「OpenAI」立ち上げ アラン・ケイ氏も参加

イーロン・マスク氏ら、人類に益する人工知能を目指す「OpenAI」立ち上げ アラン・ケイ氏も参加

ピーター・ティール氏やイーロン・マスク氏などのPayPalマフィアの面々やY Combinatorのサム・アルトマン社長らが、人工知能(AI)を人類への脅威ではなく、人類に益する存在に発展させることを目的とした非営利の研究機関「OpenAI」を設立した。起業家らやAWS、Infosysなどが総額10億ドルを投じる。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR