なぜクラウドではダメなのか? いま「エッジAI」が注目されるワケ:よくわかる人工知能の基礎知識(2/3 ページ)

とはいえ、エッジ処理も万能なわけではない。エッジに近いデバイスの全てに高速処理が可能な機械を搭載するのが現実的ではないからこそ、データ処理を一極で行うクラウドコンピューティングが活用されているのだ。ではエッジAIの場合はどうなのかを見ていきたい。

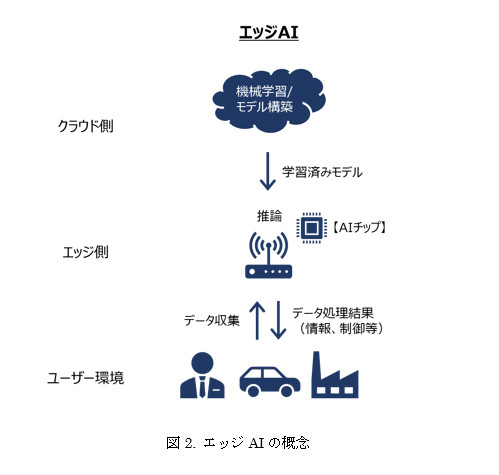

機械学習のモデル構築には、大量の学習データやそのデータを高速処理できる環境が必要になるが、その学習をエッジ側で行うのは難しい。そこでエッジAIでは、あらかじめクラウド環境などで機械学習を行い、生成された学習済みモデルをエッジ側のデバイスに与え、エッジ側で推論させている。そのため、エッジ側のデバイスには「(推論用)AIチップ」を搭載する。これにより、必要な判断がエッジ側で高速に行えるようになるのだ。

エッジAIは、現実の世界で瞬時の判断が求められるようなケースでその威力を発揮する。用途としては、先ほどの工場の例や、自動運転の分野などがよく挙げられる。走行中の自動運転車の前に突然子どもが飛び出してきた際に、いちいちクラウドで状況判断するわけにはいかないだろう。たとえデータ処理が瞬時に行われたとしても、送受信にかかるわずかなタイムラグが、子どもや乗客の命を左右する恐れがある。現場が通信環境が整った場所でない可能性もあるだろう。

実際に自動車業界は、AIを含むエッジコンピューティングの活用に力を入れている業界の一つだ。17年にはトヨタ自動車、米Intel、NTTなどの7社が共同で「Automotive Edge Computing Consortium」という団体を設立した。

同コンソーシアムの予測によれば、ネットワークに接続されたコネクテッドカーとクラウドの間でやりとりされるデータの量は、25年までに1カ月当たり10エクサバイト(1エクサバイト=1000ペタバイト)に達するようになるという。これを効率的にさばき、安全に自動車を走行させるためのアーキテクチャとして、エッジコンピューティングが期待されている。

また、防犯カメラの高度化にもエッジAIが活用されている。本連載でもAIによる映像解析の例を挙げてきたが、映像内に何が写っているかを自動で判別できると、さまざまな価値を生み出せる。交通量を確認したり、テロや万引きなどの怪しい行動を把握したり──といった具合だ。映像データは容量が大きく、プライバシーの観点からも遠隔地にあるサーバにデータを転送することは望ましくないケースがあるだろう。そこで、基本的な処理はエッジ側で完結できるような製品やシステムが求められているのだ。

例えば、ソニーが19年に発表した、Edge Analytics Appliance(エッジ・アナリティクス・アプライアンス)と呼ばれる製品(REA-C1000)は、映像内の顔の検知や、色・形状の認識などをできる学習済みモデルと、それを動かすAIチップを搭載している。これをカメラに接続することで、高度な映像制作を支援してくれるという。

上の動画では、被写体となる女性が移動すると、カメラが女性を自動でトラッキングしていくデモを公開。セミナーや授業などでこれを使えば、壇上で動き回るプレゼンの様子を自動で配信できるというわけだ。現在、新型コロナウイルスの感染拡大によって会議や授業などをオンラインで配信する企業が増えているが、そうした場面にも役立つだろう。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR