ギター弾き語りをAIマスタリングしてくれるiPhoneアプリは飛び立てるか?(2/3 ページ)

最終ゴールは、バンド編成のミックスとマスタリング

社内起業制度に応募し、このプロジェクトを進める3人のメンバーにリモートで話を聞いた。「プロ用の機材で熟練のエンジニアが処理したような音作りをAIが自動で行ってくれるプログラムを作りたいと考えました」と、リーダーの吉川大地氏きっかけを熱く語る。事業化前のパブリックβということもあり、現状は、弾き語り用としての機能しか持ち合わせていないが、最終ゴールは、バンド編成のミックスとマスタリングを行えるまでに進化させたいという。

OTO-nectの開発メンバー。上段左から、サウンドエンジニアで予算管理担当の大平剛氏、リーダーで企画推進の吉川大地氏、技術全般を担当する冨山吉孝氏。取材には不参加だが、あと1名、Webサイト制作、アナリティクス、ワイヤーフレームなどを担当するMT氏もメンバー。下段は、筆者と編集担当の松尾公也氏

OTO-nectの開発メンバー。上段左から、サウンドエンジニアで予算管理担当の大平剛氏、リーダーで企画推進の吉川大地氏、技術全般を担当する冨山吉孝氏。取材には不参加だが、あと1名、Webサイト制作、アナリティクス、ワイヤーフレームなどを担当するMT氏もメンバー。下段は、筆者と編集担当の松尾公也氏ただ、社内起業制度候補に選出されたスタート当初は、動画撮影の機能は考えていなかったそうだ。しかし、コロナ禍の巣ごもり需要でアコースティックギターが売れ、弾き語り動画ニーズの高まりを受け、動画撮影機能を搭載したのだという。とはいうものの、後述するAIによる自動マスタリング機能に並々ならぬ情熱を傾けていることからも分かるように、「主」は音楽であり、動画はあくまでも「従」であると理解すべきだろう。

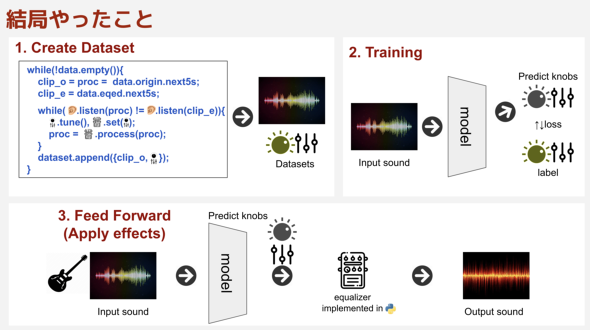

最大のキモとなる、音処理の仕組みについて聞いた。「ミックス、コンプレッション、イコライザー(EQ)、ノイズ除去を自動で行っています」(冨山氏)といい、現在のバージョンでは、EarPods付属のマイクに最適化した音の処理を行うようにチューニングされているそうだ。

そこで、気になるのは、AIによる音声処理の仕組みだ。AIでは主にEQ周りの処理を実施している。まず、音声データをスペクトログラム画像に変換することで、CNN(Convolutional Neural Network)ベースのAIモデルを利用する仕組みを構築した。

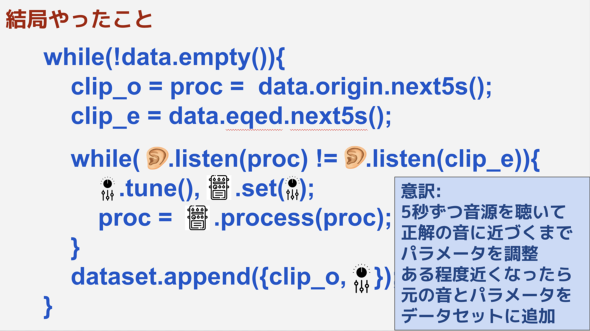

その上で、次のような推論を立ててEQ処理の自動化を試みた。「Python EQ」(図参照)と称する自作のEQプログラムを書き、「Python EQでランダムな設定をたくさん試し、波形がプロの録音エンジニアの音に近くなる“設定”を教師データとする方法を考えました」(冨山氏)というものの、この方法は、思い描いた結果を得ることができなかったそうだ。

冨山氏は、「プロのエンジニアが使ったイコライザーソフトのプログラムとPython EQの特性が異なり、“似た音が似た波形になる” という考え方が成り立たなかったからだと思われます」と顔を曇らせた。

次に試したのは、驚くほど泥臭い人力作業だ。「まず、プロの録音エンジニアが処理した音を自分の耳で聴きます。次に、自作のPython EQで処理した音を同じく自分の耳で聴きます。聴覚上で両者の差異を感じなくなるまで、ひたすらPython EQの設定調整を繰り返します」と説明する。

その作業を繰り返すことで、「この設定であれば、Python EQで録音プロエンジニアの音に近くなる」というデータを確立することができ、この「未処理の入力音声:最適EQ設定」をデータセットとして機械学習に投入する。このように、データセットを確立した上で、ユーザーの入力音声を前処理として全てスペクトログラム画像に変換し、「スペクトログラム画像の入力に対して設定情報(10次元程度のベクトル)を出力するモデルとして機械学習を実施しています」(富山氏)と力説する。

実際の機械学習は、GCP(Google Cloud Platform)上にDockerでコンテナ環境を構築して実行している。従って、「他のプラットフォームでも容易に動かすことができる」(冨山氏)と胸を張る。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR