観光地でペンギンとダンス? AIで環境音を生成? コロナ禍のいま行きたい“バーチャル世界旅行”をご案内:遊んで学べる「Experiments with Google」(第6回)(3/3 ページ)

GoogleストリートビューにAIで環境音を付ける「Imaginary Soundscape」

Hopper the Penguin ExplorerとFloating Shiny Knotをそれなりに楽しんだが、どうも違和感がある。いろいろ考えて、違和感の正体にたどり着いた。どちらも音が聞こえない無音の世界なのだ。

それならば、AIでストリートビュー画像にふさわしい音を付けられる「Imaginary Soundscape」を試してみよう。

環境音に包まれる臨場感がたまらない

Imaginary Soundscapeを起動したら、まず「Street View」か「Upload Your Image」のどちらかを選ぶ。ここでは世界旅行をするので、前者をクリックしよう。

最初に表示されたのは東京ドームのグラウンド。観客席は空っぽだが、臨場感のある大歓声が流れ出す。満員になった試合だと、選手はこのような声援に包まれて試合をするのだろうか。

画面上部にある「Venues」をクリックすると、オススメの場所を提案してくれる。サンフランシスコを選ぶと、まさに都会の雑踏といった環境音が流れてきた。気のせいか、サンフランシスコ名物のケーブルカーらしき音も聞こえる。続いてスペインのサグラダ・ファミリアを訪れると、響き渡る鐘の音が素晴らしかった。

Imaginary Soundscapeは検索して好きな場所にも行ける。エッフェル塔と東京タワー、東京スカイツリーに行ってみた。その場所にピッタリな音もあれば、とんちんかんな音もある。とはいえ、通常のGoogleストリートビューと同じように移動しながらその場所の環境音を補ってくれるので、実際にその場を歩いているような錯覚に陥る。

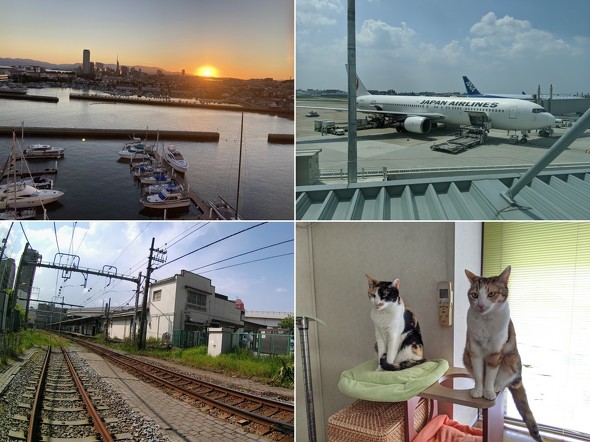

世界旅行とは違うが、最初の画面でUpload Your Imageを選ぶとアップロードした写真に音を割り当てられる。「マリーナの日の出」は波の音が、「駐機中のジェット旅客機」はエンジンの音が再生され、撮影したときの記憶がよみがえった。一方で「線路」には蒸気機関車の音、「猫」には猫を可愛がる人間の声が付くなど、人間には理解しがたいAIの想像(?)を体験できる。

画面上部の「Showcase」からは、さまざまな名画を選べる。葛飾北斎の「冨嶽三十六景 東海道江尻田子の浦略図」で波の音が流れるなど、こちらも大変興味深い。

画像と音の特徴をニューラルネットワークに学習させて実現

Imaginary Soundscapeは、AIを使ったアート作品を作るQosmoの徳井直生社長が開発した。「人間と同じように、AIも1枚の写真から音を想像できるのか」という疑問から生まれた作品だ(徳井社長自身の解説)。

まず、準備段階では大量の動画から特定のフレームの画像データと、そのタイミングの音データを取り出して、それぞれの特徴を畳み込みニューラルネットワーク(CNN)に学習させる。こうすることで、両者を関連付けた学習モデルを作れる。

そしてImaginary Soundscapeを実行するとき、任意の画像をこのモデルに当てはめ、得られた出力結果に似た特徴の音データを、事前に用意した音声ファイルから見つけ出す。このファイルを再生することで、画像にふさわしい音を流せる仕組みだ。

旅は五感で味わうもの 今後テクノロジーが五感を刺激するかも?

ここまで、駆け足で旅行をしてみた。果たして、世界を何周したのだろうか。自宅にいながら世界旅行した気分になる反面、自分の足で歩きたいとも思った。そう感じたのは、旅行がただ名所を眺めるだけでなく、五感で味わうものだからだろう。現地だからこそ体験できる匂いや風、味、踏みしめる地面の触覚などの大切さを、改めて認識した。

しかし、本記事で紹介したテクノロジーも隅には置けない。Googleストリートビュー単体でも観光や旅程の下調べで大活躍するが、ユーザーが一緒に楽しめる仕掛けや没入感を演出する仕組みを取り入れれば、より興味深い体験を提供できる。Imaginary Soundscapeが目だけでなく耳も刺激したように、テクノロジーが五感を刺激する日も近いかもしれない。そのうち、リアリティーの高いバーチャル世界旅行をテーマパークや自宅で楽しむ時代がくるのだろうか。

関連記事

沖縄企業が“バーチャル首里城”公開 焼失した正殿もVRで観光

沖縄企業が“バーチャル首里城”公開 焼失した正殿もVRで観光

VRやバーチャルYouTuber事業を手掛ける「あしびかんぱにー」が、沖縄の観光地を再現したVR空間「バーチャルOKINAWA」で、首里城エリアを公開する。PCやスマートフォンがあればいつでも“バーチャル首里城”を観光できる。 看板や音も再現した「バーチャル秋葉原」公開、アキバ文化を世界に発信 「オンラインメイド喫茶」も

看板や音も再現した「バーチャル秋葉原」公開、アキバ文化を世界に発信 「オンラインメイド喫茶」も

AKIBA観光協議会と大日本印刷は4日、秋葉原の街を再現したメタバース「バーチャル秋葉原」を公開した。アニメやゲームの情報発信やグッズ販売の場として活用する。 Googleストリートビューからリアルなバーチャル3Dシーンを自動作成 Googleとトロント大が開発

Googleストリートビューからリアルなバーチャル3Dシーンを自動作成 Googleとトロント大が開発

米Google Researchとカナダ・トロント大学の研究チームは、Googleストリートビューなどで取得できる情報を基に、複数の視点の画像から合成して作り出す新たな視点画像と3D再構成を自動作成する手法を開発した。 “ふくよかキャラ”を引っ張り奏でるオペラAI「Blob Opera」 美しい音色の裏に、開発者の試行錯誤あり

“ふくよかキャラ”を引っ張り奏でるオペラAI「Blob Opera」 美しい音色の裏に、開発者の試行錯誤あり

画面に映る“ふくよかキャラ”を引っ張って美しい音色を奏でるオペラAI「Blob Opera」で遊んだ。愛嬌ある姿ときれいな歌声にウットリしてしまう。開発には、職人技的なパラメータ調整が必要だった。 絵巻物のモチーフをAIで判別 木、橋、動物――作品の共通点に注目する新たな鑑賞スタイルを体験

絵巻物のモチーフをAIで判別 木、橋、動物――作品の共通点に注目する新たな鑑賞スタイルを体験

AIを活用して新たな美術鑑賞スタイルを提示するWebアプリ「Beyond Scrolls & Screens」を体験した。絵巻物や屏風に描かれたモチーフをAIで判定し、「木」「動物」など各作品の共通点に注目して鑑賞できる。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR