話題の画像生成AI「Stable Diffusion」、ビジネスモデルは? 企業の利用状況は? 日本法人代表にいろいろ聞いてみた(2/3 ページ)

ジェリーさんは「さまざまなモデルを考えているが、メインは“カスタムプライベートモデル”」と話す。「Stable Diffusion本体はオープンソースで提供を続けますが、企業が独自に保有する画像データを基に、追加学習したモデルをStability AI側で作る。これを提供し、報酬をもらう形態を考えています」と展望を語った。

イラストレーターなどからの警戒感

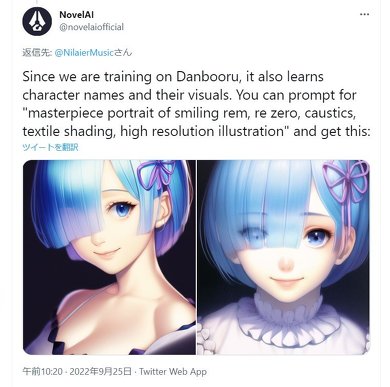

一方、一部のイラストレーターなどからは強い警戒感も抱かれている。注目されるきっかけとなった一つは、22年10月に発生した「NovelAI」のモデル流出事件だ。

NovelAIは米Anlatanが運営するWebサービス。キャラクターイラストに特化した、Stable Diffusionベースの画像生成モデルを提供している。同社は学習元としてイラストサイト「Danbooru」の画像データを利用しているが、このサイトは他人の画像を無断で掲載している疑いがあることから、それを学習データにするのは法的に問題がなくとも企業倫理を批判する声があった。

さらに同月、NovelAIの画像生成モデルが流出。流出モデルを使うユーザーが出てきた他、Stable Diffusionは2つのモデルから新たなモデルを作る「マージ」が可能なことから、流出モデルを混ぜたモデルが広く出回るようになり、抑制が難しい状況となった。しかもこれら流出派生モデルは性能が高く、LoRAなどと組み合わせることで特定のイラストレーターの画風を高い品質でまねることも可能になる。

「モデルをオープンにしないとAIの民主化はできない」

記者から「画像生成系AIは一連の騒動により、クリエイターコミュニティーからネガティブな受け止めをされている」ことについて見解を問われたジェリー氏は、以下のように答えている。

「本当に誰でも自由に改変できるAIをリリースすると、誰かが悪用したり変な用途に使ったりするので、必ずこういう問題は生じると思います。ただ、モデルをオープンにしないとAIの民主化はできない。オープンにした方がよいと個人的には考えています」

その上で、ジェリーさんは「イラストレーターのコミュニティーとも仲良くしたいと考えている」ともコメント。具体的な方法として、ライセンス・倫理的な問題が生じない“クリーンな”データセットを基に学習したAIモデルを作り、改善させていくことを推進すると表明。イラストレーターなど著作者には、「Have I Been Trained?」というWebサイトを通じて、訓練データからの除外(オプトアウト)を申請できると案内した。

“AIイラストの90%以上がグラビア”な状況への見解は

イベント終了後、ジェリーさんは囲み取材に応じ、国内でのStable Diffusionの受容について見解を語った。

―― 最近、Twitter上ではStable Diffusionの派生モデルで生成された、グラビアアイドルのような画像が大量に流通している。世の中のテクノロジーは欲求がけん引していく側面もあるが、今の使われ方についてどのように思っているか。

(関連記事:注目集める「AIコスプレイヤー」の作り方を調べてみたら、“無規制地帯”が見つかった イラスト生成のダークサイド)

ジェリー(以下敬称略) オープンなAIモデルを世に出すと、さまざまな使われ方をされていくものですから、世の中に大きな害意を及ぼしていなければ、許容するべきだと考えます。

もちろん、不適切なものもありえます。中には児童ポルノに近いようなものもありますが、そういったものは流通しないようにするべきでしょう。一方で、Stable Diffusionは生成モデルをオープンソースで公開しており、誰でも自由に派生モデルを制作して、画像を生成できます。従って、Stability AIとしては誰かが不適切な画像を生成するのを止めるのは困難です。

ただし個人的には、Twitterで流れているAIイラストの90%以上がグラビアという状況は、変わってほしいとも思っています。インターネット自体や、ネット決済もエロが起爆剤となったのはよく知られていることで、今の状況も理解はできるのですが、Stable Diffusionでもっと多様で、すてきな画像が作れますとお伝えできるように、事例を増やしていきたいと考えています。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR