ChatGPTなどLLMの弱点“ハルシネーション” 「GPTは要素技術だ。商用という意味では遠い」

ChatGPTのビジネス利用はブームだが、これをビジネスで活用しようとした場合、さまざまな課題がある。AIを活用したチャットボット開発などで知られ、ChatGPTのようなLLMの活用も進めているPKSHA Technologyが、商用利用のポイントについて語った。

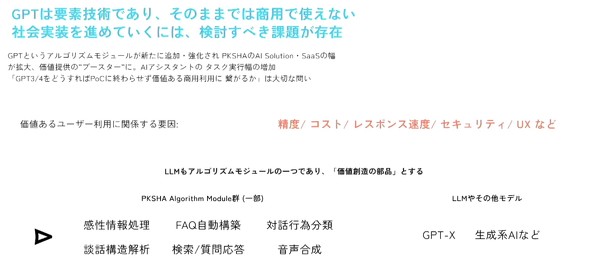

「GPTは要素技術だ。そのままでは商用という意味では遠い。検討すべき課題がある」。こう話すのはPKSHA Workplaceでプロダクトマネージャー/プロダクトデザイナーを務める花塚匠氏だ。

課題としては、精度、コスト、レスポンス速度、セキュリティなどが挙げられる。例えば、現在商用利用でほぼ唯一の選択肢となるOpenAIのGPT系APIは、上位のモデルになるほどコストがかかる。GPT-4モデルを使ったChatGPTの応答を見れば分かるとおり、速度も決して速いとはいえない。

ハルシネーション(人工知能の幻覚)

コストや精度という課題は、基本的に演算リソースによるもので、今後の半導体の進化によって自然と解決されていくものだろう。しかし精度については、解決は容易ではない。LLMが、堂々ともっともらしいウソをつくことはよく知られている。これは、ハルシネーション(人工知能の幻覚)と呼ばれLLMが根本的に抱える課題だ。

PKSHA Technologyでエンジニアリングマネジャーを務める中島真也氏は「ハルシネーションは一定は抑えられるが100%は難しい」と話す。

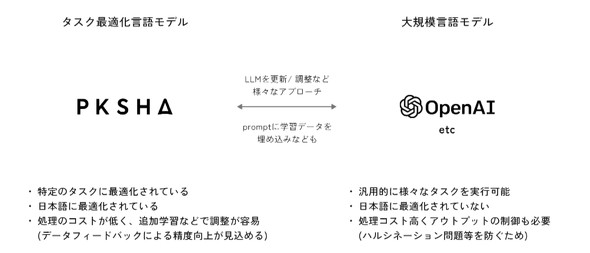

商用利用において、ハルシネーションを防ぎ、精度を上げる手法はいくつかある。例えばFAQに相当する内容を持ったデータベースを事前に準備しておき、それをLLMがアクセスしやすいようにベクトル化した上でマッチさせる、データベースの内容を事後学習(ファインチューニング)させるなどだ。

花塚氏は「ファインチューニングはコストがかかるので、外部のリソースを持ってきて、それをChatGPTに入力し、それをもとに回答する」形を解決策として挙げる。

既存AIモジュールとの組み合わせ、人が介入するUX

とはいえ、現時点ではChatGPTの精度を向上させるよりも、既存のAIモジュールと組み合わせるほうが、精度、コスト、速度のバランスが取れるようだ。

花塚氏は「LLMが得意とする部分を見極め、体験の中心ではなく、システム全体の1パーツとして利用する。既存モジュールを組み合わせて、コスト、精度、速度など最適なシステムを作るべき」だと指摘する。

PKSHAグループでは、機械学習を用いたLLM以外のAIモジュールを多数保有しており、特化した用途においては、こうしたAIモジュールと組み合わせるほうが利点が大きいとしている。またLLMの入出力においても「人の確認や入力する情報をマスクするなど、人が介入するUXを検討すべきだ」(花塚氏)としている。

今後の方向性として中島氏が指摘したのが、OpenAIのGPT以外のモデルの可能性だ。特に、米Metaが開発したLLaMAをベースに、世界各地で軽量LLMモデルの開発が進んでいる。また、オープンソースのLLMも各所から登場しており、画像生成AI同様、オープンソース起点で次の大きなイノベーションが起きる可能性もある。「テックジャイアントではなく、オープン系に期待したい」(中島氏)

関連記事

百花繚乱の大規模言語モデル その現状まとめ【2023年4月末版】

百花繚乱の大規模言語モデル その現状まとめ【2023年4月末版】

米OpenAIが独占的に提供する大規模言語モデル(LLM)に対し、さまざまなLLMが登場している。特に注目はオープンで自由な大規模言語モデル「Dolly-v2」だ。さながら現在は「不自由な大規模言語モデルと自由な大規模言語モデルの小競り合い」が起きている状態だ。 東大松尾教授が答える、ChatGPTとは何なのか? 一問一答

東大松尾教授が答える、ChatGPTとは何なのか? 一問一答

国内におけるAIの権威である東京大学の松尾豊教授は、ChatGPTをどう見ているのか? ChatGPTは、一時的なトレンドか技術的転換点か、AI研究者から見てChatGPTは? 日本もLLMを作ったほうがいいのか? といった問に答えた サイバーエージェントが公開した大規模言語モデルの実力を試す

サイバーエージェントが公開した大規模言語モデルの実力を試す

5月16日、サイバーエージェントが商用利用可能な7B(68億パラメータ)の大規模言語モデルOpenCalm7Bを公開した。早速その実力を試してみた。 ソフトバンク、LINEと和製GPT立ち上げへ 「やらなければ今後の参加権がなくなる」

ソフトバンク、LINEと和製GPT立ち上げへ 「やらなければ今後の参加権がなくなる」

ソフトバンクは5月10日の決算会見で、LINEと共同で和製GPTの立ち上げを進めていることを明らかにした。グループのLINEが開発を進めてきたLINE AiCallなどのHyperCLOVA技術をベースに、OpenAIに追いつくことを狙う。 自動運転には「LLM」が必須? 国内AIベンチャーが“目や耳”を持った大規模言語モデルを開発へ

自動運転には「LLM」が必須? 国内AIベンチャーが“目や耳”を持った大規模言語モデルを開発へ

自動運転車の開発・販売に取り組むTuringは3月20日、大規模言語モデル(LLM)を独自開発すると発表した。同社はLLMを開発する理由として「完全自動運転を実現するため」としている。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR