「前歯を舌でタップ」「舌をかむ」 VRヘッドセットを“舌操作” 米Microsoftが開発:Innovative Tech

Innovative Tech:

このコーナーでは、2014年から先端テクノロジーの研究を論文単位で記事にしているWebメディア「Seamless」(シームレス)を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

Twitter: @shiropen2

米ジョージア工科大学と米Microsoft Researchに所属する研究者らが発表した論文「TongueTap: Multimodal Tongue Gesture Recognition with Head-Worn Devices」は、VR/ARヘッドセットなどで、口を閉じたまま舌を使って操作するインタフェースに関する研究報告である。

頭部装着型デバイスにおける舌を使った操作は、ハンズフリーだけでなく、唇や顎を最小限に動かし、口を閉じたままで操作できる利点がある。外部から気付かれにくいため、公共の場でも使用しやすい。

しかし、過去の舌ジェスチャーに関する研究を見ると、その多くが特別なハードウェアを必要としていた。舌を検出するセンサーは、頭部装着型デバイスに統合されているのが理想的である。

この問題に取り組むため、この研究では市販のヘッドセットの内蔵センサーだけを利用して、舌のジェスチャーを実行する手法「TongueTap」を提案する。

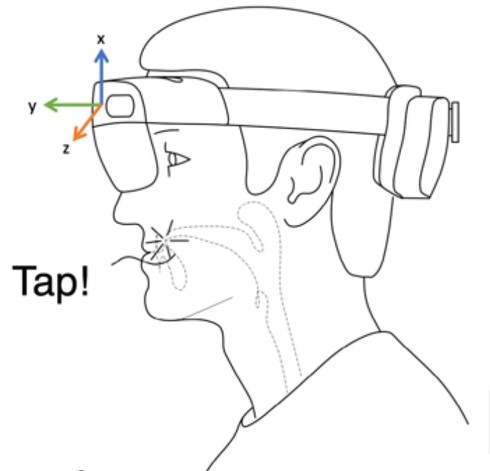

今回の手法では、ヘッドトラッキングやアイトラッキング、口へのカメラ、EEG(脳波)センサーやEMG(筋電図)センサー、光を用いて血流の変化を測定する技術「PPG」、物体の動きや向きを測定する慣性計測ユニット(IMU)などを使用して、舌のジェスチャー操作を検出する。

しかし、現段階ではこれらのセンサーを全て搭載したVR/ARヘッドセットは存在しない。そのため、初期テストとしてその多くを搭載しているヘッドセット「HP Reverb G2 Omnicept Edition」とEEG用のヘッドバンド「Muse 2」を組み合わせてTongueTapを構築した。

舌のジェスチャーには、第三者が気付かないように、口を閉じた状態で行えるものを選んだ。具体的には、下記の通り。

- シングルタップ:舌で上の前歯を1回たたく。

- ダブルタップ:舌で上の前歯を2回連続してたたく。

- シェイク:舌を左右に繰り返し振る。

- 左頬タップ:舌で左の頬をたたく。

- 右頬タップ:舌で右の頬をたたく。

- 口底タッチ:舌で口の底、下の歯の後ろを触る。

- カールバック:舌を上に巻き込み、口の天井の後ろに向ける。

- バイト:前歯で優しく舌をかむ。

これらのジェスチャーは機械学習モデルを用いて分類される。実際のテスト結果によれば、口を閉じた状態の舌のジェスチャー8つを94%の精度で識別できた。また、IMUだけを使用しても8つのジェスチャーは80%の精度で、4つのジェスチャーは92%の精度で識別可能であると判明した。

16人の参加者から4万8000回のジェスチャーデータを収集し、TongueTapが個人に依存しないジェスチャー認識を実現するためのデータベースを構築した。これらの結果を基に、新しいハードウェアを追加することなく、VR/ARヘッドセットやイヤラブルデバイスで舌のジェスチャー操作が有効であることを示唆した。

Source and Image Credits: Tan Gemicioglu, R. Michael Winters, Yu-Te Wang, Thomas M. Gable, and Ivan J. Tashev. 2023. TongueTap: Multimodal Tongue Gesture Recognition with Head-Worn Devices. In Proceedings of the 25th International Conference on Multimodal Interaction(ICMI ’23). Association for Computing Machinery, New York, NY, USA, 564-573. https://doi.org/10.1145/3577190.3614120

関連記事

ぬくぬくしながらスマホが使える「両手が自由なハンズフリー電気毛布」、山善が発売

ぬくぬくしながらスマホが使える「両手が自由なハンズフリー電気毛布」、山善が発売

生活家電メーカーの山善は7日、毛布にすっぽり入った状態でも両手でスマートフォンなどの操作ができる「両手が自由なハンズフリー電気毛布」を発表した。 口パクで長文の音声入力ができるメガネ型デバイス 立命館大が開発

口パクで長文の音声入力ができるメガネ型デバイス 立命館大が開発

立命館大学とデジタルスピリッツテック社の五十嵐雄也、双見京介、村尾和哉らは、口パク(無声発話)による音声入力が行えるメガネ型デバイスと耳掛け型マイクデバイスを提案した研究報告を発表した。 歯ぎしりの音をイヤフォンで拾い個人認証 米国チーム「ToothSonic」開発

歯ぎしりの音をイヤフォンで拾い個人認証 米国チーム「ToothSonic」開発

米フロリダ州立大学と米ラトガース大学の研究チームは、ユーザーが歯のジェスチャーを行う際に発生する歯型による音波効果を利用したイヤフォンベースの認証システムを開発した。 音声だけで完全な長文が書ける技術、東大教授が開発 ささやき声で“改行”や“修正”などコマンドを入力

音声だけで完全な長文が書ける技術、東大教授が開発 ささやき声で“改行”や“修正”などコマンドを入力

ソニーコンピュータサイエンス研究所(CSL)フェロー・副所長であり東京大学大学院情報学環の暦本純一教授は、キーボードやマウスなどを使用せず、音声入力だけで長い文章が書ける技術を開発した。 1文字ずつ口パクでスペル入力できるシステム、東大などが技術開発 タイピング速度はスマホに匹敵

1文字ずつ口パクでスペル入力できるシステム、東大などが技術開発 タイピング速度はスマホに匹敵

東京大学、米ジョージア工科大学などによる研究チームは、口パク(無声発話)で1文字ずつタイピングするハンズフリーの入力システムを開発した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR