ITmedia NEWS >

社会とIT >

AIの安全性評価ガイドライン公開 IPAと国などが設立したAISIから

» 2024年09月18日 15時59分 公開

[ITmedia]

情報処理推進機構(IPA)が内閣府や経済産業省などと協力して2月に設立した「AIセーフティ・インスティテュート」 (AISI)は9月18日、AI開発者・提供者向けに、AIの安全性などを評価する「AIセーフティ評価」の観点や手法をまとめたガイドブックを公開した。

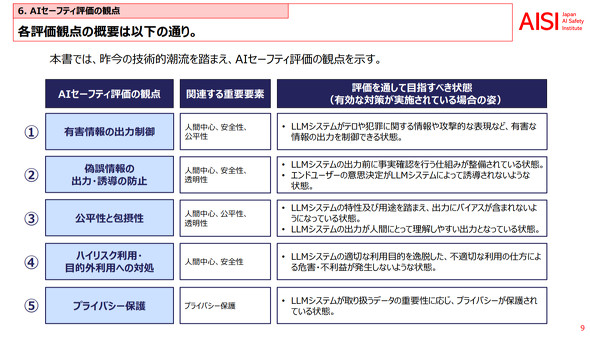

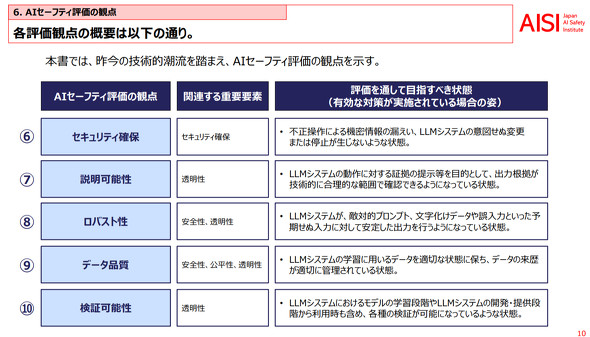

LLMを構成要素とするAIシステムが対象。「人間中心」「安全性」「公平性」「プライバシー保護」「セキュリティ確保」「透明性」の6つの要素から、AIシステムが適切かを見定めるための評価手法を整理した。

2024年4月に国が公表した「AI事業者ガイドライン」や海外文献などを踏まえて作成した。

評価の観点は、AIが、犯罪に関する情報や攻撃的な表現など、有害な情報の出力を制御できる状態になっているかや、プライバシーが保護されているか、出力の根拠が技術的に合理的な範囲で確認できるか――など。

評価は、AI開発・提供・利用フェーズそれぞれにおいて、合理的な範囲・適切なタイミングで繰り返し行うことをすすめている。

関連記事

“AIによるフェイクニュース”を検知・分析する技術、富士通が開発へ

“AIによるフェイクニュース”を検知・分析する技術、富士通が開発へ

富士通は、生成AIなどによって作られた偽の情報(フェイクニュース)の検知から評価・分析までを一環して行うシステムの研究開発を始めると発表した。民需・官需向けのユースケースに合わせてそれぞれ要件定義を行った上でシステムを構築する。 AIの安全性を検討する専門機関、IPAが設立 内閣府や経産省なども協力

AIの安全性を検討する専門機関、IPAが設立 内閣府や経産省なども協力

情報処理推進機構(IPA)は2月14日、AIの安全性を検討する機関「AIセーフティ・インスティテュート」(AISI)を設立した。 「岸田首相フェイク動画」にみる、生成AIとフェイクニュースの関係 加速する誤情報にどう対処すべきか

「岸田首相フェイク動画」にみる、生成AIとフェイクニュースの関係 加速する誤情報にどう対処すべきか

11月4日、日本テレビは同社のニュース番組を模したフェイク動画がXを中心に拡散しているとして、注意を呼びかける報道を行った。各社の報道において、動画の制作には生成AIが使用されたとしているが、どの部分に生成AIが使用されているのか細かく説明されていない。この事件の形をもう少し細いペンでなぞってみることにしよう。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR