ITmedia NEWS >

STUDIO >

YouTube、不適切な動画対策の成果を報告──機械学習によるフラグ精度向上

» 2018年04月24日 12時22分 公開

[佐藤由紀子,ITmedia]

米Google傘下のYouTubeは4月23日(現地時間)、不適切な動画の対策について説明した。昨年12月の説明の更新版だ。

YouTubeでは昨年3月、人種差別などの不適切なコンテンツが広告収入を得ているとして多くの企業が広告を引き上げた。Googleは6月、こうした問題に対処するために機械学習による問題コンテンツ検出システムの強化を約束した。

今回の発表は、2017年第4四半期(10〜12月)に削除した不適切な動画についてが中心。3カ月で約830万本の動画を削除した。その中の670万本は、ユーザーからの報告ではなく、同社が開発した機械学習システムが検出し、その後人間の担当者が確認して削除したものという。

670万本の機械学習が検出した動画の中、76%は1度も再生されないうちに削除した。

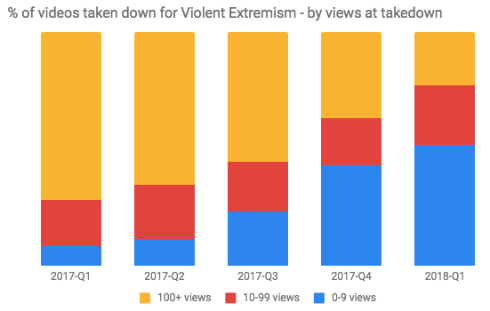

同社は不適切動画がアップロードされてから削除するまでに人の目に触れた回数が確実に改善しているとして、2017年第1四半期からの推移をグラフ化したものを紹介した。

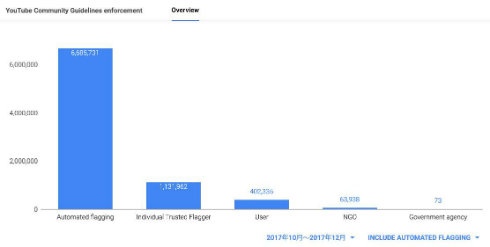

また、Googleが定期的に公開している透明性レポートに、YouTubeのコミュニティガイドラインの違反措置に関する報告を追加した。

透明性レポートでは、報告された問題の種類(性的なもの、スパム、ヘイトスピーチ、暴力的、など)別シェアや報告後の対処の例などを閲覧できる。

YouTubeは同日、コミュニティガイドラインについての説明動画も公式YouTubeチャンネルで公開した。

関連記事

Alphabet、Googleの広告好調で増収増益、GDPRについては「18カ月準備してきた」

Alphabet、Googleの広告好調で増収増益、GDPRについては「18カ月準備してきた」

Googleを傘下に持つAlphabetの1〜3月決算は、Googleの広告が好調で2桁台の増収増益だった。ピチャイCEOはEUが5月に施行する「一般データ保護規則」について「18カ月準備してきたので問題ない」と語った。 YouTubeのウォジスキCEO、クリエイターの収益化問題に対処すると説明

YouTubeのウォジスキCEO、クリエイターの収益化問題に対処すると説明

YouTubeのCEOが、クリエイターからの収益化についてのフィードバックを受け、対策について説明した。 YouTubeの広告掲載基準厳格化、人間によるチェックも

YouTubeの広告掲載基準厳格化、人間によるチェックも

人気YouTuberが不適切なコンテンツを公開して物議を醸したことを受けて、GoogleがYouTube動画に広告を掲載できるパートナープログラムの基準を2月20日からさらに厳格化すると発表した。 YouTube、不適切動画チェック担当者を2018年に1万人以上に

YouTube、不適切動画チェック担当者を2018年に1万人以上に

不適切なコンテンツ表示が問題になっているYouTubeが、機械学習による問題コンテンツ検出システムの強化と問題を判断するレビュアー増員計画について説明した。 YouTube、視聴回数1万未満のチャンネルは広告収入なしに

YouTube、視聴回数1万未満のチャンネルは広告収入なしに

YouTubeが、パートナープログラムを改定し、視聴回数が少ないチャンネルには広告を表示しなくなった。優良クリエイターの収入を守るためとしている。大手企業の広告引き上げを招いた問題の対策にもなりそうだ。 YouTubeからの大手メディア広告引き上げを受け、Googleが自動システム改善を約束

YouTubeからの大手メディア広告引き上げを受け、Googleが自動システム改善を約束

英国政府や大手メディアが、YouTubeの不適切な動画に広告が表示されるとして、YouTubeやGoogle Display Networkから広告を引き上げたことを受け、Googleが広告ポリシーを改善し、広告表示先を管理しやすくすると約束した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR