元OpenAI幹部、AI監査の非営利団体「AVERI」設立 「家電並みの安全確認」を目指す

米OpenAIの元AGI(汎用人工知能)シニアアドバイザー、マイルズ・ブランデージ氏は1月15日(現地時間)、フロンティアAI(最先端AI)の開発企業による安全性やセキュリティの主張を厳格に検証する監査を効果的かつ普遍的なものにすることを目指す非営利団体AVERIの発足を発表した。

AVERI(AI Verification and Evaluation Research Institute)は、米国の501(c)(3)に基づく非営利シンクタンク。その目的は、AI開発企業が公開されていない内部情報へのアクセスを独立した第三者に提供し、厳格な基準に基づいて安全性やセキュリティを検証する「フロンティアAI監査」のエコシステムを構築することだ。AVERI自身が監査法人として企業を監査するのではなく、監査に必要な基準の策定やツールの開発、政策提言を通じて、信頼できる第三者検証が普及する基盤を作ることを役割とする。

ブランデージ氏が同団体を設立した背景には、OpenAIでの7年間の経験を通じた強い危機感があるという。AI企業が安全性に関するルールを自分たちで決め、第三者による強制力のないまま「自らの宿題を採点している」のが現状だとしている。同氏は、一般的な家電製品でさえ独立した試験機関による安全確認が行われているのに対し、社会インフラとなりつつあるAIに対する外部からの監視が不十分であると指摘しており、企業内部の自主的な評価だけでは不十分だとして、より客観的で厳格な監査メカニズムの必要性を訴えている。

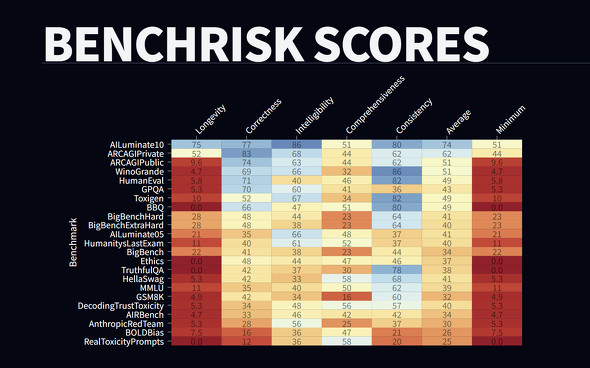

具体的な活動として、AVERIは立ち上げと同時にフロンティアAI監査のビジョンを示す論文(PDF)を公開し、監査の厳格さを4段階に分類する「AI保証レベル(AAL)」や、AIの評価手法そのものがどれほど堅牢で信頼できるかを測定するオープンソースツール「BenchRisk」などを提示した。

AVERIは、Amazon、Anthropic、Google DeepMind、OpenAI、Thinking Machines LabといったAI開発企業からAPIクレジットの提供を受けている。今後は、これらの企業が外部監査を受け入れるよう、保険会社や投資家、政策立案者と連携し、「安全なAIこそが経済的・政治的利益を生む」インセンティブ設計を進める方針だ。

関連記事

OpenAI、最先端AIのリスクに備える新責任者を募集 年俸約8000万円も「ストレスフルな仕事」とCEO

OpenAI、最先端AIのリスクに備える新責任者を募集 年俸約8000万円も「ストレスフルな仕事」とCEO

OpenAIは、新役職「Head of Preparedness」(準備責任者)の募集を開始した。フロンティアモデルがもたらすサイバー攻撃や生物学的リスク、メンタルヘルスへの影響などの深刻なリスクを追跡・評価し、製品リリース判断に直結させる役割を担う。年収は約8000万円で、高度な技術力と専門知識が求められる。 Microsoft AI、超知能研究チーム立ち上げ スレイマンCEOは「AGI競争」を否定

Microsoft AI、超知能研究チーム立ち上げ スレイマンCEOは「AGI競争」を否定

Microsoftは、Superintelligence(超知能)研究チーム立ち上げを発表した。■https://www.itmedia.co.jp/news/articles/2403/20/news069.html□MAIのスレイマンCEO■は「AGI競争」を否定し、人間中心主義に基づく「ヒューマニストスーパーインテリジェンス」(HSI)を構築すると述べた。人類に奉仕する実用的な技術を構築し、アライメントが喫緊の課題だとした。 OpenAIが組織再編、営利部門をPBCに Microsoftとの契約更新も

OpenAIが組織再編、営利部門をPBCに Microsoftとの契約更新も

OpenAIは、営利企業をPBC(公益法人)に転換したと発表した。経営権は非営利団体側の「OpneAI Foundation」が握る。Microsoftは同社との契約を2032年まで延長し、1350億ドルのPBC株式を保有する。AGI到達後も、「適切な安全ガードレール」が備えられていることを条件に技術へのアクセスが可能になる。 Google DeepMind、リアルタイムで世界を生成するAI「Genie 3」発表 “AGIへの足がかり”

Google DeepMind、リアルタイムで世界を生成するAI「Genie 3」発表 “AGIへの足がかり”

Google DeepMindは、プロンプトから対話可能な世界をリアルタイムで生成するAI「Genie 3」を発表した。物体の状態を記憶する「ワールドメモリ」機能を搭載し、数分間の一貫性を維持する。AGIへの足がかりと位置づけられ、AIエージェントの訓練などに活用される。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.