OpenAI、Cerebrasチップ搭載の高速エージェントコーディングツール「GPT-5.3-Codex-Spark」

米OpenAIは2月12日(現地時間)、エージェントコーディングツールの高速版「GPT-5.3-Codex-Spark」をリリースしたと発表した。5日に公開した「GPT-5.3-Codex」の小型版であり、リアルタイムでの対話的なコーディング作業を可能にすることを目的として設計したという。推論処理を高速化し、インタラクティブな編集やロジックの即時反映を実現する環境を提供するとしている。

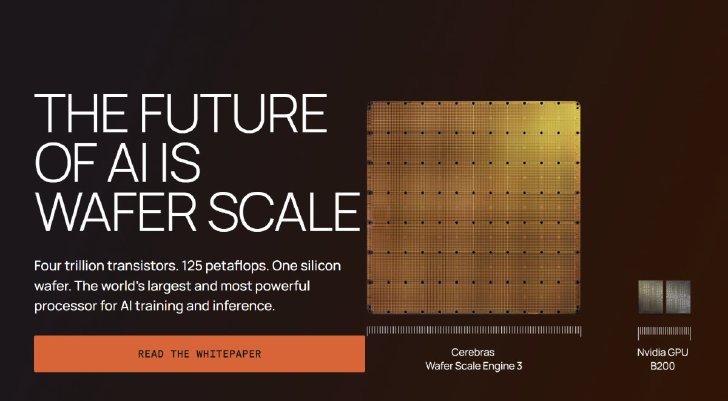

GPT-5.3-Codex-Spark(以下、Codex-Spark)は、米Cerebrasの専用チップ「Wafer Scale Engine 3」を活用している点が特徴だ。このAIアクセラレータは、1秒当たり1000トークン以上の処理能力を発揮するという。OpenAIは1月、Cerebrasとの提携を発表している。

Cerebrasは公式ブログで、Wafer Scale Engineが最大級のオンチップメモリによって高速推論を実現し、将来的には数千台規模にスケールアウトして1兆規模パラメータのモデルにも対応すると語った。2026年にはこの超高速推論を「最大級のフロンティアモデル」へと広げる考えを示した。

Codex-Sparkは推論速度の向上に加え、エンドツーエンドの応答遅延を低減するためのインフラ最適化も導入した。レイテンシ改善のためにWebSocket接続の持続化やレスポンスストリーミングの再設計なども進め、初期トークン出力までの時間を大幅に短縮したと説明している。こうした低遅延設計は、開発者がモデルとのインタラクションを途切れなく行える点でメリットがあると強調している。

ベンチマークなどは紹介されていないが、公式Xでヘビゲームを作るコーディングのCodexとCodex-Sparkの比較動画を公開している。

Codex-Sparkは研究プレビューとして提供され、当面はChatGPTのProプランの利用者がCodexアプリ、CLI、VS Code拡張機能などで試すことができる。プレビュー期間中は独立したレート制限が適用され、標準的な使用制限とは別に管理される。一部の設計パートナー向けにはAPIでも提供され、今後アクセス範囲の拡大や機能強化が進められる予定だ。プレビュー提供の段階では追加料金は不要だが、利用にはProプランへの加入が前提となる。公式ブログでは、需要に応じてアクセス制御や一時的な待機が発生する可能性も示している。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

こんなメディアも見られています

ITmedia AI+に関連する情報をお探しであれば、こちらのメディアもお役に立てるかもしれません。

SpecialPR

よく見られているカテゴリー

アクセスランキング

-

1

Google、“動画版Nano Banana”こと「Gemini Omni」公開 会話で映像を生成・編集

-

2

日立、Anthropicと提携 グループ29万人に「Claude」などAI導入 社会インフラ分野にも展開へ

-

3

Appleが5年がかりで開発したセキュリティ対策を5日で突破 「Mythos」が見せつけた脆弱性攻撃の威力

-

4

GoogleのAIサブスク、最上位プランを値下げ 月額1万4500円の新プランも

-

5

生成AIで3Dモデルを自動作成 専門スキル不要でテキストや画像から3D化

-

6

「ポンコツ」と呼ばれたM365 Copilotの逆転劇、GPT-5が転換点 活用の秘訣は“脱・プロンプト職人”

-

7

人間 vs. 人型ロボ、より多く作業をこなせるのは? 生配信で対決した結果…… 米企業

-

8

「最新のAI創薬ラボ」なのに会議室みたい!? 製薬大手がラブコール送る“異色のAI企業”による新拠点とは

-

9

Google「Gemini」に個人向けAIエージェント 質問に答えるだけでなく「作業を代替」 まずは米国で

-

10

OpenAIの共同設立者アンドレイ・カーパシー、Anthropicにジョイン

SpecialPR

ITmedia AI+ SNS

インフォメーション

注目情報をチェック

ITmedia AI+をフォロー

あなたにおすすめの記事PR

@itm_aiplusをフォロー

@itm_aiplusをフォロー