Google、エージェント特化の「Gemma 4」をApache 2.0で公開

米Googleは4月2日(現地時間)、高性能オープンモデル「Gemma 4」をリリースした。最大の特徴は、高度な推論や多段階の計画、エージェント型のワークフローに特化して設計されている点と、Gemmaシリーズとして初めて商用利用の自由度が高いApache 2.0ライセンスで公開されたことだ。

先代の「Gemini 3」と同じ研究と技術に基づいて構築されており、テキストに加えて画像や動画の処理に対応するほか、システムプロンプトや関数呼び出しをネイティブにサポートしている。

提供されるモデルは、モバイルやIoTデバイスでの実行に向けてメモリ効率を最大化した「E2B」(Effective 2B)と「E4B」、パソコン上で高速な推論を実現する「26B MoE」(Mixture of Experts)、ファインチューニングの強力な基盤となる「31B Dense」の4種類。

小型のE2BとE4Bは音声入力もネイティブに処理でき、大型モデルでは最大25万6000トークンという長大なコンテキストウィンドウを扱える。

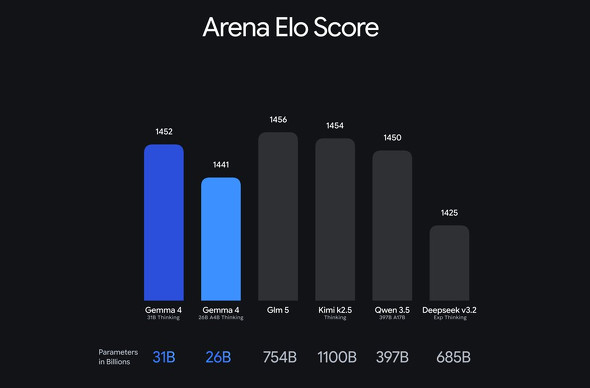

140以上の言語をサポートしており、ベンチマークでも業界をリードする成績を収めている。例えば、「Arena AI」のテキストリーダーボードでは31Bモデルがオープンモデルとして世界第3位、26Bモデルは自身の20倍の規模のモデルより上位の第6位にランクインしている。

利用方法としては、「Google AI Studio」「Kaggle」「Hugging Face」などのプラットフォームからモデルをダウンロードできるほか、「Ollama」や「LM Studio」などのツールを使ってローカル環境で実行可能だ。また、「Vertex AI」「Cloud Run」「Google Kubernetes Engine(GKE)」「Cloud TPU」などのクラウド環境に展開できるという。Cloud RunではBlackwellアーキテクチャのGPUを活用した推論が可能であり、GKEでは新たな「Agent Sandbox」を利用することで、エージェントによるコード生成やツール呼び出しを安全かつ分離された環境で高速に実行できるほか、Sovereign Cloudの活用による厳格なデータ主権要件にも対応している。

また、Androidの「AICore Developer Preview」を通じて「Gemma 4」のアーリーアクセスが開始された。現在Gemma 4向けに書いたコードは、年内に登場予定の「Gemini Nano 4」搭載端末でも自動的に動作する見込みだ。

米NVIDIAによると、Gemma 4はNVIDIAのGPU向けに最適化されているという。RTX搭載PCや「DGX Spark」、エッジ向けの「Jetson Orin Nano」などでローカルのAIエージェントを効率的に実行でき、NVIDIAのTensorコアを活用することで高いスループットと低遅延での推論が可能になると説明している。

関連記事

Google、“超小型”AIモデル「Gemma 3 270M」公開 スマホで動き、省電力性能に優れる

Google、“超小型”AIモデル「Gemma 3 270M」公開 スマホで動き、省電力性能に優れる

米Googleは、2億7000万パラメータの小型AIモデル「Gemma 3 270M」を公開した。エッジデバイス向けで、マルチモーダルに対応。省電力性能に優れるという。 Google、イルカのコミュニケーション解読を目指すAIモデル「DolphinGemma」発表

Google、イルカのコミュニケーション解読を目指すAIモデル「DolphinGemma」発表

Googleは、イルカの会話を解読するための新LLM「DolphinGemma」を発表した。また、イルカと会話するためのシステム「CHAT」向けに「Pixel 9」を提供していることも紹介した。 Google、オープンなAIモデル「Gemma 3」リリース マルチモーダル対応 モデルサイズは4種類

Google、オープンなAIモデル「Gemma 3」リリース マルチモーダル対応 モデルサイズは4種類

米Googleは、オープンな大規模言語モデル「Gemma 3」をリリースした。新しくマルチモーダルに対応。軽量かつ高性能をうたっており、スマートフォンやノートPCなどエッジデバイス上でも動作するという。 Google、オープンな生成AIモデル「Gemma」公開 商用利用OK、Geminiと同じ技術の軽量LLM

Google、オープンな生成AIモデル「Gemma」公開 商用利用OK、Geminiと同じ技術の軽量LLM

米Googleは、大規模言語モデル(LLM)「Gemma」を公開した。同社が開発するLLM「Gemini」に使ったのと同じ技術を活用して開発した軽量版LLMで、同社は「オープンなAIモデル」として位置付けている。商用利用も可能としている。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.