Google、“超小型”AIモデル「Gemma 3 270M」公開 スマホで動き、省電力性能に優れる

米Googleは8月14日(米国時間)、2億7000万パラメータの小規模言語モデル(SLM)「Gemma 3 270M」を公開した。同社が提供するオープンなAIモデル「Gemma 3」の1つで、エッジデバイス向け。マルチモーダルに対応しており、省電力性能に優れるという。

2億7000万パラメータのうち、1億7000万パラメータはテキストや画像などの数値化に、1億パラメータは自然言語を処理する「Transformer」に当てる。25万6000トークンまで扱うことができ、特定のタスクや言語向けに調整もできる。

同社は、Gemma 3 270について「最も電力効率の高いGemmaモデル」と説明する。同社のスマートフォン「Pixel 9 Pro」のSoCを使用した社内テストでは、演算コストを削減した量子化モデルを使用した場合、25回やりとりした時のバッテリー消費量が0.75%にとどまったとしている。

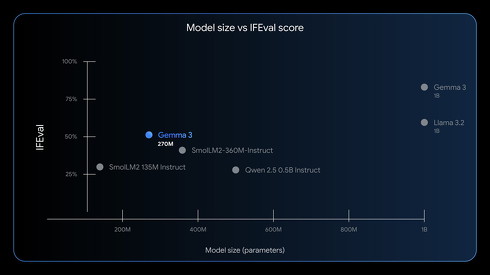

指示を守る性能も高く、ベンチマークでは、中国Alibabaの5億パラメータのAIモデル「Qwen 2.5 0.5B Instruct」や、米Hugging Faceの3億6000万パラメータを持つAIモデル「SmolLM2-360M-Instruct」よりも優れた成績を残したとしている。

また、モデルサイズが小さいため、運用する際のコストを下げ、レスポンスを高めるなどの使い方ができる。デバイス上で実行することで、クラウドに送信できない機密情報を扱う際にも使えるとアピールしている。

Gemma 3 270Mは、Hugging FaceやOllama、Kaggle、LM Studio、Dockerからダウンロードできる。AI開発ツールであるVertex AIでも試せるほか、 llama.cpp、Gemma.cpp、LiteRT、Keras、MLXなどにも対応する。ユーザーは「Gemma利用規約」のもと、同モデルの使用、複製、配布などが可能。

関連記事

Googleが軽量AIモデル「Gemma 3n」を発表 スマホ上で高性能マルチモーダルAI Claude 3.7 Sonnetに肉薄

Googleが軽量AIモデル「Gemma 3n」を発表 スマホ上で高性能マルチモーダルAI Claude 3.7 Sonnetに肉薄

米Googleが、モバイルデバイス向けの新しいAIモデル「Gemma 3n」を発表した。スマートフォンやタブレットなどのモバイルデバイス上で直接動作する高性能なマルチモーダルAIで、テキスト、画像、音声、動画を理解・処理できる能力を備える。 Googleのオープンな生成AIモデル「Gemma」、1億5000万超ダウンロード

Googleのオープンな生成AIモデル「Gemma」、1億5000万超ダウンロード

Googleのオープンな生成AIモデル「Gemma」のダウンロード数が累計1億5000万回を超えたと発表した。Gemmaは昨年2月に公開された。2023年2月に公開されたGemmaと競合するMetaの「Llama」のダウンロード数は累計12億回以上だ。 Meta、ネイティブマルチモーダルAI「Llama 4」発表 最小モデルは「H100」1枚で利用可能

Meta、ネイティブマルチモーダルAI「Llama 4」発表 最小モデルは「H100」1枚で利用可能

Metaは、マルチモーダルなLLMファミリー「Llama 4」を発表した。Llamaシリーズで初めて、MoEアーキテクチャを採用した。「Scout」「Maverick」「Behemoth」の3種類で、Behemoth以外は既にダウンロード可能だ。 Google、オープンなAIモデル「Gemma 3」リリース マルチモーダル対応 モデルサイズは4種類

Google、オープンなAIモデル「Gemma 3」リリース マルチモーダル対応 モデルサイズは4種類

米Googleは、オープンな大規模言語モデル「Gemma 3」をリリースした。新しくマルチモーダルに対応。軽量かつ高性能をうたっており、スマートフォンやノートPCなどエッジデバイス上でも動作するという。 AIモデル「Llama 3.3 Swallow」、東京科学大などのチームが公開 日本語能力は「GPT-4oに迫る」

AIモデル「Llama 3.3 Swallow」、東京科学大などのチームが公開 日本語能力は「GPT-4oに迫る」

東京科学大学情報理工学院の岡崎研究室と横田研究室、産業技術総合研究所の研究チームは、大規模言語モデル(LLM)「Llama 3.3 Swallow」を開発したと発表した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.