尦慻傒崬傒僄儞僕僯傾偺擾壠偑挧傓乽偒傘偆傝慖暿AI乿丂帋嶌婡3戜丄2擭娫偺婳愓丗擾嬈亊僨傿乕僾儔乕僯儞僌偺壜擻惈乮2/3 儁乕僕乯

弶傔偰偺僨傿乕僾儔乕僯儞僌偱偄偒側傝80亾偺惛搙

丂彫抮偝傫偼傕偲傕偲丄帺摦幵晹昳儊乕僇乕偺僜僼僩僂僃傾僄儞僕僯傾偩偭偨偙偲傕偁傝丄偡偖偵TensorFlow偺僠儏乕僩儕傾儖傪棳梡偡傞宍偱僔僗僥儉傪慻傒忋偘偨丅乽柍椏偱妛傋傞摦夋側偳傕廩幚偟偰偒偰偄傑偡偟丄愄偵斾傋偰妛傃傗偡偄娐嫬偑惍偭偰偄傞偲巚偄傑偡乿乮彫抮偝傫乯

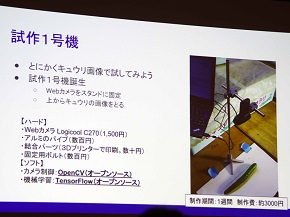

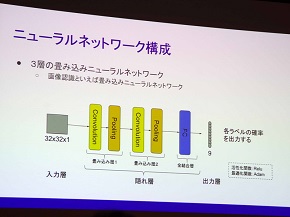

丂岤巻偵偒傘偆傝傪忔偣丄傾儖儈僷僀僾偱屌掕偟偨Web僇儊儔偱嶣塭丅偦偺夋憸傪3憌偺忯傒崬傒僯儏乕儔儖僱僢僩儚乕僋乮CNN亖僨傿乕僾儔乕僯儞僌偵偍偗傞傾儖僑儕僘儉偺堦庬乯偱幆暿偡傞偲偄偆僔儞僾儖側傕偺偩丅僜僼僩僂僃傾偑僆乕僾儞僜乕僗偱偁傞偨傔丄偐偐偭偨僐僗僩偼Web僇儊儔傪娷傔偰傕3000墌掱搙丅僯儏乕儔儖僱僢僩儚乕僋偑3憌偲彮側偄偨傔GPU傕昁梫側偔丄僲乕僩PC偔傜偄偺僗儁僢僋偱傕栤戣側偔摦偄偨偲偄偆丅

丂嫵巘僨乕僞偵偼丄弉楙幰偑巇暘偗偟偨偒傘偆傝偺幨恀傪2475枃乮慖暿偟偨偄9偮偺儔儞僋偱奺275枃乯廤傔偨丅偦偟偰275枃偺夋憸偱僥僗僩偟偨偲偙傠丄惓摎棪偑80亾偩偭偨丅堄奜偲偄偗傞乗乗丅偦偆姶偠偨彫抮偝傫偼丄偡偖偵師側傞帋嶌婡偺奐敪偵拝庤偟偨丅

傛傝丄恖娫偺敾抐偵嬤偯偗偨乽帋嶌2崋婡乿

丂懕偔帋嶌婡偱彫抮偝傫偑栚巜偟偨偺偼丄傛傝恖娫偺巇暘偗偵嬤偯偗傞偲偄偆揰偩丅嵟弶偺帋嶌婡偱偼丄嶣塭偡傞僇儊儔偑1戜偩偭偨偺偵懳偟丄崱夞偼USB僇儊儔傪3偮偵憹傗偟丄偒傘偆傝傪忋丄壓丄墶偐傜嶣塭丅徠柧傕偮偗偰柧傞偝傪堦掕偵偡傞傛偆偵偟偨丅傾儖儈僼儗乕儉偱傾僋儕儖斅傪屌掕偡傞側偳丄憰抲偼戝偒偔側偭偨偑乽偐偐偭偨旓梡偼2枩墌掱搙偩偭偨乿偲彫抮偝傫丅

丂CNN偵偍偗傞塀傟憌傕4憌偵憹傗偟偨傎偐丄嫵巘僨乕僞偺夝憸搙傪崅傔丄悢傕憹傗偟偨丅TensorFlow偺摦嶌娐嫬傕僲乕僩PC偐傜Raspberry Pi偵曄偊偨偲偄偆丅2僇寧傎偳偐偗偰忋丄壓丄墶偺夋憸傪7000慻梡堄偟丄1500慻偺夋憸偱僥僗僩傪峴偭偨偲偙傠丄惓摎棪偑90亾埲忋偵傑偱岦忋偟偨丅偝傜偵彫抮偝傫偼丄AI偑敾抐偟偨偒傘偆傝傪巜掕偺敔傑偱塣傇儀儖僩僐儞儀傾傕帺嶌丅巇暘偗偺姰慡帺摦壔傪払惉偟偨偺偩丅

丂偟偐偟丄姰惉偟偨帋嶌婡傪幚嵺偵摦偐偟偰傒偨偲偙傠丄懡偔偺壽戣偑偁傞偙偲偑暘偐偭偨丅夋憸偺撉傒崬傒偵巊偭偨夝憸搙偱偼彎傗墣偲偄偭偨梫慺傪擣幆偱偒側偄傎偐丄廃埻偺娐嫬偑擣幆偵塭嬁傪梌偊偰偟傑偄丄惛搙偑70亾掱搙偵傑偱棊偪偰偟傑偭偨丅巇暘偗偐傜敔媗傔傑偱偺僗僺乕僪傕傑偩傑偩懌傝側偄丅

丂夋憸傪憹傗偟偨偙偲偱丄廂妌帪婜偵傛偭偰宍傗懢偝偵曃傝偑偁偭偨偙偲傕暘偐偭偨丅弉楙偟偨恖娫偱偁傟偽丄柍堄幆偺偆偪偵偙偆偟偨岆嵎傪摜傑偊偰儔儞僋晅偗傪峴偆偑丄恖岺抦擻偱偼偦偆傕偄偐側偄丅偦偟偰丄壗傛傝儀儖僩僐儞儀傾偵傛偭偰丄偒傘偆傝偵僉僘偑偮偔偙偲偑暘偐傝丄尰応偵偼摫擖偱偒側偄偲偄偆敾抐偵側偭偨偲偄偆丅

Copyright © ITmedia, Inc. All Rights Reserved.

傾僀僥傿儊僨傿傾偐傜偺偍抦傜偣

恖婥婰帠儔儞僉儞僌

- Google専嶕丄25擭傇傝偺戝嶞怴丂乽僌僌傞乿偐傜乽AI僄乕僕僃儞僩偵擟偣傞乿傊

- 2027擭偐傜偺乽IT帒奿戝傾僾僨乿偼夵椙偐丄夵埆偐丠

- 乽AI偱AI偲愴偆乿帪戙偺枊奐偗丂Google Cloud偲Wiz偑栚巜偡帺棩杊屼偺悽奅

- 傑偢偼乽廳梫帒嶻偺扞壍偟乿傪丂NIST偑帵偡乽屄恖帠嬈庡乿儗儀儖偺杊塹儔僀儞

- 傾僋僙儞僠儏傾傜偑乽僄乕僕僃儞僩宆岺応乿傪奐敪丂惢憿尰応偺寁夋奜掆巭偺嶍尭恾傞

- NEC幮挿偑愢偔丂AI帪戙偲怴偨側埨慡曐忈娐嫬偺摓棃偱乽IT僒乕價僗偼偙偆曄傢傞乿

- 側偤崅搙側AI傪摫擖偟偰傕惉壥偑弌側偄丠丂擔杮婇嬈偑娮傞乽僨僕僞儖僼儕僋僔儑儞乿偺悌

- Cloudflare偑柧偐偡乽Mythos Preview乿偺幚椡丂AI偑惼庛惈敪尒偐傜峌寕幚徹傑偱帺棩幚峴

- Anthropic丄拞彫婇嬈梡AI嬈柋巟墖乽Claude for Small Business乿敪昞丂15庬偺AI僄乕僕僃儞僩偑嶌嬈傪尐戙傢傝

- 拞彫婇嬈偺栺65亾偑乽忣僔僗晄嵼乿丂僨僕僞儖壔偱傕巆傞壽戣偲偺娭楢偼丠