Amazonの「Alexa」、日本でも“スキル名言わずに命令”が一部可能に

米Amazon.comは12月7日(現地時間)、AIアシスタント「Alexa」の新機能を幾つか発表した。いずれも機械学習によるコンテキスト把握に関連するものだ。

曲名を言い間違えても正しい曲を再生

まず、米国のみだが、Alexaの自己学習機能によって、話者の不正確な命令を解析して正しいと思われる命令に解釈し直し、答える機能を追加した。解析には、話者のアクティビティ履歴や利用しているスキル、そのAlexaが搭載されているデバイスなどの状況を使う。

例えば話者が「“Good for What”をかけて」と言ったらそれがドレイクの“Nice for What”の言い間違えだと解釈し、正しい曲を再生する。

なお、うろおぼえの曲名で再生する機能はGoogleアシスタントにもあり、筆者がGoogle Home Miniで日本語で試したところ、Good for Whatと言ってもNice for Whatが再生された。

現在は曲タイトルの言い間違えだけだが、数カ月かけて自己学習機能の範囲を拡大していく計画だ。

スキルを指定せずに命令できる機能が日本でも利用可能に

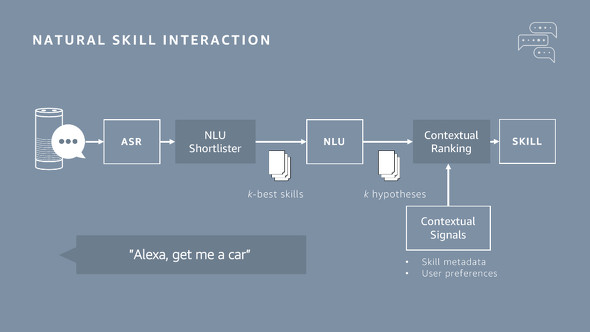

これまでは、例えば「全国タクシー」のスキルを有効にしている場合、タクシーを呼ぶには「アレクサ、全国タクシーを開いてタクシーを呼んで」とスキル名を言う必要があったが、同日から「Alexa、タクシーを呼んで」と言うだけで全国タクシーでの配車手配を開始できるようになった。

Alexa向けのスキルは現在5万件以上あり、ユーザーはいちいちサービス名を覚えていられない。それをAlexaが利用履歴などから判断する。

この機能は、9月のAmazon本社でのイベントで発表され、米国では既に使えていた。

「Alexa、掃除して」でルンバが動き出す(米国のみ)

スキル名を言わずに命令できる機能は、米国ではスマートホームデバイスでも利用できるようになった。例えば」Alexa、掃除して」と言うだけでお掃除ロボットのRoombaでの掃除が始まる。

関連記事

Alexaに小声で話すと小声で答える「Whisper Mode」、米国でスタート

Alexaに小声で話すと小声で答える「Whisper Mode」、米国でスタート

Amazonのスマートスピーカー「Echo」シリーズに小声で命令すると、小声で答える「Whisper Mode」が米国の英語版で利用できるようになった。 Amazon Echoの音声通話やボイスメッセージ、日本でも利用可能に Echo Spotはビデオ通話も

Amazon Echoの音声通話やボイスメッセージ、日本でも利用可能に Echo Spotはビデオ通話も

スマートスピーカー「Amazon Echo」シリーズや「Amazon Alexa」アプリを使った音声通話やボイスメッセージが、日本国内でも利用可能になった。スクリーン付きのEcho Spot同士ならビデオ通話もできる。 「Alexa、英語で『流れ星』は何?」 アマゾンがAlexaに翻訳機能

「Alexa、英語で『流れ星』は何?」 アマゾンがAlexaに翻訳機能

Amazon.co.jpが、Alexaに翻訳機能を追加した。Amazon Echoシリーズなどで「Alexa、英語で『流れ星』は何?」のように話し掛けると、音声で回答してくれる。好きな音楽を目覚ましアラームに使える「ミュージックアラーム」機能も追加する。 Alexaにいちいち「Alexa」と言わなくていい「フォローアップモード」、まずは米国で

Alexaにいちいち「Alexa」と言わなくていい「フォローアップモード」、まずは米国で

Amazon.comのスマートスピーカー「Echo」シリーズの米国英語版で、ウェイクワードの「Alexa」を1度言えば、その後はいちいちウェイクワードを言わなくても連続して命令できるようになった。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR