iPhone 11 Proのカメラのすごさはここにあった:荻窪圭のデジカメレビュープラス(3/3 ページ)

詳細は公開されてないので想像だけど、iPhone 11 Proは「シャッターボタンを押した瞬間の写真を記録してる」わけじゃない。

撮影するときって、カメラが捉えた光を画像に変換してそれをモニターに表示したものを見ながら撮ってる。その構造上、絶対に若干のタイムラグが発生する。だいたい0.15秒前後くらい。

だから、常に0.15秒前後後の映像を見ながら撮影してるので、画面を見ながら撮るとその分タイミングがずれる……はずである。

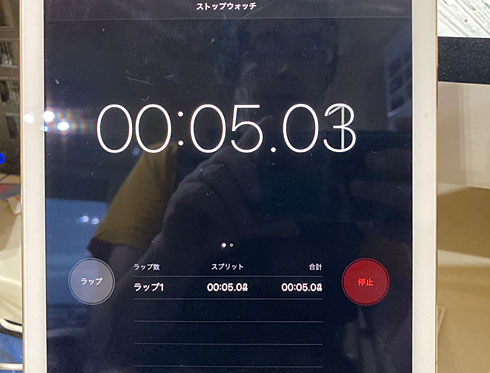

でもiPhone 11 Proだとそうはならないのだ。これ、iPadの画面でストップウォッチを動かし、05.00の5の字が見えた瞬間にシャッターを切ってみたもの。そうすると、さっきのタイムラグ+人間の反応タイムラグがあるので、まあ早くても5.2〜3秒くらいの値が撮影されるはずだが、実際に撮れた瞬間の一つがこれ。

もちろん、iPhoneの画面の方だけを見ながらシャッターをタップしてる。面白いよねえ。

ちなみに同様の条件でiPhone 7 Plusで撮ってみたら、5.4秒くらいのだったので、明らかにiPhone 11 Proの方が速いわけである。

あらかじめ、画像をバッファに記録していて、シャッターを切るとタイムラグを見越した瞬間の画像を記録してるってことなのだろう。

いやはや面白いことをするものだ。

もう一つ、分かりやすい例でいうと、iPhone 11から搭載された「ナイトモード」。

これも露出を変えながら複数枚撮影して、それを合成することでダイナミックレンジが広い、華やかで明るい夜景を撮ってくれる機能。撮影時間が1秒とか2秒とかかかるけど、実際にその秒数のスローシャッターになっているわけではなくて、1/4秒とか1/15秒とかで撮って合成してるのだ。2秒あれば1/4秒の写真を8枚撮れるからね。

どうしてもISO感度を上げるとノイズが増えるけど、ランダムなノイズは「同じものを撮った複数の写真」を重ねることで消すことができる。だから露出を変えたもの数枚と、変えてないもの数枚を上手に合成してるんだと思う。それでノイズが少なくて華やかな夜景を撮れるのだ。強い点光源があるとそれが内部で良くない反射をして在らぬ所に光の点が写っちゃうという欠点はあるけれども、それを除けば素晴らしい。

ただし、超広角カメラだとナイトモードは使えない。

デジタルならではの超絶な進化としては「写真の外側も残す」機能も挙げたい。

最初、何をやってるのかと思ったもの。実際に撮影される構図の外側が半透明でかぶってる。

これは広角カメラと超広角カメラの画像を合成して、実際に写る範囲の外側も見せてくれているともの。

普通、その発想自体がないのだけど、より高速な処理が可能になったからできる技だ。

ついでに、外側も同時に記録する(つまり違う画角の写真を2枚保存する)ことで、撮った後から構図をいじることができる。

まあ足りない部分をより広角側のカメラの画像で補うのでそこはディテールの描写力が落ちるけど、端っこがちょっと荒れても使用上は気にならない(大きくプリントしたり超大画面の4Kテレビなんかに表示したら分かるだろうけど)。

試しに、冒頭で出した広角カメラ写真の作例から、iOS13のカメラアプリを使って構図を変えてみた。もと写真で足りなかったところは超広角カメラでの画像を使ってるわけだ。実にうまいことつながってる。拡大して見ると途中からちょっと荒れてるのが分かる程度。

ちなみに、「構図の外側の画像」は30日だけ保持される。ストレージ消費が激しいことからできた制限かと思うが、将来は全カメラの画像を全部記録して溜め込んでいく方向に向かうのは間違いないかと思う。

iPhone 11 Proは「A13 Bionic」チップを搭載し、より高度で複雑な演算をリアルタイムでこなしてくれる。それを駆使してデジタルならではの処理を行い、ダイナミックレンジを広くしたりタイムラグをなくしたり、さらには顔検出や動物検出、それに応じた画像処理を行うことで、物理的な制約で上げられない性能を補い、デジタルならではの画作りを実現しているのだ。

実はこの稿、デジタルカメラユーザー視点でiPhoneカメラを語ってほしいというテーマなのである。

そういう目で見ると、従来のカメラではあり得ないデジタルならではのアプローチをどんどん組み込んできてるってのが目に付くのだ。

AIや機械学習が可能な超高速演算が可能なプロセッサーを搭載し、デジタル技術を容赦なく突っ込むことで、デジタルじゃなきゃできない写真を作るという方向はどんどん進み、本職のカメラとは異なる、本職カメラではできない方向に進化を遂げていくのだろうなと思うのと実に面白い。

関連記事

動画で理解する、iPhone 11 Proのカメラの生かし方

動画で理解する、iPhone 11 Proのカメラの生かし方

iPhone 11発表イベントを現地で取材した大石結花さんに、iPhone 11 Proのカメラ機能について詳しく語ってもらった。 「iPhone 11 Pro」を発売日に1万円引きでゲット 増税前後で盛り上がる還元キャンペーンの恩恵を受けてみた

「iPhone 11 Pro」を発売日に1万円引きでゲット 増税前後で盛り上がる還元キャンペーンの恩恵を受けてみた

記者が還元キャンペーンを言い訳に、新型iPhoneを購入した話。 カシオがもたらしたデジカメの歴史を振り返る

カシオがもたらしたデジカメの歴史を振り返る

2018年5月9日。カシオ計算機がコンパクトデジカメからの撤退を発表し、多くのカメラファンに衝撃を与えた。そんなカシオの歴史を振り返りつつ、哀しんでみたい。 「平成」デジカメ栄枯盛衰史

「平成」デジカメ栄枯盛衰史

デジカメは平成の時代に生まれた。アップル「QuickTake100」に始まり、多くのメーカーから特徴的なデジカメが登場した。めったにない改元の機会なので振り返ってみよう。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR