Googleすべり台と最近のアシスタントたち:Googleさん

お正月気分を早々に吹き飛ばす恒例イベント「CES」も終わりました。2018年からCESで「Googleアシスタント」をアピールしてきたGoogleさんは、今年もパーキングエリアに滑り台付きの遊園地みたいなブースを作りました。

ブースには、「Googleアシスタントをサポートするサードパーティ製品がこんなに増えたよ」コーナーや、そうした製品をたくさん置いたキッチンや寝室のようなシチュエーションで便利さを体験するコーナーがありました。

例年のことですが、CESに合わせて新しいハードウェアを発表するわけではないので、一番話題になったのは滑り台だったりしますが、今年中に使えるようになる予定の新機能を幾つか紹介もしました。

「ねぇGoogle、明日の朝6時にコーヒーいれて」など、声でスマート家電の予約ができるのは便利そう。個人的には、Android TVにマイクが搭載されて、「ねぇGoogle、テレビをつけて」ができるようになるのが嬉しいです(これも対応するテレビ待ちです。ソニーが出してくれるといいな)。Googleは「テレビの電源がオフになっていても、リモコンが見つからなくても、音声でテレビを制御できます」と説明しているので、コマーシャルが始まったら「消音にして」とかもできるんじゃないかな(今はリモコンでやってる)。

人間に近い「プロソディ」でWebページなどを朗読

発表された中で技術的に一番すごそうなのは、長文の自然な読み上げができるようになること。スマホでWebページを開いた状態で「ねぇGoogle、これを読んで」と言うと、すらすと読んでくれるようになる、そうです。

Androidには既に、ユーザー補助機能としてテキスト読み上げが用意されていますが、これでWebページを読んでもらうと、本文だけではなく、挟み込まれた広告や画像のクレジットなどもべたに読み上げます。新機能では、AIが本文を検知して本文だけ読んでくれるらしい。

読むべき場所を判断するのもすごいですが、読み方が自然になるのも大きなポイントです。

「自然な読み上げ」というのは、1つ1つの単語をちゃんと発音するだけでなく、文章全体の流れを人間のように抑揚を付けて、リズムやイントネーションも自然に読むということです。言語学で出てくる「prosody」(プロソディ)ってやつがちゃんとしてるということ。

最近のGoogleアシスタントの音声読み上げは日本語でもだいぶ自然になってきていて、例えば以前は「おはようございます、ゆきさん」の「ゆきさん」の「き」の音程が上がって「ちがうー」と感じていましたが、いつのまにか人間と同じように「ゆ」の音程が一番高くなりました。

Wikipediaの内容を読んだりするときも、英語ほどではありませんが日本語でもだいぶプロソディが自然になってきています。

Chromeブラウザなら数クリックでWebページを自分のメイン言語に翻訳できるので、翻訳してから「読んで」と言えば英語の記事も日本語で読んでくれます。

英語のページを開いて「ねぇGoogle、このページを日本語に翻訳して読んで」はまだできませんが、そのうちできるようになるでしょう。

ついでにうちのGoogleさん近況報告

年末年始に気付いたうちのGoogleさんたちのことをちょっとご紹介します。昨年末にステレオスピーカーにした「Nest Mini」はとても快適です。以前より音楽を流すことが増えました。

でも、Nest Miniに目的に合ったプレイリストを再生してもらうのがなかなか難しい(メインの音楽サービスは「YouTube Music Premium」に設定しています)。仕事中に日本語の歌詞が流れると気になってしまうということもあり、J-Popは流したくないんですが、「仕事効率アップのプレイリストを流して」とか「静かな音楽を流して」とかお願いすると、どうしてもJ-Popが出てきます。YouTube Musicの設定で好きなアーティストに1人もJ-Popの人は入っていないのになぁ。

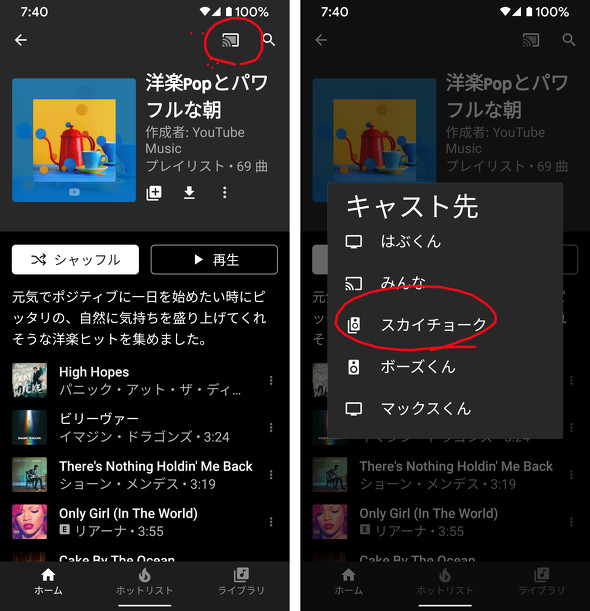

そこで、YouTube Musicの具体的なプレイリスト名、例えば「洋楽Popとパワフルな朝」をかけて、などとお願いしてみるんですが、くっきりはっきり発音しないと間違えることが多いし、プレイリスト名を言うにはWeb版やAndroidアプリのYouTube Musicを開いて探さなくちゃなりません。

なので今のところ、Nest Miniたちと同じWi-FiネットワークにいるPixel 4の画面でプレイリストを選んでそれをNest Miniたちにキャストするようにしています。別に何でも声でお願いしなくちゃいけないわけじゃないので。

キッチンカウンターにいる「Nest Hub Max」も元気です。

最近は夕食の支度をしながら「ねぇGoogle、ニュースを聞かせて」とお願いするのが日課になっていて、タイムラグはありますがNHKラジオとラジオ日経の直近のニュースを聞いてます。うちの流しはステンレスなので、水を出すとかなりうるさいんですが、そのたびに水音に負けないようMaxくんがボリュームを上げるのが面白い。ちゃんと聞こえます。

欲を言えばラジオを流しながらディスプレイにテキスト起こししたものを表示してくれたり、関連する写真を表示してくれたりするといいなぁ。

動画でニュースを見たい場合は「最新ニュースを動画で見せて」と言うと、なるべく新しいニュースを流してくれます。例えば今は朝の8時ですが、「6時44分のテレ朝ニュース」が流れました。その後はなぜかWiredの昨年12月19日のニュースのAIによる読み上げが始まりました。どうやってニュースを選んでいるんでしょうか。

こうやっていろいろ試していることはきっとGoogleのサーバに記録されて、改善につながると信じて、今日もいろんなお願いのしかたを試すのでした。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR