動く人をリアルに着せ替え合成 揺れる服の動きも詳細に再現:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

独ブラウンシュヴァイク工科大学と独Max Planck Institute for Informaticsによる研究チームが開発した「High-Fidelity Neural Human Motion Transfer from Monocular Video」は、人物と服の細かな動きを別の人物に転写する深層学習フレームワークだ。動きに合わせて揺れる衣服のシワやひだなども忠実に再現し合成する。

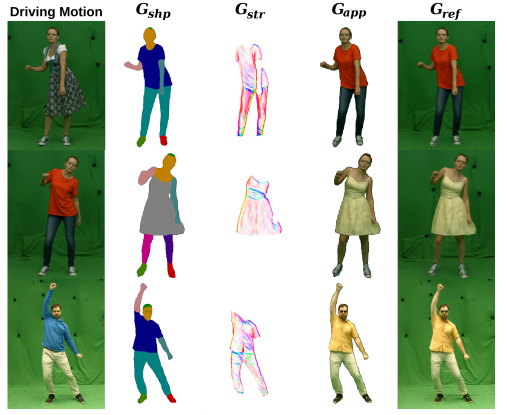

今回のフレームワークは、ソース映像の人物の動きだけをターゲット映像の人物に転送し、それに伴う衣服の副次的動作も含めた写実的なアニメーション合成を目指す。

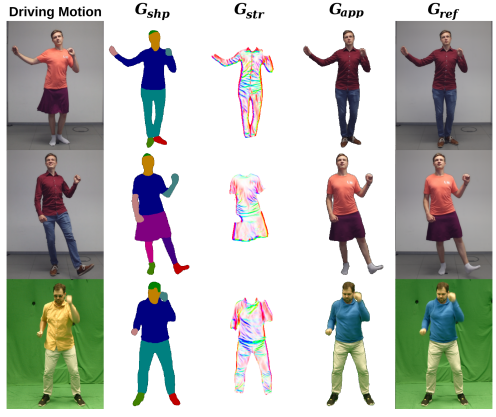

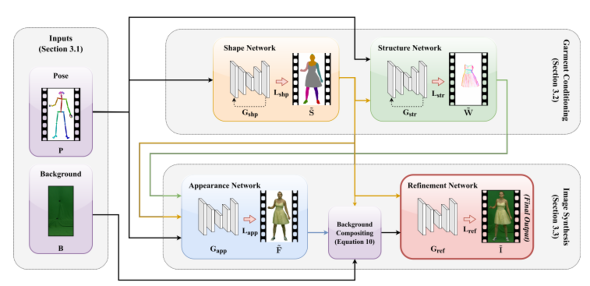

映像生成フレームワークは、4種類の深層学習ネットワークを活用し、2段階で実施した。1段階目は、1台の単眼カメラで撮影した動画から人物の平面的な形状を推定するネットワークと、衣服の内部構造である服のシワやテクスチャパターンの構造を推定するネットワークの2種類を実行する。その際、映像から取得した人物の2Dスケルトンポーズから、ピクセル単位のラベルを持つ手や足、頭などのパーツごとの前景マスクを予測する。

推定した人物のマスクと衣服構造を使い、2段階目で最終的な出力画像を合成する。ここでは前景の人物だけを写実的に合成するネットワークと、前景と背景シーンを統合する最終ネットワークの2種類を活用する。

このような手法により、短時間で高品質な合成映像を出力。特に同一人物間で違う服に動きを転写する実験では、スカートやワンピースなどのゆったりとした服を着ていても人の動きに応じてリアルに変形し、現在の類似手法と比較しても優れた品質を示したという。

関連記事

リードで巧みに人間を誘導する盲導ロボット犬 米カリフォルニア大が開発

リードで巧みに人間を誘導する盲導ロボット犬 米カリフォルニア大が開発

盲導犬の代替を目指す4足歩行ロボット。 飛行中にプロペラを変形できるドローン 狭い場所の通過や運搬作業など自由自在

飛行中にプロペラを変形できるドローン 狭い場所の通過や運搬作業など自由自在

狭い空間を通過する時などは機体を小さくできる、ホバーパイルダーがマジンガーZにドッキングする時を思わせるシーンも。 ビデオ会議中のよそ見が可能に? 顔が常に前を向いているように見せる技術、NVIDIAが開発

ビデオ会議中のよそ見が可能に? 顔が常に前を向いているように見せる技術、NVIDIAが開発

相手と常にアイコンタクトを取っているように見せかける技術。 外部プロジェクターの映像をAR表示する眼鏡型デバイス 東工大などが開発

外部プロジェクターの映像をAR表示する眼鏡型デバイス 東工大などが開発

ARグラスは重くなりがち。その問題を解決する方法の1つが、外部から投影すること。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR