動画中の顔を「若返らせる」「常に笑顔にする」編集技術 イスラエルチームが開発:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

イスラエルのテルアビブ大学の研究チームが開発した「Stitch it in Time: GAN-Based Facial Editing of Real Videos」は、実写映像内に映る人物の顔を編集できる深層学習を使った技術だ。元動画の動きのまま、その顔のアイデンディティを維持しつつ年齢を変えて若くしたり老化させたり、性別を変える、常に笑顔や怒っている顔にするなどといった編集ができる。

GAN(Generative Adversarial Network)は、顔の静止画像の編集に広く使用されており、高いパフォーマンスを達成している。しかし、動画で再現することは非常に困難を極める。動画の場合は、時間的な一貫性の維持という新たな課題があるからだ。ビデオに加えた操作は、全てのビデオフレームに一貫して反映させなければならない。

先行研究では、動画合成用のGANを学習することで、この課題に取り組むことを提案しているが、高品質のビデオデータセットがないことと、次元が増えることによる複雑さのために、videoGANはこれまでのところ、動かした際のアーティファクトが目立ち、静止画像の対応するものと同等の品質を得ることができていない。

この手法では、時間的な一貫性を作り出す方法ではなく、時間的な不整合が発生する可能性のあるポイントを特定し修正するアプローチでこれら課題に挑戦する。局所的に整合性のあるポイントを発見するためのエンコーダーと、大域的な整合性を促進するためのジェネレータの微調整という2つのアプローチを統合する。

最後に、空間的に一貫性のあるトランジションを提供するために、ジェネレータをさらに微調整する「stitching-tuning」という新しい操作を考案し、これにより、編集効果を維持しつつリアルなブレンドを実現する。

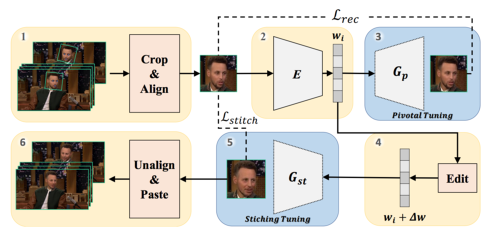

パイプラインは、6つのステップで構成。

- 動画をフレームごとに分割し、各フレームの顔を切り取る。

- 切り取られた各顔は、事前に学習されたe4eエンコーダーを使い、事前に学習したStyleGAN2モデルの潜在空間に反転する。

- 全てのビデオフレームを並行して、ジェネレータの微調整を行い、最初の反転の不正確さを修正し、全体のコヒーレンスを回復する。

- 全てのフレームは、入力画像の近似値を生成するためにジェネレータを介して供給できる初期の潜在コードを操作することで編集する。

- stitching-tuningを使った2回目の微調整を行い、背景と編集した顔を空間的に滑らかにつなぎ合わせる。

- 位置合わせの手順を逆にして、修正した顔を映像に貼り付ける。

このように合成した出力映像は、時間的な一貫性を強制しようとするコンポーネントを使用していないにもかかわらず、人物のアイデンディティを維持しながらアーティファクトを抑えた滑らかな映像に仕上げる。これまでの類似手法と比較しても、この手法の方が良好な結果を示した。

実写だけでなく、3Dキャラクターの顔などアニメーションメディアにも適応できる。

Source and Image Credits: Tzaban, Rotem, Ron Mokady, Rinon Gal, Amit H. Bermano and Daniel Cohen-Or. “Stitch it in Time: GAN-Based Facial Editing of Real Videos.” (2022).

関連記事

「頭をなでる」「ビンタ」「ハグの拒否」などアバター同士の接触を滑らかにするVR技術、東工大が開発

「頭をなでる」「ビンタ」「ハグの拒否」などアバター同士の接触を滑らかにするVR技術、東工大が開発

東京工業大学長谷川研究室の研究チームは、バーチャル空間でアバター同士もしくは3Dオブジェクトとの接触の際に、両者が自然な動きで表現できる技術を開発した。頭をなでる、ハグするなどの動きを滑らかなリアクションで表現する。 英語ネイティブとの発音の違いを深層学習で可視化 ソニーCSLが開発

英語ネイティブとの発音の違いを深層学習で可視化 ソニーCSLが開発

ソニーコンピュータサイエンス研究所(ソニーCSL)京都研究室の研究チームは、非母国語の学習において、学習者の発話とネイティブスピーカーの発話の違いを深層学習を使い分析し、視覚的に提示するシステムを開発した。 写真内の物体を3Dモデルに変換するシステム、米Snapらの研究チームが開発

写真内の物体を3Dモデルに変換するシステム、米Snapらの研究チームが開発

米南カリフォルニア大学(USC)と、写真共有アプリ「Snapchat」などを開発する米Snapの研究チームは、さまざまな時間や場所、照明条件で撮影した画像から、対象物を抽出し3Dモデルに変換するシステムを開発した。 映像を自由にデコる編集技術 物体が動いても引っ付いて離れない 米Adobeらが開発

映像を自由にデコる編集技術 物体が動いても引っ付いて離れない 米Adobeらが開発

イスラエルのWeizmann Institute of Scienceと米Adobe Researchの研究チームは、映像内の動く領域にぴったり貼り付いているかのように画像などを合成できる編集技術を開発した。歩く人のワンピースに花柄を付け加えたり、ベンチを虹色にしたりを後から編集できる。 ジョジョのキャラクター風に顔写真を変換する「JoJoGAN」 1枚の画像からAIが学習

ジョジョのキャラクター風に顔写真を変換する「JoJoGAN」 1枚の画像からAIが学習

米イリノイ大学アーバナ・シャンペーン校の研究チームは、入力した1枚の顔画像を漫画「ジョジョの奇妙な冒険」のキャラクター風に変換する機械学習フレームワークを開発した。「空条承太郎」など、作中のキャラクターに似せた顔に変換する。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR