1枚のパノラマ写真から室内を3次元で忠実に再現 Googleなどが開発:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

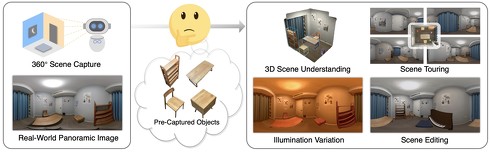

中国の浙江大学と米Googleの研究チームが開発した「Neural Rendering in a Room: Amodal 3D Understanding and Free-Viewpoint Rendering for the Closed Scene Composed of Pre-Captured Objects」は、1枚のパノラマ写真から部屋内の全体の3次元シーンを正確に再現するシステムだ。

ニューラルレンダリング(ボリュームレンダリング)に基づく最適化により、シーンの3次元配置と照明状態を高精度に推定し、ルームスケールの自由視点レンダリングを実現。家具の移動や照明条件が変わっても、再度パノラマで撮影すれば同様の精度で結果が得られる。

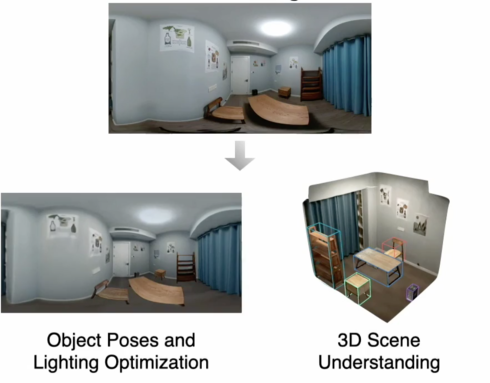

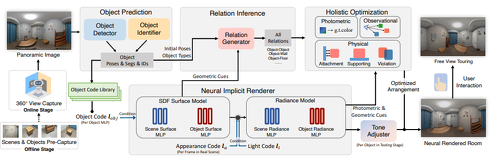

今回は、単一のパノラマ画像を入力に、室内の3次元空間におけるオブジェクトの認識と位置特定、任意のカメラ視点からのシーンのレンダリングを行う。システムはオフラインステージとオンラインステージの2段階のパイプラインで構成する。

オフラインステージでは、RGB-Dカメラで各オブジェクト(椅子や棚など)と背景をスキャンし、オブジェクトにボリュームレンダリング(NeRFを代表とする、異なる角度から撮影した複数画像でその物体の自由視点画像を生成する技術)を行い、各オブジェクトの3次元オブジェクトを作成する。

オンラインステージでは、パノラマ画像から全体的なボリュームレンダリングベースの最適化を利用してオブジェクトの配置と照明条件を推定する。これによって、3Dシーンの正しい理解が得られる。

このようにオフラインステージの段階であらかじめ家具や部屋全体の情報を収集し3次元にしているため、その後、室内の家具が移動したり照明条件が異なっていても、単一のパノラマ写真で家具などの位置を正確に把握し高精度の自由視点レンダリングが行える

研究チームはこの技術をロボットが特定の室内環境(家、オフィス、美術館など)で動作するシナリオを想定している。シーンを高いレベルで理解できるため、シーン内での複雑なタスクも容易になるという。他にも、家具購入を考えて疑似的に家具をシーン内に配置するアプリ、自室でバーチャルゲームを作成するアプリなどにも活用できるだろう。

Source and Image Credits: Bangbang Yang, Yinda Zhang, Yijin Li, Zhaopeng Cui, Sean Fanello, Hujun Bao, and Guofeng Zhang.“Neural Rendering in a Room: Amodal 3D Understanding and Free-Viewpoint Rendering for the Closed Scene Composed of Pre-Captured Objects”

関連記事

iPhoneの自撮りで本物そっくりな動く3Dリアルアバター 米Metaが技術開発

iPhoneの自撮りで本物そっくりな動く3Dリアルアバター 米Metaが技術開発

米MetaのReality Labsの研究チームは、スマートフォンで自撮りした短時間のスキャン画像から、本物そっくりの3D頭部アバターを生成するシステムを開発した。異なる視点やフォトリアリスティックな表情を表現し、高い忠実度で再現する。 道路脇にごみ箱があると自動運転車が間違って止まる? 米国の研究者らが検証

道路脇にごみ箱があると自動運転車が間違って止まる? 米国の研究者らが検証

米カリフォルニア大学アーバイン校と米カリフォルニア大学ロサンゼルス校の研究チームは、自動運転車において、道路脇に置かれた物に反応し停止してしまうかを検証した論文を発表した。 作家とAIが小説を共作できるツール 主人公の変化する運勢を“手書きグラフ”で操作、AIが物語文を作成

作家とAIが小説を共作できるツール 主人公の変化する運勢を“手書きグラフ”で操作、AIが物語文を作成

米ミシガン大学、韓国のKAIST、韓国のNaver AI LABによる研究チームは、人間(作家)とAI(GPTベースの言語モデル)が小説の物語を共同制作できるツールを開発した。 文章から“動画”を自動作成するAI、中国の研究チームが開発

文章から“動画”を自動作成するAI、中国の研究チームが開発

中国の清華大学の研究チームは、簡単なテキストを入力に、その文章を基にした簡単な動画を自動作成する機械学習モデルを開発した。 AIが信号機を自律操作 交通渋滞の軽減を目指す 英国の研究チームが技術開発

AIが信号機を自律操作 交通渋滞の軽減を目指す 英国の研究チームが技術開発

英Aston Universityの研究チームは、交差点にあるライブカメラの映像で交通状況を監視し、深層学習モデルで適切な信号操作をリアルタイムに行う、ビジョンベースの完全自律型信号制御システムを開発した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR