文章から高解像度な画像を生成するAI、Microsoftなどが開発 「DALL・E2」や「Imagen」よりも横長で出力:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

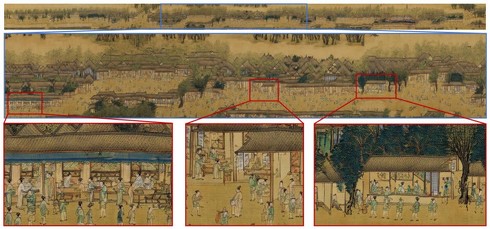

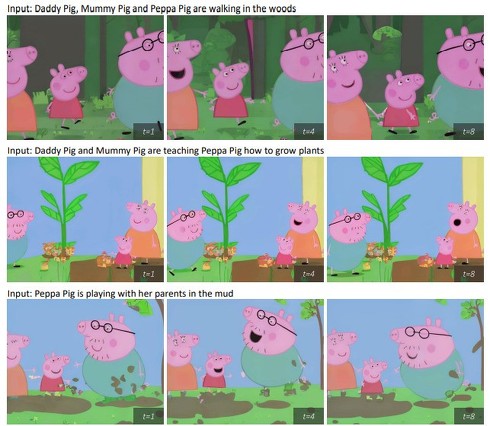

Microsoft Research Asia、北京大学、Microsoft Azure AIによる研究チームが開発した「NUWA-Infinity: Autoregressive over Autoregressive Generation for Infinite Visual Synthesis」は、 テキストから画像や動画、画像から動画、画像から拡張画像(コンテンツの関係を失うことなく画像を拡大すること)などを生成する学習モデルだ。

OpenAIのDALL・E2、GoogleのImagenやPartiなど、テキストから高品質の画像を生成できるモデルが注目されている。これらが解像度1024×1024ピクセルの画像を生成するのに対し、この手法はより高解像度な画像(4096×1024ピクセル)を生成できる。無条件画像生成であれば、3万8912×2048ピクセルの超横長画像まで出力できる。解像度を上げることで生じる性能低下がほとんど見られないのが特徴だ。

最近の視覚合成モデルは、与えられたテキストや画像などに基づいて画像やビデオの生成、画像のインペイントやアウトペイント、ビデオ予測など、さまざまな視覚コンテンツ作成を支援できる。またこの分野では、より高解像度の画像を生成する方法や、より長時間の動画を生成する方法を探求する研究が増えてきており、注目すべき傾向を目の当たりにしている。

しかし、既存の研究では画像や動画をパッチに分割し、その依存関係を考慮せずに個別にパッチを生成するモデルを学習し、生成されたパッチを合成して最終的な画像や動画を形成している。このような手法は、生成されたパッチ間の依存関係を明示的にモデル化していないため、特に高解像度画像や長めの動画を生成する場合、生成されたコンテンツの整合性を保証するのに苦労する。

この課題に一石を投じたのがこの研究だ。「NUWA-Infinity」と呼ぶ今回のモデルはテキストや画像を入力することで、任意サイズの高品質な画像や画像拡張、動画を生成する。グローバルなパッチレベルの自己回帰モデルがパッチ間の依存性を考慮し、可変サイズ生成タスクに対処する。

またNCP(Nearby Context Pool)を導入し、既に生成された関連パッチを現在生成中のパッチのコンテキストとしてキャッシュする方法で、パッチレベルのモデリングを犠牲にせず、計算コストを大幅に削減することができる。

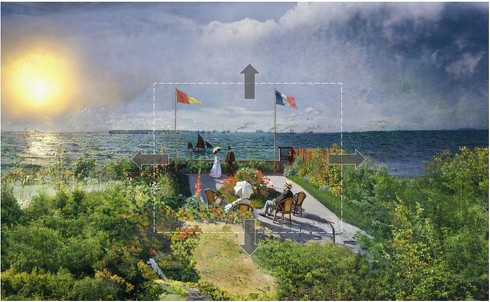

さらに画像のアウトペインティングに有効な、適切な生成順序を考慮した位置埋め込みを学習する「Arbitrary Direction Controller」(ADC)を提案している。

以下の画像は画像のアウトペインティングの一例であり、入力画像をコンテンツの関係を壊すことなく4方向に拡張している。

評価実験から画像と動画の合成を同時にサポートするNUWAと比較して、NUWA-Infinityの生成品質は大幅に向上していることが確認された。また画像アウトペイントや自然言語記述からのアニメーション作成など、創造的な映像合成タスクにおける応用可能性を示した。

Source and Image Credits: Chenfei Wu, Jian Liang, Xiaowei Hu, Zhe Gan, Jianfeng Wang, Lijuan Wang, Zicheng Liu, Yuejian Fang, and Nan Duan.“NUWA-Infinity: Autoregressive over Autoregressive Generation for Infinite Visual Synthesis”

関連記事

AI画家「DALL・E 2」一般公開へ 商用利用も可能に 悪用、差別防止機能を搭載

AI画家「DALL・E 2」一般公開へ 商用利用も可能に 悪用、差別防止機能を搭載

OpenAIが、文章から画像を生成するAI「DALL・E 2」のβ版を公開し、ユーザーの招待を始めた。招待人数は100万人。基本利用料無料で、生成した画像は商用利用も許可する。 最新AIの描く絵が「ヤバすぎ」「個展開ける」と話題 文章から画像を生成する「DALL・E 2」、米OpenAIが発表

最新AIの描く絵が「ヤバすぎ」「個展開ける」と話題 文章から画像を生成する「DALL・E 2」、米OpenAIが発表

米AI研究企業OpenAIは、文章から画像を生成するAI「DALL・E 2」を発表した。生成した画像を掲載するデモサイトも公開しており、その絵のクオリティーの高さにTwitter上では「最新のAIやばすぎる」など、驚きの声が出ている。 Google、文章から画像を生成するAI「Imagen」 「DALL-E 2より好まれる」

Google、文章から画像を生成するAI「Imagen」 「DALL-E 2より好まれる」

Google Researchは、文章から画像を生成する拡散モデル「Imagen」を発表した。独自ベンチマークではOpneAIの「DALL-E 2」よりも人間に好まれる結果が出たとしている。 文章から“動画”を自動作成するAI、中国の研究チームが開発

文章から“動画”を自動作成するAI、中国の研究チームが開発

中国の清華大学の研究チームは、簡単なテキストを入力に、その文章を基にした簡単な動画を自動作成する機械学習モデルを開発した。 画像生成AIが独自の“AI語”を生み出した? 「DALL-E 2」を巡って、米テキサス大学が論文発表

画像生成AIが独自の“AI語”を生み出した? 「DALL-E 2」を巡って、米テキサス大学が論文発表

AIが人間の言葉ではない独自の言語を生成した──米テキサス大学の研究チームはそのような研究結果を示す論文を発表した。画像生成AIが生み出す文字列は意味不明なものであると思われていたが、それらの言葉は鳥や野菜などの意味を持つ“AI語”であったという。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR