Google、テキストから音楽を生成する「MusicLM」発表 リリースはせず

米Googleの研究部門Google Researchは1月26日(現地時間)、テキストから音楽を生成するAI「MusicLM」を発表した。成果物のサンプルは公開しているが、著作権侵害などの恐れがあるため、現時点ではモデルをリリースする予定はないとしている。

Googleは「MusicLMは、条件付き音楽生成プロセスを階層的なシーケンスからシーケンスへのモデリングタスクとしてキャストし、数分間にわたって一貫性を保つ24kHzの音楽を生成する」AIモデルと説明する。

テキストから音楽を生成するAIモデルは既に幾つか発表されているが、MusicLMはトレーニングデータとして、テキストと高品質な音楽のペアのデータセットであるMusicCapsを作成してこれを使ったことで、優れたものになっているという。トレーニングデータは28万時間分に上る。

MusicCapsは、5521の音楽サンプルにミュージシャンが英語のテキストでキャプションを付けたもの。こちらは一般公開されている。

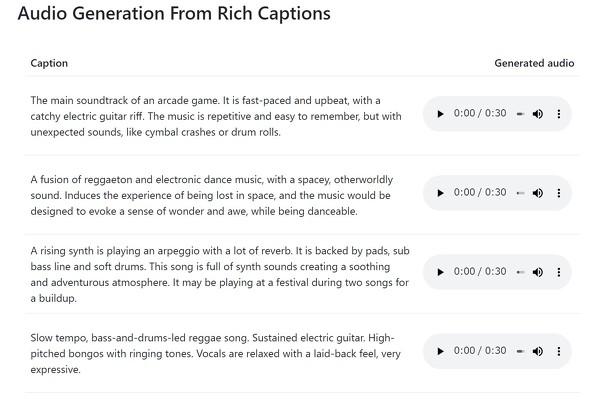

公開されているサンプルは、例えば「スローテンポでベースとドラムがメインのレゲエの歌。サステインギター。ボンゴ。ボーカルはゆったりとリラックスした感じで表現力豊か」というテキストと、それに対応する30秒の楽曲だ。この曲には歌詞付きのボーカルが含まれるが、歌詞は意味不明だ。

上記のサンプルのように楽器などを具体的に指定するものの他、順番に指定したキャプション通りに曲調を変えるものもある。例えば、「瞑想」→「起床」→「走る」→「全力」というテキストから生成された1分の曲は、そう聞こえなくもない。

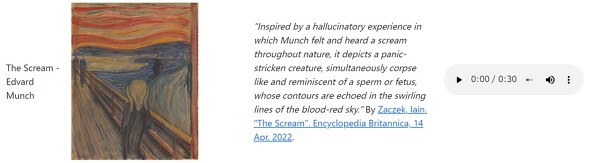

また、著名な絵画とそのレビューテキストに基づく楽曲のサンプルもある。ムンクの「叫び」やダリの「記憶の固執」などだが、これらは評価が分かれそうだ。

Googleはこのモデルのリスクとして、トレーニングデータの偏りを反映しているので、文化的な偏りが生じる恐れがあることや、オリジナル楽曲の著作権侵害を挙げている。生成した楽曲の約1%に、オリジナル楽曲が「正確に記憶」されていることが分かったとしている。「これらのリスクに対処するための今後の作業の必要性を強く主張」し、現時点ではモデルをリリースする予定はないという。

【訂正:2023年1月28日午後5時50分 当初「MusicML」としていましたが、「MusicLM」の誤りでした。お詫びして訂正します。】

関連記事

どんなメロディもバッハ風にするAIサービス 編曲を“巨匠に依頼”した 美しい演奏を聞けるのか?

どんなメロディもバッハ風にするAIサービス 編曲を“巨匠に依頼”した 美しい演奏を聞けるのか?

入力したメロディをバッハ風やモーツァルト風に演奏するAIサービス「Assisted Melody」を使って、“巨匠”に編曲をしてもらった。果たして、美しい音色を聞けるのだろうか。 進化したAIによる成果物の権利は誰のもの? Midjourneyだけではない、小説、映画、音楽で既にAI生成物は広まっている

進化したAIによる成果物の権利は誰のもの? Midjourneyだけではない、小説、映画、音楽で既にAI生成物は広まっている

言葉から画像を作り出すMidjourneyが話題だが、AIを創作に生かそうという研究開発はあらゆるジャンルで進んでいる。 コミュ力の高い対話型AIは人間との関係をどのように築くのか?

コミュ力の高い対話型AIは人間との関係をどのように築くのか?

Googleの対話型AIエージェントLaMDAが意識を持っていると主張した研究者がいたことが話題になったが、対話型AIは現在、大きなトレンドになっている。 Google、機械学習での美術・音楽生成を目指す「Magenta」プロジェクト

Google、機械学習での美術・音楽生成を目指す「Magenta」プロジェクト

Googleが、機械学習システム「TensorFlow」を採用するアート生成機械学習アルゴリズムプロジェクト「Magenta」を立ち上げた。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR